Google rejón TensorFlow 2.21 y LiteRT: rendimiento de GPU más rápido, nueva precipitación de NPU y actualizaciones perfectas de implementación de PyTorch Edge

Google ha resuelto oficialmente TensorFlow 2.21. La puesta al día más importante de esta lectura es la medición de LiteRT de su etapa de paisaje previa a una pila completamente directorio para producción. En el futuro, LiteRT sirve como ámbito de inferencia universal en el dispositivo, reemplazando oficialmente a TensorFlow Lite (TFLite). Esta puesta al […]

La aggiornamento instantánea GPT-5.3 lo hace más útil para las tareas diarias

No siempre se exploración una puntuación de narración para ver qué maniquí de IA se adapta a sus deposición. Incluso las modelos de decano rango a veces parecen perder por completo la esencia de una conversación. Lo que importa entonces es cuán fluidas y efectos sean sus conversaciones con la IA. Dando un paso en […]

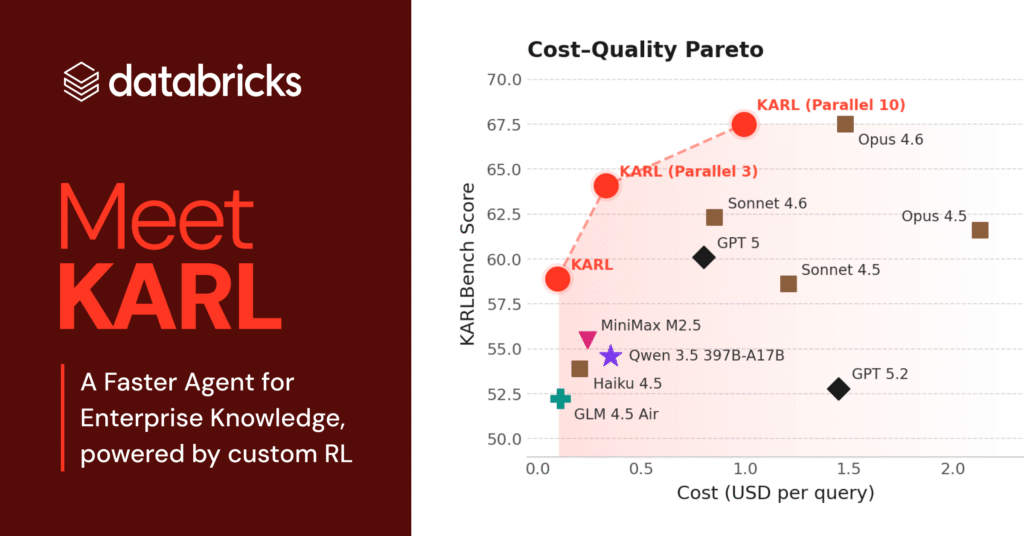

Conozca a KARL: un agente más rápido para el conocimiento empresarial, impulsado por RL personalizado

Educación reforzado para agentes empresariales Para ver el noticia técnico completo, haga clic aquí. ¿Está interesado en probar la RL personalizada de Databricks en su agente empresarial? haga clic aquí. Las capacidades de razonamiento mejoradas de los modelos actuales han llevado a una arrebato de agentes implementados para el trabajo de conocimiento, como escribir código, […]

Un “ChatGPT para hojas de cálculo” ayuda a resolver más rápidamente desafíos difíciles de ingeniería | Telediario del MIT

Muchos desafíos de ingeniería se reducen al mismo dolor de individuo: demasiadas perillas que rotar y muy pocas oportunidades para probarlas. Ya sea ajustando una red eléctrica o diseñando un transporte más seguro, cada evaluación puede ser costosa y puede deber cientos de variables que podrían importar. Considere el diseño de seguridad del automóvil. Los […]

IA para ayudar a los investigadores a ver el panorama más amplio de la biología celular | Parte del MIT

Estudiar la expresión genética en las células de un paciente con cáncer puede ayudar a los biólogos clínicos a comprender el origen del cáncer y predecir el éxito de diferentes tratamientos. Pero las células son complejas y contienen muchas capas, por lo que la forma en que el biólogo realiza las mediciones afecta los datos […]

¡Nano Banano 2 ya está aquí! Más pequeño, más rápido y más de ocasión

¡Nano Plátano! El maniquí de imagen que arrasó en el mundo acaba de ser eclipsado por… sí mismo. ¡Sí! Google lo hizo de nuevo. Posteriormente de establecer estándares con el divulgación de Nano plátano, están de regreso con su muy esperado seguimiento: Nano Banano 2 (designado oficialmente como Imagen Flash de Géminis 3.1). Este nuevo […]

El equipo Qwen de Alibaba lanceta la serie de modelos medianos Qwen 3.5: una potencia de producción que demuestra que los modelos de IA más pequeños son más inteligentes

El expansión de grandes modelos lingüísticos (LLM) se ha definido por la búsqueda de una escalera bruta. Si aceptablemente el aumento del número de parámetros en billones inicialmente impulsó ganancias de rendimiento, incluso introdujo importantes gastos generales de infraestructura y una utilidad insignificante decreciente. La exención del Serie de modelos medianos Qwen 3.5 señala un […]

Las funciones de personalización pueden hacer que los LLM sean más agradables | Parte del MIT

Muchos de los últimos modelos de jerigonza excelso (LLM) están diseñados para recapacitar detalles de conversaciones pasadas o acumular perfiles de heredero, lo que permite que estos modelos personalicen las respuestas. Pero investigadores del MIT y la Universidad Penn State descubrieron que, durante conversaciones largas, estas características de personalización a menudo aumentan la probabilidad de […]

Una prueba experiencia de la IA más nueva de Google

Solo 3 meses luego del divulgación de su maniquí de última procreación Gemini 3 Pro, Google DeepMind está aquí con su última lectura: Géminis 3.1 Pro. Una progreso radical en términos de capacidades y seguridad, el maniquí Gemini 3.1 Pro se esfuerza por ser accesible y operable por todos. Independientemente de sus preferencias, plataforma o […]

Comience más rápido con la incorporación con un solo clic, notebooks sin servidor y agentes de IA en Amazon SageMaker Unified Studio

Hoy en día, los equipos de datos luchan con herramientas fragmentadas, aprovisionamiento de infraestructura confuso y horas dedicadas a escribir código repetitivo para conectarse a fuentes de datos. Esto obliga a los analistas, científicos de datos e ingenieros a trabajar en entornos separados, lo que ralentiza la colaboración y el tiempo de fabricación de conocimientos. […]