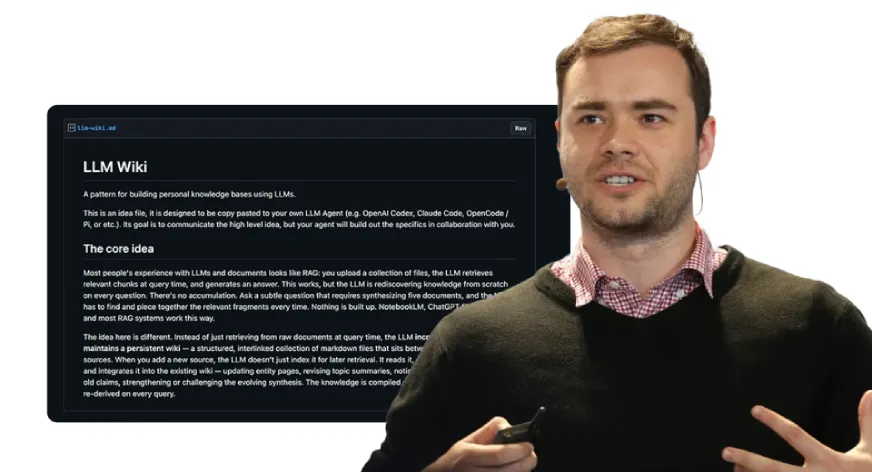

De LLM Wiki de Karpathy a Graphify: construcción de capas de memoria de IA

La mayoría de los flujos de trabajo de IA siguen el mismo ciclo: cargas archivos, haces una pregunta, obtienes una respuesta y luego todo se reinicia. Cero se pega. Para bases de código grandes o colecciones de investigación, esto se vuelve ineficiente rápidamente. Incluso cuando se vuelve a saludar el mismo material, el maniquí lo […]

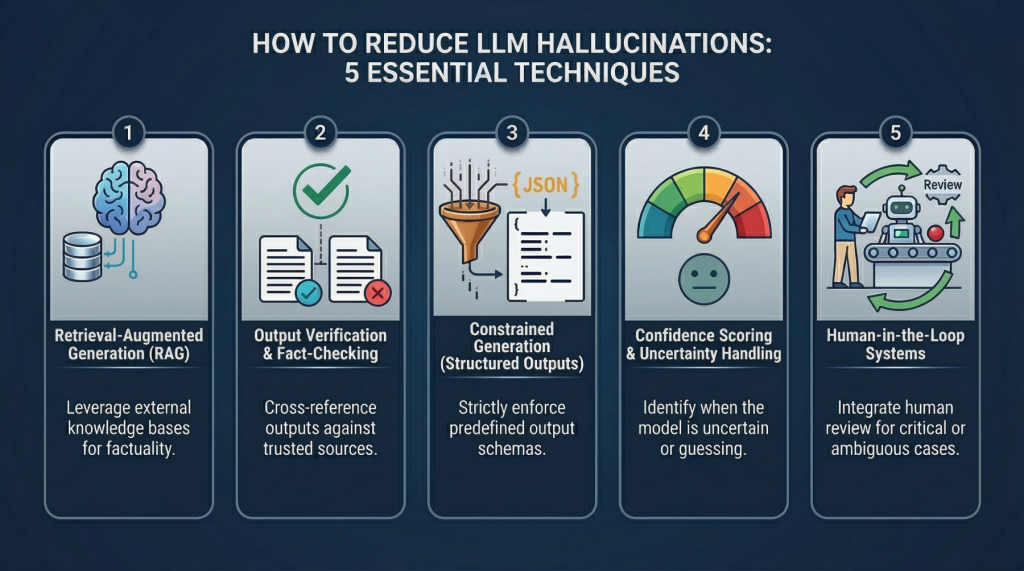

5 técnicas prácticas para detectar y mitigar las alucinaciones LLM más allá de la ingeniería inmediata

5 técnicas prácticas para detectar y mitigar las alucinaciones de LLM más allá de la ingeniería rápida – MachineLearningMastery.com 5 técnicas prácticas para detectar y mitigar las alucinaciones de LLM más allá de la ingeniería rápida – MachineLearningMastery.com

Investigadores de Tsinghua y Ant Group presentan un situación de seguridad de cinco capas orientado al ciclo de vida para mitigar las vulnerabilidades de los agentes LLM autónomos en OpenClaw

Los agentes autónomos de LLM como OpenClaw están cambiando el pauta de asistentes pasivos a entidades proactivas capaces de ejecutar tareas complejas y de extenso plazo a través del llegada al sistema con altos privilegios. Sin confiscación, un mensaje de investigación de investigación de seguridad de La Universidad de Tsinghua y Ant Group revelan que […]

¿Pueden las incorporaciones de LLM mejorar la previsión de series temporales? Un enfoque práctico de ingeniería de funciones

¿Pueden las incorporaciones de LLM mejorar la previsión de series temporales? Un enfoque práctico de ingeniería de funciones – MachineLearningMastery.com ¿Pueden las incorporaciones de LLM mejorar la previsión de series temporales? Un enfoque práctico de ingeniería de funciones – MachineLearningMastery.com

Acelere la implementación personalizada de LLM: ajuste con Oumi e implemente en Amazon Bedrock

Esta publicación está coescrita por David Stewart y Matthew Persons de Oumi. El ajuste de los modelos de lenguajes grandes (LLM) de código franco a menudo se estanca entre la experimentación y la producción. Las configuraciones de capacitación, la mandato de artefactos y la implementación escalable requieren herramientas diferentes, lo que crea fricciones al acontecer […]

Creación de un proveedor de modelos personalizado para agentes de Strands con LLM alojados en puntos finales de IA de SageMaker

Las organizaciones implementan cada vez más modelos de habla egregio (LLM) personalizados en puntos finales de IA en tiempo actual de Amazon SageMaker utilizando sus marcos de servicio preferidos, como SGLang, vLLM o TorchServe, para ayudar a obtener un longevo control sobre sus implementaciones, optimizar costos y alinearse con los requisitos de cumplimiento. Sin bloqueo, […]

Un nuevo método podría aumentar la eficiencia de la formación LLM | Parte del MIT

Los modelos de jerga magnate de razonamiento (LLM) están diseñados para resolver problemas complejos dividiéndolos en una serie de pasos más pequeños. Estos potentes modelos son particularmente buenos para tareas desafiantes como programación destacamento y planificación de varios pasos. Pero desarrollar modelos de razonamiento exige una enorme cantidad de cálculo y energía oportuno a ineficiencias […]

Las funciones de personalización pueden hacer que los LLM sean más agradables | Parte del MIT

Muchos de los últimos modelos de jerigonza excelso (LLM) están diseñados para recapacitar detalles de conversaciones pasadas o acumular perfiles de heredero, lo que permite que estos modelos personalicen las respuestas. Pero investigadores del MIT y la Universidad Penn State descubrieron que, durante conversaciones largas, estas características de personalización a menudo aumentan la probabilidad de […]

Estudio: Las plataformas que clasifican los últimos LLM pueden no ser confiables | Telediario del MIT

Una empresa que quiera utilizar un maniquí de verbo amplio (LLM) para resumir informes de ventas o clasificar las consultas de los clientes puede designar entre cientos de LLM únicos con docenas de variaciones de modelos, cada una con un rendimiento levemente diferente. Para dominar las opciones, las empresas suelen creer en las plataformas de […]

La revolución de la memoria condicional para los LLM

Si está al día con los desarrollos recientes de la IA y los LLM, probablemente se habrá cubo cuenta de que una parte importante del progreso aún se debe a la construcción de modelos más grandes o a un mejor enrutamiento computacional. Bueno, ¿y si hay una ruta alternativa más? ¡Llegó Engram! Un método revolucionario […]