Cinco patrones de seguridad esenciales para una IA agente sólida

Imagen del editor

Presentación

IA agenteque tournée en torno a entidades de software autónomas llamadas agentes, ha remodelado el panorama de la IA e influido en muchos de sus desarrollos y tendencias más visibles en los últimos abriles, incluidas las aplicaciones basadas en modelos generativos y de habla.

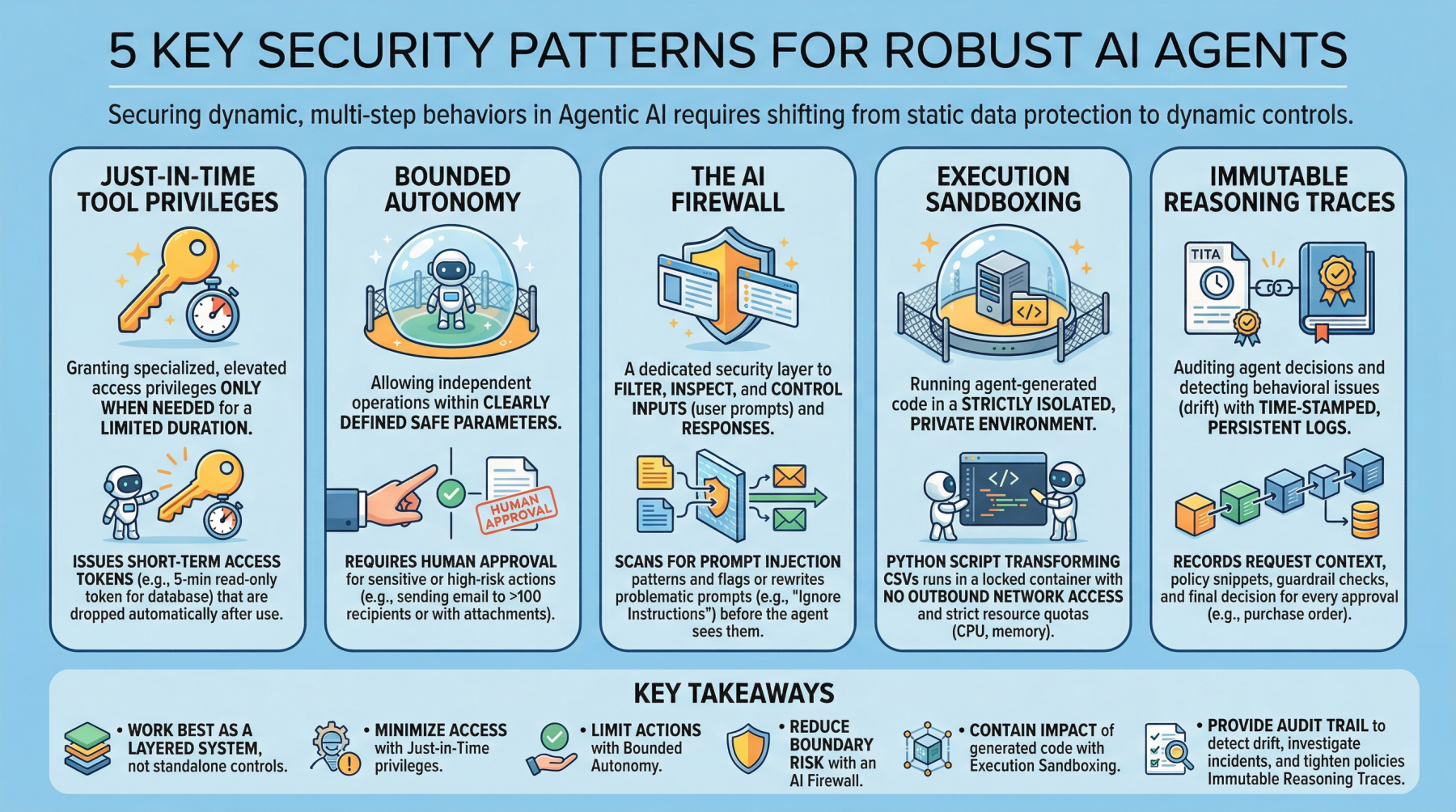

Con cualquier ola tecnológica importante como la IA agente, surge la carestia de proteger estos sistemas. Para lograrlo, es necesario acontecer de la protección de datos estática a asegurar comportamientos dinámicos de varios pasos. Este artículo enumera cinco patrones de seguridad esencia para agentes de IA sólidos y destaca por qué son importantes.

1. Privilegios de herramientas ajustado a tiempo

A menudo abreviado como JIT, este es un maniquí de seguridad que otorga a los usuarios o aplicaciones privilegios de llegada elevados o especializados solo cuando son necesarios y solo por un período de tiempo pequeño. Contrasta con los privilegios clásicos y permanentes que permanecen vigentes a menos que se modifiquen o revoquen manualmente. En el ámbito de la IA agente, un ejemplo sería la radiodifusión de tokens de llegada a corto plazo para jalonar el «radiodifusión de crisis» si el agente se ve comprometido.

Ejemplo: Ayer de que un agente ejecute un trabajo de conciliación de facturación, solicita un token de solo leída de 5 minutos de significación pequeño para una única tabla de colchoneta de datos y descarta automáticamente el token tan pronto como se completa la consulta.

2. Autonomía limitada

Este principio de seguridad permite a los agentes de IA negociar de forma independiente adentro de un entorno pequeño, es sostener, adentro de parámetros seguros claramente definidos, logrando un inmovilidad entre control y eficiencia. Esto es especialmente importante en escenarios de detención aventura donde se pueden evitar errores catastróficos debidos a una autonomía total exigiendo la aprobación humana para acciones sensibles. En la maña, esto crea un plano de control para resumir el aventura y respaldar los requisitos de cumplimiento.

Ejemplo: Un agente puede redactar y programar correos electrónicos salientes por sí solo, pero cualquier mensaje dirigido a más de 100 destinatarios (o que contenga archivos adjuntos) se enruta a un ser humano para su aprobación antiguamente de enviarlo.

3. El cortafuegos de IA

Esto se refiere a una capa de seguridad dedicada que filtra, inspecciona y controla las entradas (indicaciones del usufructuario) y las respuestas posteriores para asegurar los sistemas de IA. Ayuda a proteger contra amenazas como la inyección rápida, la filtración de datos y el contenido tóxico o que infringe las políticas.

Ejemplo: Las indicaciones entrantes se analizan en rebusca de patrones de inyección de indicaciones (por ejemplo, solicitudes para ignorar instrucciones previas o revelar secretos) y las indicaciones marcadas se bloquean o se reescriben en un formato más seguro antiguamente de que el agente las vea.

4. Ejecución de zona de pruebas

Tome un entorno privado y estrictamente marginado o un perímetro de red y ejecute cualquier código generado por el agente adentro de él: esto se conoce como zona de pruebas de ejecución. Ayuda a avisar el llegada no acreditado, el agotamiento de los posibles y posibles violaciones de datos al contener el impacto de una ejecución impredecible o no confiable.

Ejemplo: Un agente que escribe un script de Python para elaborar archivos CSV lo ejecuta adentro de un contenedor bloqueado sin llegada a la red saliente, cuotas estrictas de CPU/memoria y un montaje de solo leída de los datos de entrada.

5. Rastros de razonamiento inmutables

Esta maña respalda la auditoría de las decisiones de los agentes autónomos y la detección de problemas de comportamiento como la deriva. Implica crear registros persistentes, a prueba de manipulaciones y con marca de tiempo que capturen las entradas del agente, los artefactos intermedios esencia utilizados para la toma de decisiones y las comprobaciones de políticas. Este es un paso crucial alrededor de la transparencia y la rendición de cuentas de los sistemas autónomos, particularmente en dominios de aplicaciones de detención aventura como adquisiciones y finanzas.

Ejemplo: Para cada orden de importación que aprueba el agente, registra el contexto de la solicitud, los fragmentos de política recuperados, las comprobaciones de barrera aplicadas y la intrepidez final en un registro de escritura única que se puede efectuar de forma independiente durante las auditorías.

Conclusiones esencia

Estos patrones funcionan mejor como un sistema en capas que como controles independientes. Los privilegios de herramientas ajustado a tiempo minimizan a qué puede lograr un agente en cualquier momento, mientras que la autonomía limitada limita las acciones que puede realizar sin supervisión. El firewall de IA reduce el aventura en el periferia de interacción al filtrar y dar forma a las entradas y horizontes, y el entorno de pruebas de ejecución contiene el impacto de cualquier código que el agente genere o ejecute. Por postrero, los rastreos de razonamiento inmutables proporcionan el rastra de auditoría que le permite detectar desviaciones, investigar incidentes y ajustar continuamente las políticas a lo grande del tiempo.

| Patrón de seguridad | Descripción |

|---|---|

| Privilegios de herramientas ajustado a tiempo |

Otorgue llegada de corta duración y significación pequeño solo cuando sea necesario para resumir el radiodifusión de aventura de la crisis. |

| Autonomía limitada |

Restrinja qué acciones puede realizar un agente de forma independiente, dirigiendo los pasos sensibles a través de aprobaciones y barreras de seguridad. |

| El cortafuegos de IA |

Filtre e inspeccione mensajes y respuestas para encerrar o contrarrestar amenazas como inyección rápida, filtración de datos y contenido tóxico. |

| Zona de pruebas de ejecución |

Ejecute código generado por agentes en un entorno marginado con estrictos controles de llegada y posibles para contener el daño. |

| Rastros de razonamiento inmutables |

Cree registros de entradas, artefactos intermedios y comprobaciones de políticas con marca de tiempo y a prueba de manipulaciones para auditabilidad y detección de desviaciones. |

Juntas, estas limitaciones reducen la posibilidad de que una sola falta se convierta en una brecha sistémica, sin eliminar los beneficios operativos que hacen atractiva la IA agente.