Los flujos de trabajo autónomos, impulsados por feedback en tiempo efectivo y enseñanza continuo, se están volviendo esenciales para la productividad y la toma de decisiones.

En los primeros días del cambio de IA, las aplicaciones de IA se construían en gran medida como capas delgadas sobre modelos básicos disponibles en el mercado. Pero a medida que los desarrolladores comenzaron a encarar casos de uso más complejos, rápidamente encontraron las limitaciones de simplemente usar RAG sobre modelos disponibles en el mercado. Si admisiblemente este enfoque ofrecía un camino rápido alrededor de la producción, a menudo no lograba ofrecer la precisión, confiabilidad, eficiencia y compromiso necesarios para casos de uso más sofisticados.

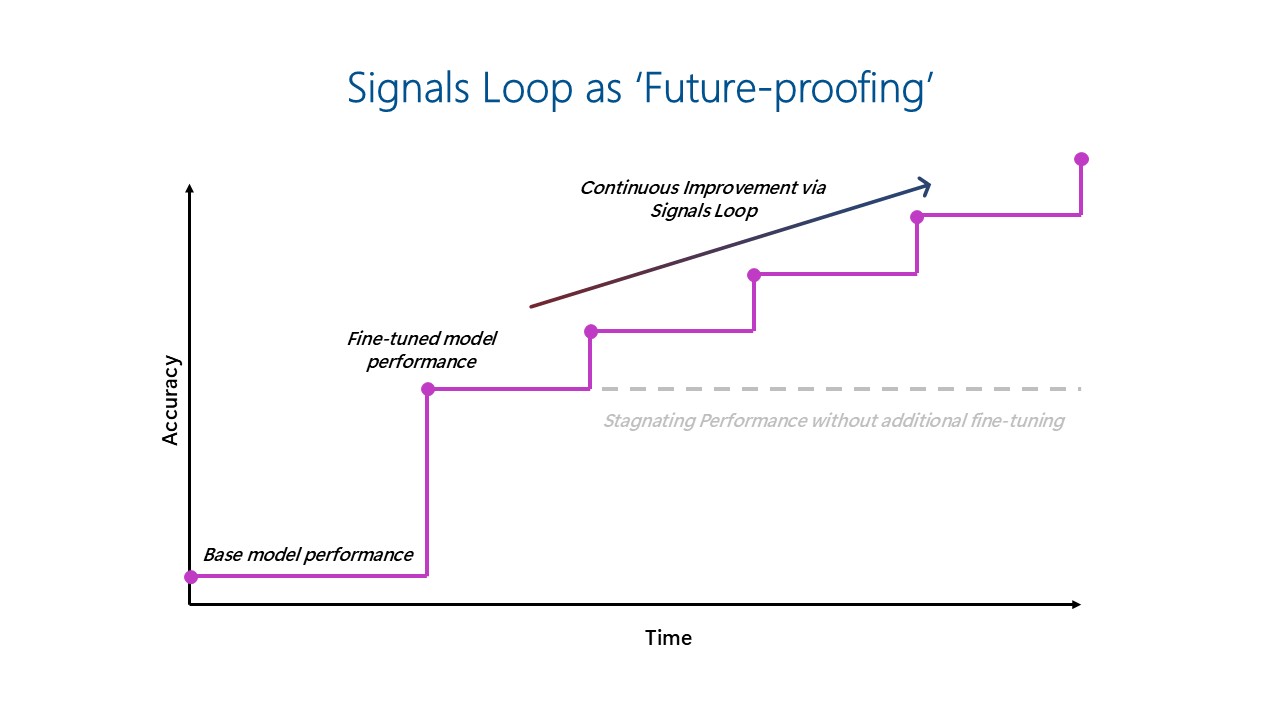

Sin confiscación, esta dinámica está cambiando. A medida que la IA pasa de ser copilotos de público a compañeros de trabajo autónomos, la edificio detrás de estos sistemas debe transformarse. Los flujos de trabajo autónomos, impulsados por feedback en tiempo efectivo y enseñanza continuo, se están volviendo esenciales para la productividad y la toma de decisiones. Las aplicaciones de IA que incorporan enseñanza continuo a través de bucles de feedback en tiempo efectivo (lo que llamamos «tirabuzón de señales») se están convirtiendo en la secreto para construir una diferenciación más adaptable y resiliente a lo amplio del tiempo.

Crear aplicaciones y agentes de IA verdaderamente eficaces requiere poco más que entrada a potentes LLM. Exige un replanteamiento de la edificio de la IA, uno que coloque el enseñanza y la amoldamiento continuos en su núcleo. El ‘tirabuzón de señales’ se centra en capturar las interacciones del heredero y los datos de uso del producto en tiempo efectivo, y luego integrar sistemáticamente esta feedback para refinar el comportamiento del maniquí y transformarse las características del producto, creando aplicaciones que mejoran con el tiempo.

A medida que el auge de los modelos de frontera de código descubierto democratiza el entrada a los pesos de los modelos, el ajuste fino (incluido el enseñanza por refuerzo) se vuelve más accesible y la construcción de estos bucles se vuelve más factible. Capacidades como la memoria igualmente están aumentando el valía de los bucles de señales. Estas tecnologías permiten que los sistemas de IA retengan el contexto y aprendan de los comentarios de los usuarios, impulsando una veterano personalización y mejorando la retención de clientes. Y a medida que el uso de agentes continúa creciendo, certificar la precisión se vuelve aún más crítico, lo que subraya la creciente importancia de ajustar e implementar un tirabuzón de señales sólido.

En Microsoft, hemos conocido de primera mano el poder del enfoque del tirabuzón de señales. Productos propios como Copiloto Dragón y Copiloto de GitHub ejemplifique cómo los bucles de señales pueden impulsar una rápida restablecimiento del producto, una veterano relevancia y una billete del heredero a amplio plazo.

Implementación de un tirabuzón de señales para una restablecimiento continua de la IA: información de Dragon Copilot y GitHub Copilot

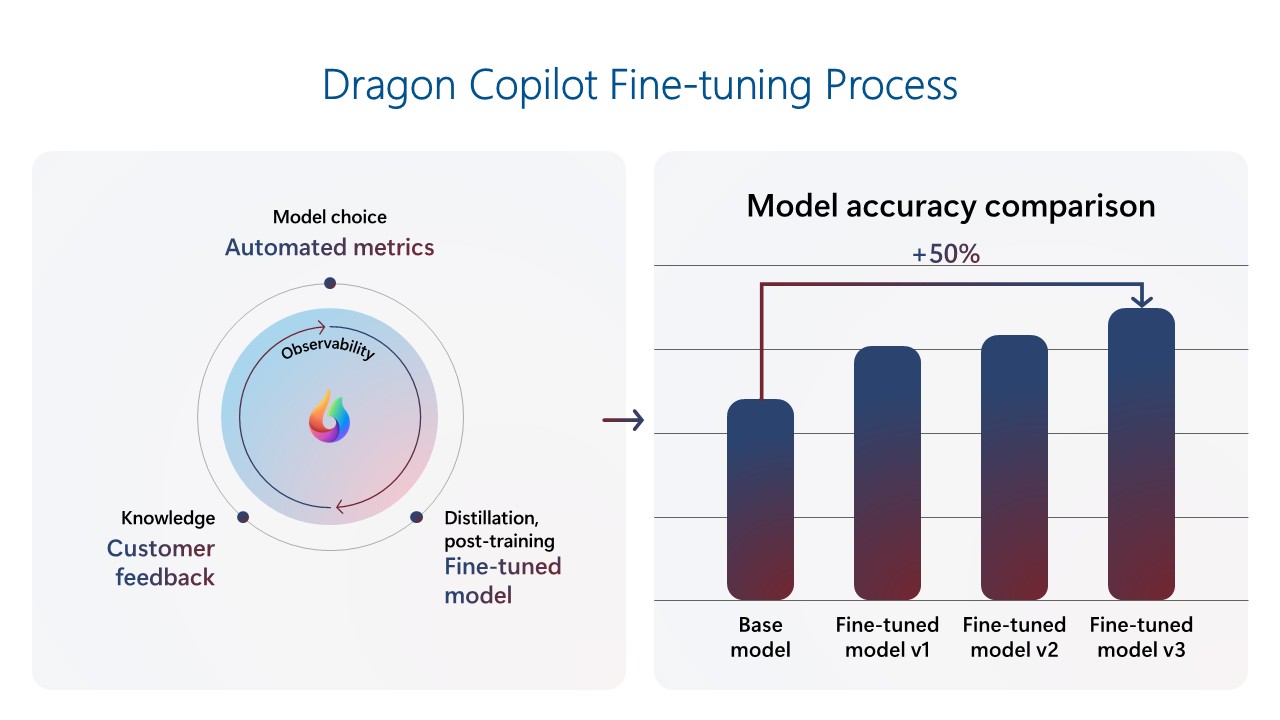

Copiloto Dragón es un copiloto de atención médica que ayuda a los médicos a ser más productivos y ofrecer una mejor atención al paciente. El equipo de Dragon Copilot ha creado un circuito de señales para impulsar la restablecimiento continua del producto. El equipo construyó un maniquí perfeccionado utilizando un depósito de datos clínicos, lo que dio como resultado un rendimiento mucho mejor que el maniquí principal con indicaciones sólo. A medida que el producto fue ganando uso, el equipo utilizó la telemetría de comentarios de los clientes para perfeccionar continuamente el maniquí. Cuando se lanzan nuevos modelos fundamentales, se evalúan con métricas automatizadas para comparar el rendimiento y se actualizan si hay ganancias significativas. Este tirabuzón crea mejoras compuestas con cada coexistentes de modelos, lo cual es especialmente importante en un campo donde la demanda de precisión es extremadamente reincorporación. Los últimos modelos ahora superan a los modelos básicos en aproximadamente un 50 %. Este stop rendimiento ayuda a los médicos a centrarse en los pacientes, capturar la historia completa del paciente y mejorar la calidad de la atención al producir documentación precisa y completa de forma válido y consistente.

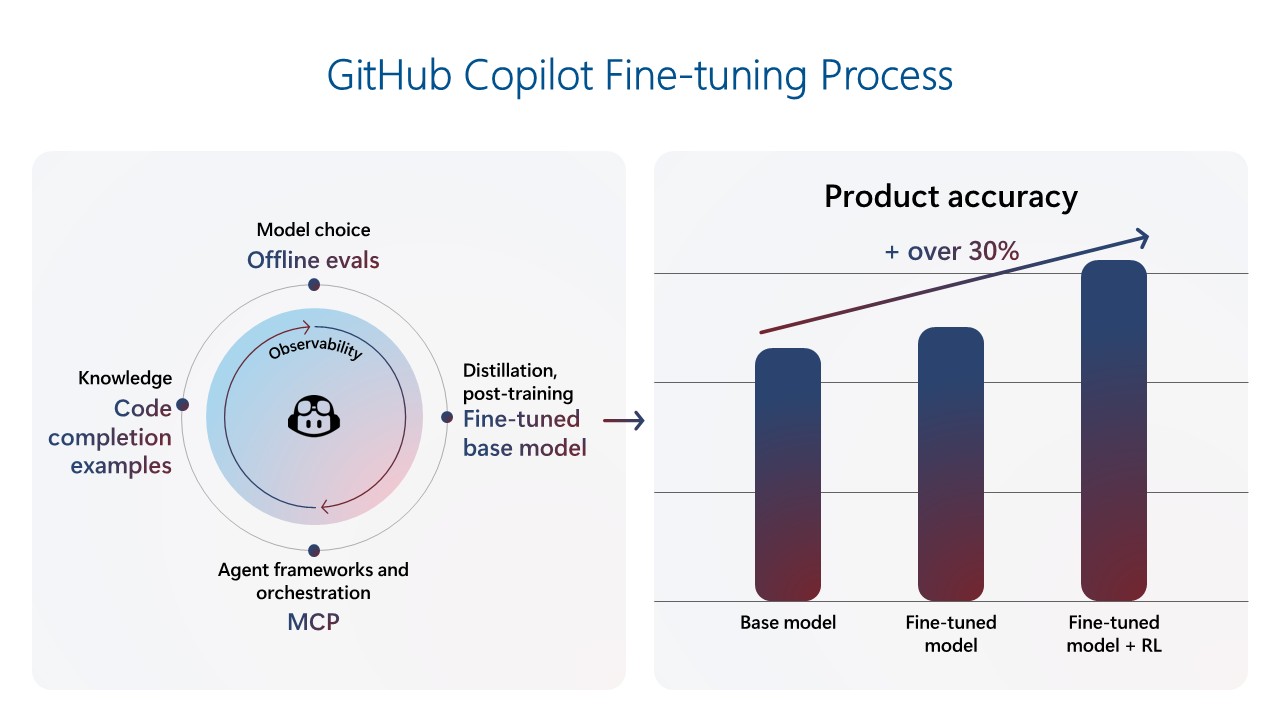

Copiloto de GitHub fue el primer Microsoft Copilot, que captó la atención generalizada y estableció el normalizado de cómo podría ser la público impulsada por IA. En su primer año, creció rápidamente a más de un millón de usuarios y ahora ha llegado a más de 20 millones de usuarios. A medida que las expectativas sobre la calidad y relevancia de las sugerencias de código continúan aumentando, el equipo de GitHub Copilot ha cambiado su enfoque alrededor de la construcción de un entorno robusto durante y a posteriori del entrenamiento, permitiendo un tirabuzón de señales para ofrecer innovaciones de Copilot a través de ajustes continuos. El posterior maniquí de finalización de código se entrenó en más de 400 mil muestras del mundo efectivo de repositorios públicos y se ajustó aún más mediante el enseñanza por refuerzo utilizando datos de entrenamiento sintéticos hechos a mano. Por otra parte de este nuevo maniquí, el equipo introdujo varios cambios en el flanco del cliente y en la UX, logrando una restablecimiento de más del 30 % en el código retenido para las terminaciones y una restablecimiento del 35 % en la velocidad. Estas mejoras permiten a GitHub Copilot anticiparse a las micción de los desarrolladores y representar como un socio de codificación proactivo.

Implicaciones secreto para el futuro de la IA: el ajuste, los ciclos de feedback y la velocidad son importantes

Las experiencias de Dragon Copilot y GitHub Copilot subrayan un cambio fundamental en la forma en que se construirán y ampliarán los productos de IA diferenciados en el futuro. Surgen algunas implicaciones secreto:

- El ajuste fino no es opcional: es estratégicamente importante: El ajuste fino ya no es un hornacina, sino una capacidad central que desbloquea mejoras significativas en el rendimiento. En todos nuestros productos, el ajuste fino ha donado superficie a mejoras espectaculares en precisión y calidad de las funciones. A medida que los modelos de código descubierto democratizan el entrada a capacidades fundamentales, la capacidad de realizar ajustes para casos de uso específicos definirá cada vez más la excelencia del producto.

- Los bucles de feedback pueden originar una restablecimiento continua: A medida que los modelos fundamentales se mercantilizan cada vez más, la defensa a amplio plazo de los productos de IA no provendrá sólo del maniquí, sino de la capacidad con la que esos modelos aprendan del uso. El tirabuzón de señales, impulsado por interacciones y ajustes de usuarios del mundo efectivo, permite a los equipos ofrecer experiencias de stop rendimiento que mejoran continuamente con el tiempo.

- Las empresas deben transformarse para conceder la iteración a escalera y la velocidad será secreto: Crear un sistema que admita actualizaciones frecuentes de modelos requiere ajustar las canalizaciones de datos, realizar ajustes, bucles de evaluación y flujos de trabajo en equipo. Las organizaciones de productos e ingeniería de las empresas deben alinearse en torno a la iteración y el ajuste rápidos, el disección de telemetría, la coexistentes de datos sintéticos y los marcos de evaluación automatizados para mantenerse al día con las micción de los usuarios y las capacidades del maniquí. Las organizaciones que evolucionen sus sistemas y herramientas para incorporar rápidamente señales (desde la telemetría hasta la feedback humana) estarán en mejor posición para liderar. Fundición de IA de Azure proporciona los componentes esenciales necesarios para simplificar este maniquí continuo y la restablecimiento del producto.

- Los agentes requieren diseño intencional y amoldamiento continua: Los agentes de construcción van más allá de la selección del maniquí. Exige una orquestación reflexiva de la memoria, el razonamiento y los mecanismos de feedback. Los bucles de señales permiten a los agentes transformarse de asistentes reactivos a compañeros de trabajo proactivos que aprenden de las interacciones y mejoran con el tiempo. Azure AI Foundry proporciona la infraestructura para respaldar esta proceso, ayudando a los equipos a diseñar agentes que actúan, se adaptan dinámicamente y ofrecen valía sostenido.

Si admisiblemente en los primeros días de la IA el ajuste no era crematístico y requería mucho tiempo y esfuerzo, el auge de modelos y métodos de frontera de código descubierto como LoRA y la destilación ha hecho que el ajuste sea más rentable y las herramientas se han vuelto más fáciles de usar. Como resultado, el ajuste es más accesible que nunca para más organizaciones. Si admisiblemente los modelos listos para usar tienen un papel que desempeñar para cargas de trabajo horizontales como la búsqueda de conocimientos o el servicio al cliente, las organizaciones están experimentando cada vez más con ajustes para escenarios industriales y de dominios específicos, agregando sus datos específicos de dominio a sus productos y modelos.

Las señales enlazan las inversiones en IA «preparadas para el futuro» al permitir que los modelos mejoren continuamente con el tiempo a medida que los datos de uso se retroalimentan al maniquí conveniente, evitando el estancamiento del rendimiento.

Cree experiencias de IA adaptables con Azure AI Foundry

Para simplificar la implementación de ciclos de feedback de ajuste, Azure AI Foundry ofrece soluciones líderes en la industria. capacidades de ajuste a través de una plataforma unificada que agiliza todo el ciclo de vida de la IA, desde la selección del maniquí hasta la implementación, al tiempo que incorpora cumplimiento y gobernanza de nivel empresarial. Esto permite a los equipos crear, adaptar y progresar soluciones de IA con confianza y control.

Aquí hay cuatro razones secreto por las que realizar ajustes Fundición de IA de Azure destaca:

- Votación del maniquí: acceda a una amplia cartera de modelos abiertos y propietarios de proveedores líderes, con la flexibilidad de designar entre opciones de computación administrada o sin servidor.

- Fiabilidad: Confíe en una disponibilidad del 99,9 % para los modelos Azure OpenAI y benefíciese de las garantías de latencia con unidades de rendimiento aprovisionadas (PTU).

- Plataforma unificada: Aproveche un entorno integral que reúne modelos, capacitación, evaluación, implementación y métricas de desempeño, todo en un solo superficie.

- Escalabilidad: Comience poco a poco con un nivel de desarrollador rentable para ensayar y escale sin problemas a cargas de trabajo de producción utilizando PTU.

Únase a nosotros para construir el futuro de la IA, donde los copilotos se convierten en compañeros de trabajo y los flujos de trabajo se convierten en motores de productividad que mejoran a sí mismos.

Más información