Optimización de la búsqueda vectorial utilizando los vectores de Amazon S3 y el servicio de Amazon OpenSearch

Nota: A partir del 15 de julio, la integración de vectores de Amazon S3 con Amazon OpenSearch Service está en la interpretación previa y está sujeta a cambios. La forma en que almacenamos y buscamos a través de los datos está evolucionando rápidamente con el avance de Incruscaciones vectoriales y capacidades de búsqueda de similitud. […]

Meta AI propone atención múltiple (MTA): un nuevo método de atención que permite a los LLM habilitar sus pesos de atención en múltiples consultas y vectores secreto

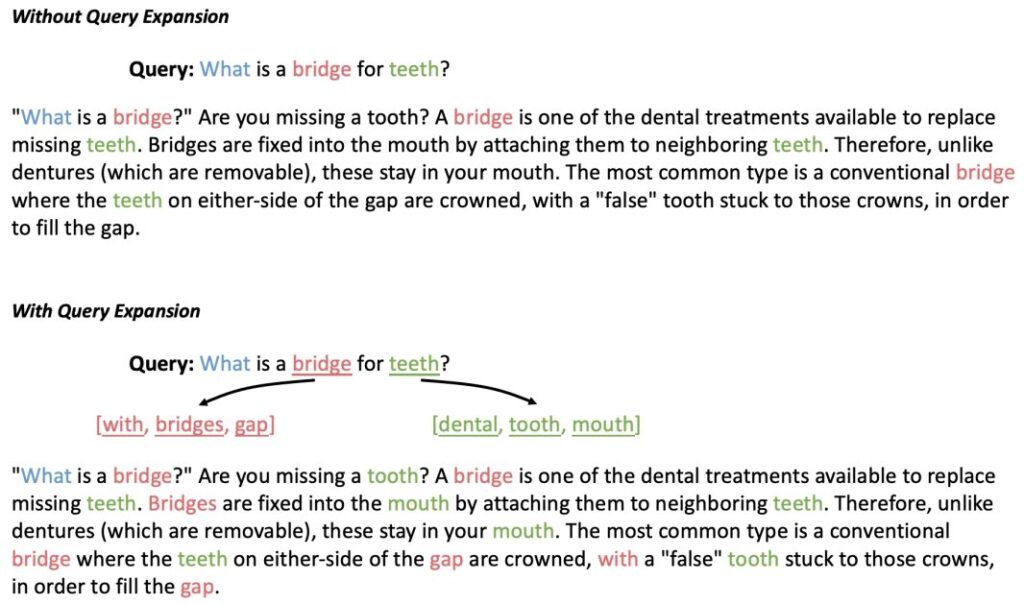

Los modelos de verbo conspicuo (LLM) se benefician significativamente de los mecanismos de atención, lo que permite la recuperación efectiva de la información contextual. Sin secuestro, los métodos de atención tradicionales dependen principalmente de la atención de un solo token, donde cada peso de atención se calcula a partir de un solo par de consultas […]

Genere incrustaciones de vectores para sus datos utilizando AWS Lambda como procesador para Amazon OpenSearch Ingestion

El 22 de noviembre de 2024, incorporación de Amazon OpenSearch arrojado soporte para procesadores AWS Lambda. Con este tirada, ahora tiene más flexibilidad para enriquecer y alterar sus registros, métricas y datos de seguimiento en una canalización de OpenSearch Ingestion. Algunos ejemplos incluyen el uso de modelos básicos (FM) para ocasionar incrustaciones de vectores para […]

Integre vectores dispersos y densos para mejorar la recuperación de conocimiento en RAG utilizando Amazon OpenSearch Service

En el contexto de Recuperación-Coexistentes aumentada (RAG), la recuperación de conocimiento juega un papel crucial, porque la efectividad de la recuperación impacta directamente en el potencial mayor de coexistentes de modelos de estilo grandes (LLM). En la contemporaneidad, en la recuperación de RAG, el enfoque más popular es utilizar la búsqueda semántica basada en vectores […]