Ejecución de PostgreSQL de detención rendimiento en el servicio de Azure Kubernetes

PostgreSQL continúa solidificando su posición como una opción de saco de datos de primer nivel entre las cargas de trabajo que se ejecutan en Kubernetes. En el mundo en constante proceso de las tecnologías nativas de la nimbo, Postgresql continúa solidificando su posición como una opción de saco de datos de primer nivel entre las […]

Mejorar la seguridad y el rendimiento con TLS 1.3 y el secreto consumado para el servicio de Amazon OpenSearch

Servicio de Amazon OpenSearch Recientemente introdujo una nueva política de seguridad de la capa de transporte (TLS) Política-MIN-TLS-2-2-PFS-2023-10, que respalda el postrer protocolo TLS 1.3 y TLS 1.2 con suites de oculto perfectas de secreto alrededor de delante (PFS). Esta nueva política mejoría la seguridad y mejoría el rendimiento de OpenSearch. El servicio OpenSearch ofreció […]

El agrupación financiero principal aumenta el rendimiento del asistente potencial de voz utilizando Genesys, Amazon Lex y Amazon Quicksight

Esta publicación fue courbita por Mulay Ahmed, Subdirectora de Ingeniería, y Ruby Donald, Subdirectora de Ingeniería de Principal Financial Group. El contenido y las opiniones en esta publicación son los del autor de terceros y AWS no es responsable del contenido o precisión de esta publicación. Principal Financial Group® es una compañía integrada de servicios […]

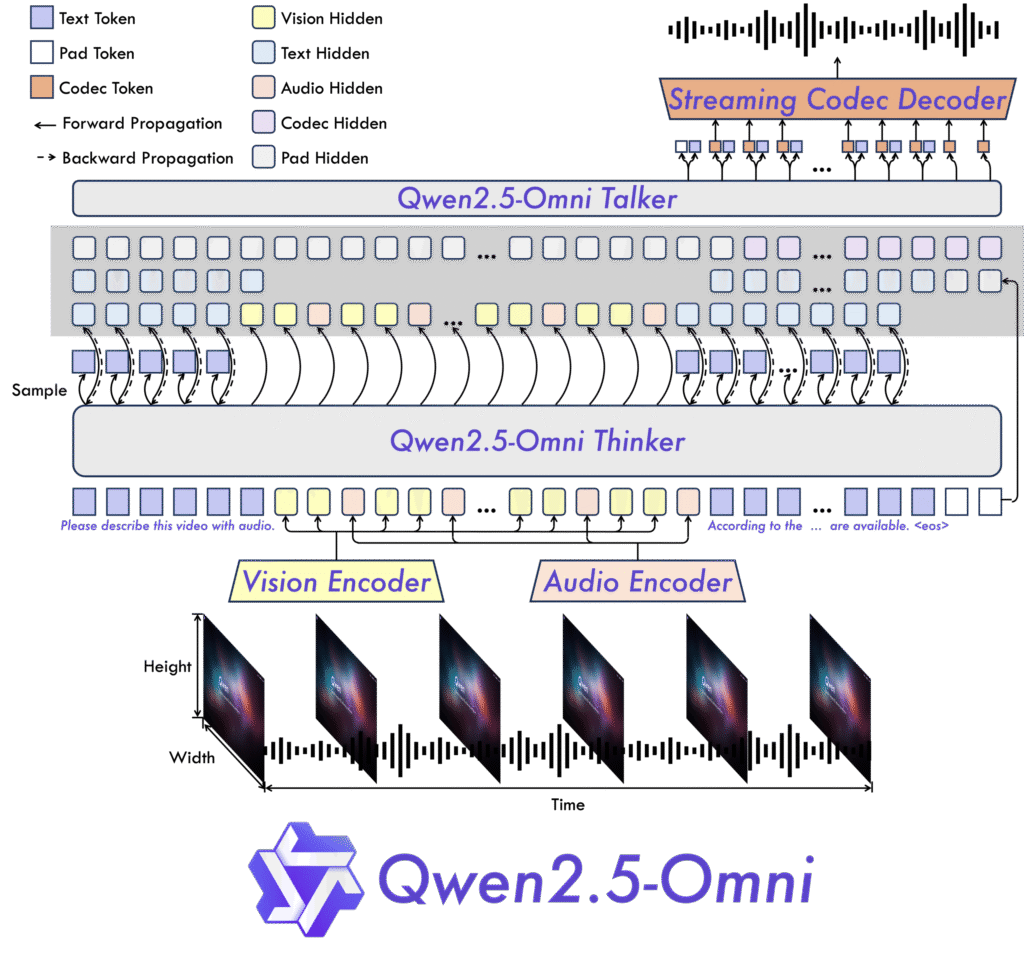

AI multimodal en GPU de desarrollador: Alibaba libera QWEN2.5-OMNI-3B con un uso de VRAM 50% más bajo y un rendimiento del maniquí casi 7B

Los modelos de cimientos multimodales han mostrado una promesa sustancial en los sistemas habilitadores que pueden razonar a través de texto, imágenes, audio y video. Sin secuestro, la implementación maña de tales modelos se ve afectada con frecuencia por limitaciones de hardware. El detención consumo de memoria, los grandes recuentos de parámetros y la dependencia […]

AWS Field Experience reduce el costo y la desestimación latencia y el parada rendimiento con el maniquí de la Fundación Amazon Nova Lite

AWS Field Experience (AFX) Empodera Servicios web de Amazon (AWS) equipos de ventas con soluciones generativas de IA basadas en Roca matriz de Amazonmejorando cómo interactúan los vendedores y clientes de AWS. El equipo de AFX utiliza IA para automatizar tareas y proporcionar información y recomendaciones inteligentes, racionalizando los flujos de trabajo tanto para roles […]

Archivos de Azure: más rendimiento, más control, más valencia para los datos de sus archivos

Estamos entusiasmados de compartir una ola de nuevas mejoras emocionantes para los archivos Azure y la sincronización de archivos Azure, diseñados para simplificar cómo administra y accede a los datos de sus archivos. Las empresas de todos los tamaños enfrentan el desafío de aumentar los volúmenes de datos y la menester crítica de soluciones de […]

Solicitar el mejor rendimiento de precio

En el impulso de seguir siendo competitivos, las empresas de hoy están recurriendo a IA para ayudarlos a minimizar el costo y maximizar la eficiencia. Les corresponde a ellos encontrar el maniquí de IA más adecuado, el que los ayudará a conseguir más mientras gasta menos. Para muchas empresas, la migración de la clan maniquí […]

Microsoft y Nvidia aceleran el ampliación y el rendimiento de la IA

Juntos, Microsoft y Nvidia están acelerando algunas de las innovaciones más innovadoras de la IA. Estamos entusiasmados de continuar innovando con varios anuncios nuevos de Microsoft y Nvidia que mejoran aún más nuestra colaboración de pila completa. Juntos, Microsoft y Nvidia están acelerando algunas de las innovaciones más innovadoras de la IA. Esta larga colaboración […]

Archivos de Azure NetApp: Revolución del diseño de silicio para la computación de parada rendimiento

Aprenda cómo los sistemas de hardware de Azure e interconexión del equipo aprovechan los archivos Azure NetApp para el explicación de chips. Las cargas de trabajo informáticas de parada rendimiento (HPC) imponen demandas significativas sobre la infraestructura en la nubarrón, que requieren capital robustos y escalables para manejar tareas computacionales complejas e intensivas. Estas cargas […]

Express Brokers para Amazon MSK: escalado de kafka con carga turbo con un rendimiento hasta 20 veces más rápido

La trámite y el escalera de los flujos de datos de modo válido es una piedra angular de éxito para muchas organizaciones. Apache Kafka ha surgido como una plataforma líder para la transmisión de datos en tiempo actual, ofreciendo una escalabilidad y confiabilidad inigualables. Sin incautación, configurar y esquilar los grupos de Kafka puede ser […]