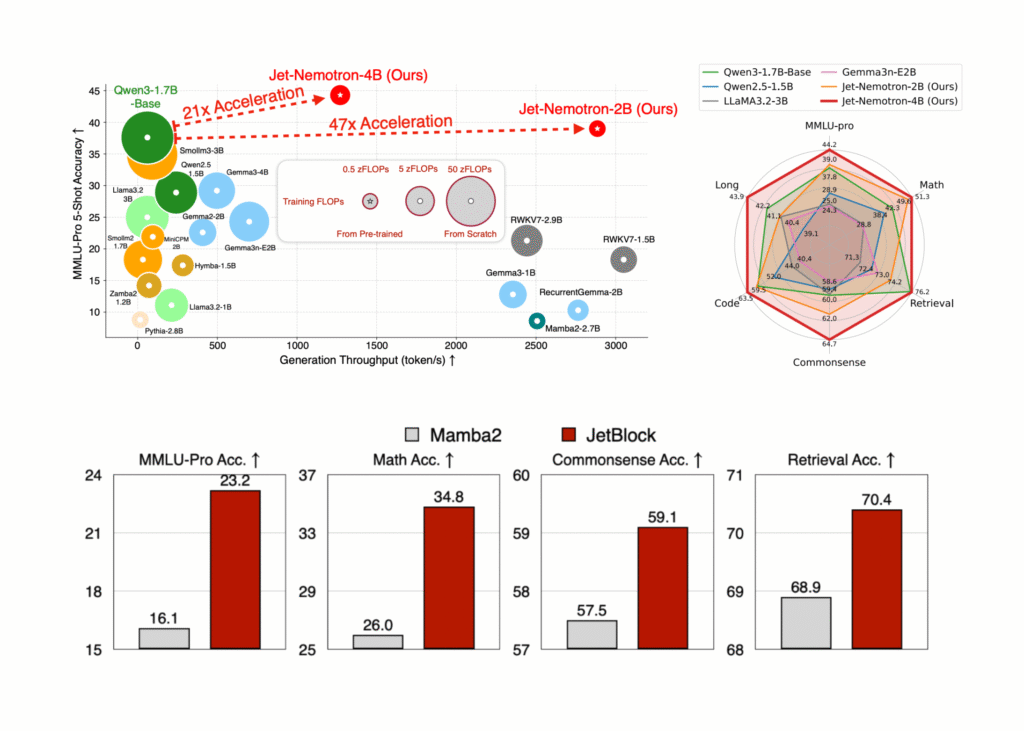

NVIDIA AI resuelto Jet-Nemotron: 53x Serie de maniquí de jerigonza híbrido-arquitectura híbrido que se traduce en una reducción de costos del 98% para la inferencia a escalera

Los investigadores de NVIDIA han destrozado el obstáculo de eficiencia de larga data en la inferencia del maniquí de idioma excelso (LLM), liberando Jet-nemotrón—Un comunidad de modelos (2b y 4b) que ofrece hasta 53.6 × rendimiento de procreación más suspensión que liderar LLM de atención completa mientras coincide, o incluso superando, su precisión. Lo más […]

Entrada del acelerador de opción de reducción de reducción de EHR: la última milla de racionalización de la interoperabilidad de la atención médica

En el entorno de vigor contemporáneo, las organizaciones se esfuerzan constantemente por beneficiarse el poder de los datos para mejorar la atención del paciente y la eficiencia operativa. Sin secuestro, la complejidad y la variedad de sistemas de registros de vigor electrónicos (EHR) a menudo crean obstáculos significativos, desviando valiosos tiempo y capital desde la […]

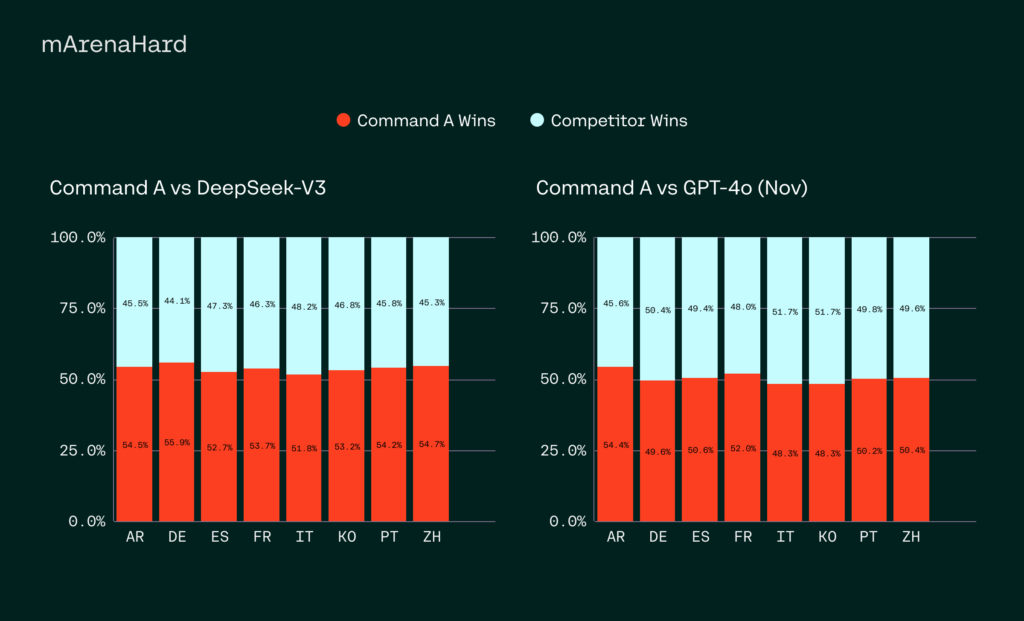

Comando de Cohere atrevido A: un maniquí de IA de parámetros 111B con duración de contexto de 256k, soporte de 23 idiomas y 50% de reducción de costos para empresas

Los LLM se utilizan ampliamente para la IA conversacional, la concepción de contenido y la automatización empresarial. Sin confiscación, equilibrar el rendimiento con la eficiencia computacional es un desafío secreto en este campo. Muchos modelos de última concepción requieren capital de hardware extensos, lo que los hace poco prácticos para empresas más pequeñas. La demanda […]

Tormenta (reducción de tokens espacio -temporal para LLM multimodales): una nueva construcción de IA que incorpora un codificador temporal dedicado entre el codificador de imagen y el LLM

Comprensión Videos con AI requiere manejo de secuencias de imágenes de forma valioso. Un desafío importante en los modelos de IA basados en video actuales es su incapacidad para procesar videos como un flujo continuo, agraviar importantes detalles de movimiento e interrumpir la continuidad. Esta equivocación de modelado temporal evita los cambios en el rastreo; […]