NVIDIA AI publica Universal Deep Research (UDR): un situación prototipo para agentes de investigación profunda escalable y auditable

¿Por qué las herramientas de investigación profundas existentes se quedan cortas? Las herramientas de investigación profunda (DRTS) como Gemini Deep Research, Perplexity, OpenAI’s Deep Research y Grok DeepSearch dependen de flujos de trabajo rígidos vinculados a una LLM fija. Si aceptablemente son efectivos, imponen limitaciones estrictas: los usuarios no pueden puntualizar estrategias personalizadas, modelos de […]

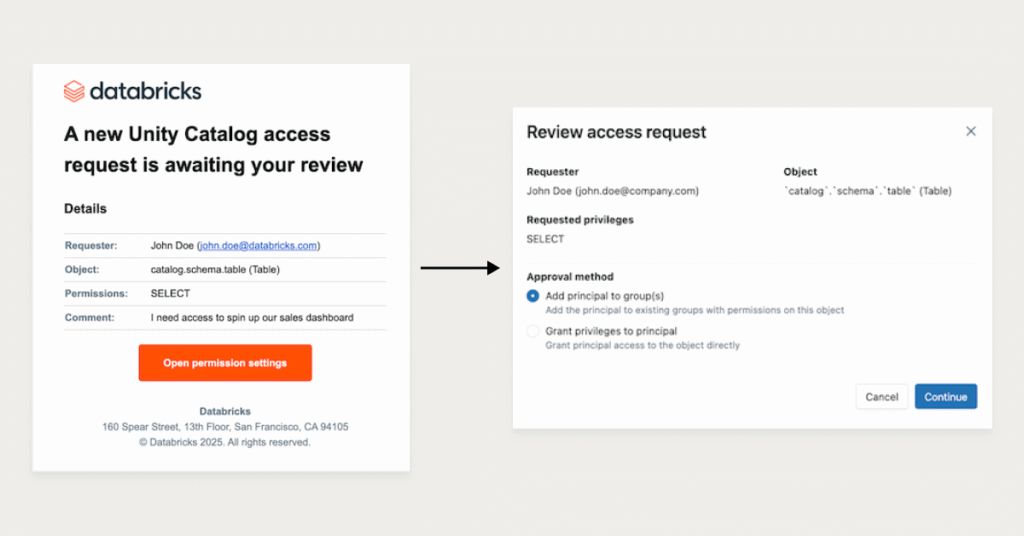

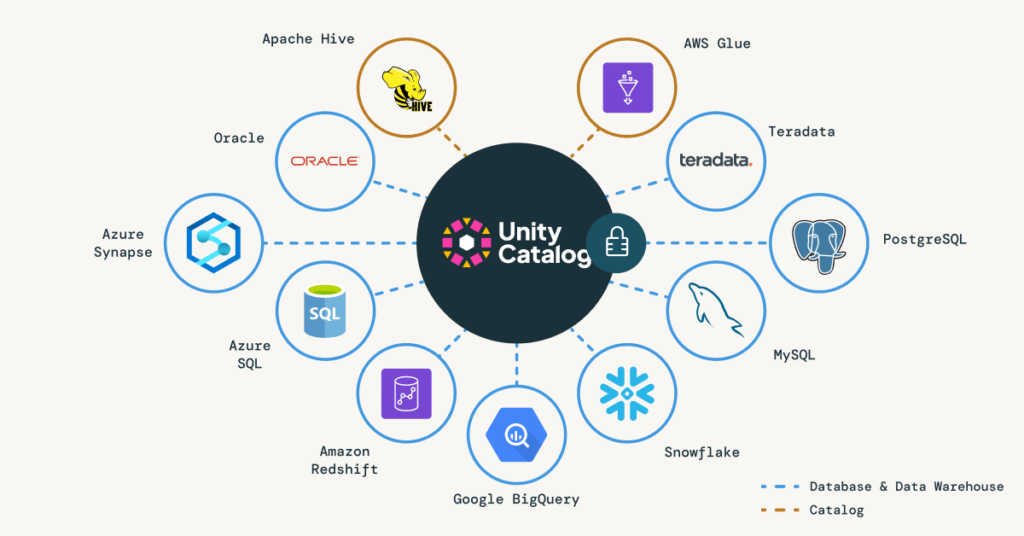

Anunciando la sagacidad previa pública de la solicitud de ataque en el catálogo de Unity

Uno de los mayores desafíos en las empresas conscientes de la seguridad es Obtener ataque oportuno a los datos correctos. Los propietarios de datos a menudo hacen malabarismos con una avalancha de solicitudes, mientras que los consumidores de datos esperan días, o incluso semanas, para aprobar, desacelerar el estudio y la toma de decisiones. Con […]

Snowpark Connect para Apache Spark ™ en paisaje previa pública

En la traducción 3.4, la comunidad Apache Spark ™ introdujo Spark Connect. Su edificación de servidor cliente desacoplada separa el código del adjudicatario del clúster Spark donde se realiza el trabajo. Esta nueva edificación ahora permite ejecutar su código de chispa en un almacén de copos de cocaína que elimina la aprieto de aprovisionar y […]

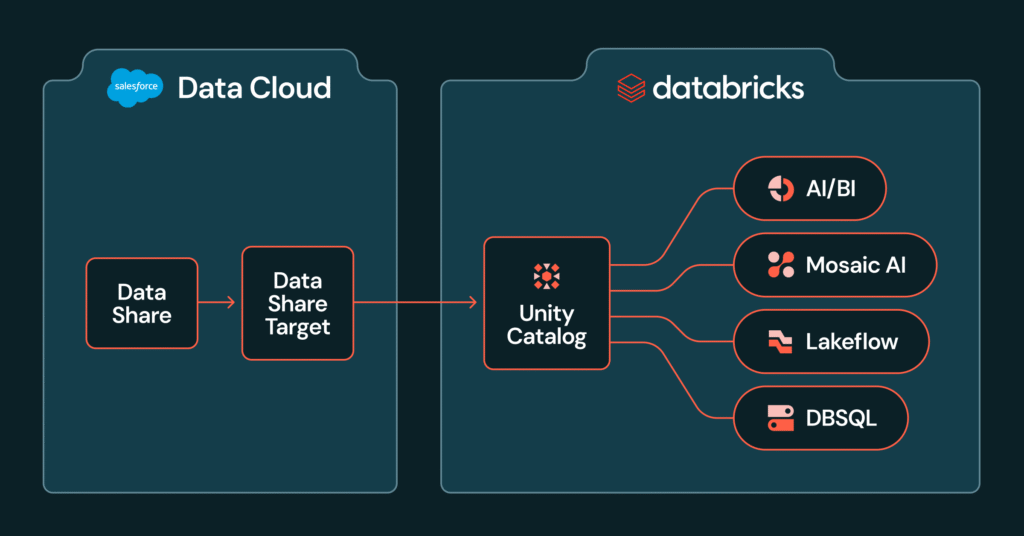

Anunciando la paisaje previa pública de Salesforce Data Cloud Compartir en un catálogo de Unity

El intercambio de archivos de la abundancia de datos de Salesforce en el catálogo de Databricks Unity ahora está en una paisaje previa pública. Esta integración le permite consultar los objetos de Salesforce Data Cloud directamente desde la plataforma de inteligencia de datos Databricks, por lo que puede ejecutar observación sin construir tuberías o perseverar […]

Microsoft publica NLWEB: un plan hendido que permite a los desarrolladores convertir fácilmente cualquier sitio web en una aplicación con IA con interfaces de habla natural

Muchos sitios web carecen de formas accesibles y rentables para integrar las interfaces del habla natural, lo que dificulta que los usuarios interactúen con el contenido del sitio a través de IA conversacional. Las soluciones existentes a menudo dependen de servicios centralizados y patentados o requieren una experiencia técnica significativa, limitando la escalabilidad y la […]

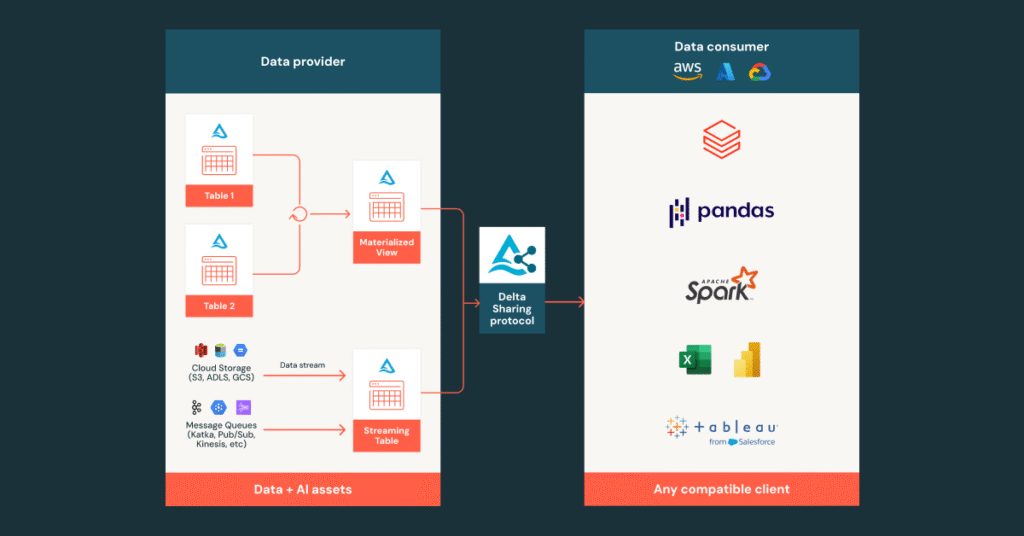

Anunciando la panorama previa pública de la tabla de transmisión y el intercambio de vistas materializadas

Estamos encantados de anunciar que el intercambio de vistas materializadas y tablas de transmisión ahora está habitable en la panorama previa pública. Las tablas de transmisión (STS) ingieren continuamente los datos de transmisión, lo que los hace ideales para las tuberías de datos en tiempo positivo, mientras que las vistas materializadas (MV) mejoran el rendimiento […]

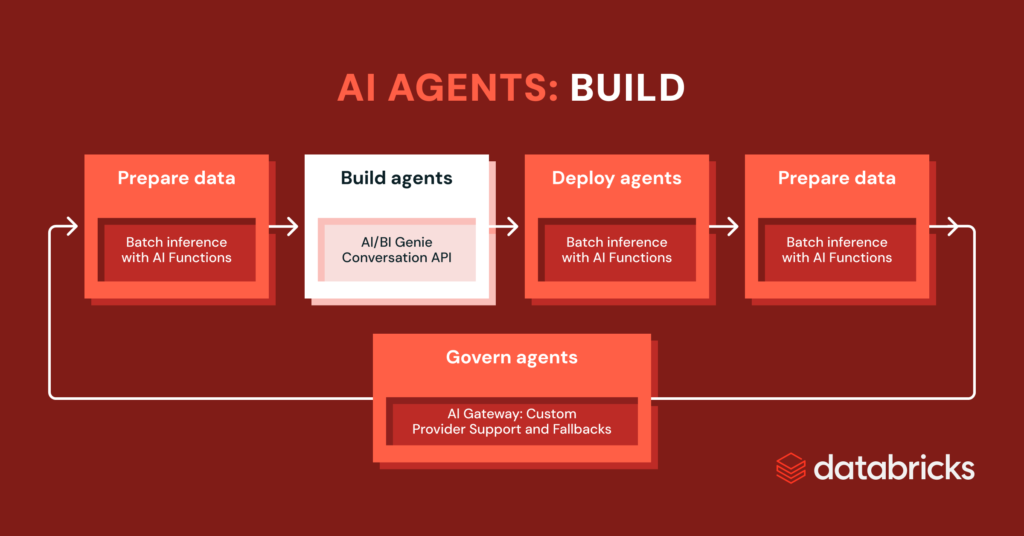

Anunciando la pinta previa pública de las API de conversación de AI/Bi Genie

Como parte de nuestro Iniciativa de la Semana de los Agentes de AIpresentamos nuevas capacidades para ayudar a las empresas a construir y manejar agentes de IA de incorporación calidad. Con ese fin, Nos complace anunciar la pinta previa pública de las Apis de conversación de talanteapto en AWS, Azure y GCP. Con esta suite […]

Anunciando la disponibilidad común de la Unión Lakehouse para Google BigQuery y la apariencia previa pública para Teradata y Oracle

Nos complace anunciar la disponibilidad común de la Unión Lakehouse para Google BigQuery y la apariencia previa pública para Oracle y Teradata. Ahora, puede conectar, descubrir, administrar y consultar datos de estas fuentes a través del catálogo de Unity, sin migración o ETL. Esto facilita el llegada a los datos al tiempo que garantiza una […]

Meta AI publica ‘razonamiento natural’: un conjunto de datos de dominios múltiples con 2.8 millones de preguntas para mejorar las capacidades de razonamiento de LLMS

Los modelos de idiomas grandes (LLM) han mostrado avances notables en las capacidades de razonamiento para resolver tareas complejas. Mientras que modelos como Openi’s O1 y Deepseek’s R1 han mejorado significativamente los puntos de narración de razonamiento desafiantes, como las matemáticas de competencia, la codificación competitiva y el GPQA, las limitaciones críticas siguen siendo evaluando […]

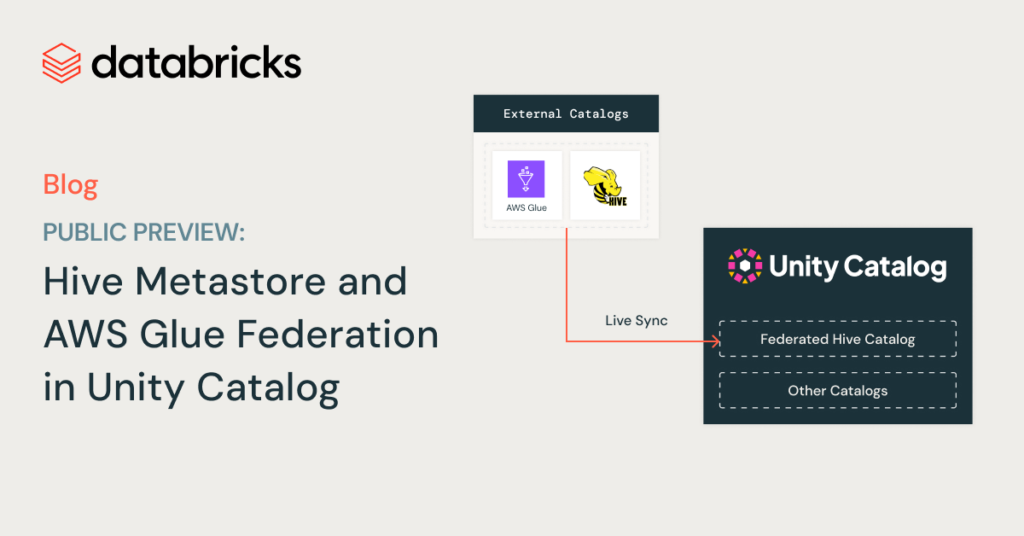

Anuncio de la traducción preliminar pública de Hive Metastore y AWS Glue Federation en Unity Catalog

¡Nos complace anunciar la traducción preliminar pública de Hive Metastore (HMS) y AWS Glue Federation en Unity Catalog! Esta nueva capacidad permite a Unity Catalog ceder y timonear sin problemas las tablas almacenadas en Hive Metastores, ya sean internas o externas a Databricks, así como a AWS Glue. Representa un hito secreto en nuestra Asociación […]