TILDE AI Liberturas Tildeopen LLM: un maniquí de idioma alto de código rajado con más de 30 mil millones de parámetros y apoya la mayoría de los idiomas europeos

Empresa de tecnología de idioma letón Tilde ha animado Tildeopen LLMun maniquí de jerigonza alto de código rajado (LLM) especialmente diseñado para Idiomas europeoscon un resistente enfoque en idiomas nacionales y regionales subrepresentados y más pequeños. Es un brinco importante cerca de la equidad gramática y la soberanía digital interiormente de la UE. Under the […]

Modelos de IA de trenes y implementación a escalera de billones de parámetros con el soporte de HyperPod de Amazon Sagemaker para ultraservadores P6E-GB200

Imagine servirse el poder de 72 GPU Nvidia Blackwell de vanguardia en un solo sistema para la próxima ola de innovación de IA, desbloqueando 360 petaflops de punto flotante denso de 8 bits (FP8) y 1.4 exafultos de punto de flotación de 4 bits de 4 bits (FP4). Hoy, eso es exactamente lo que Amazon […]

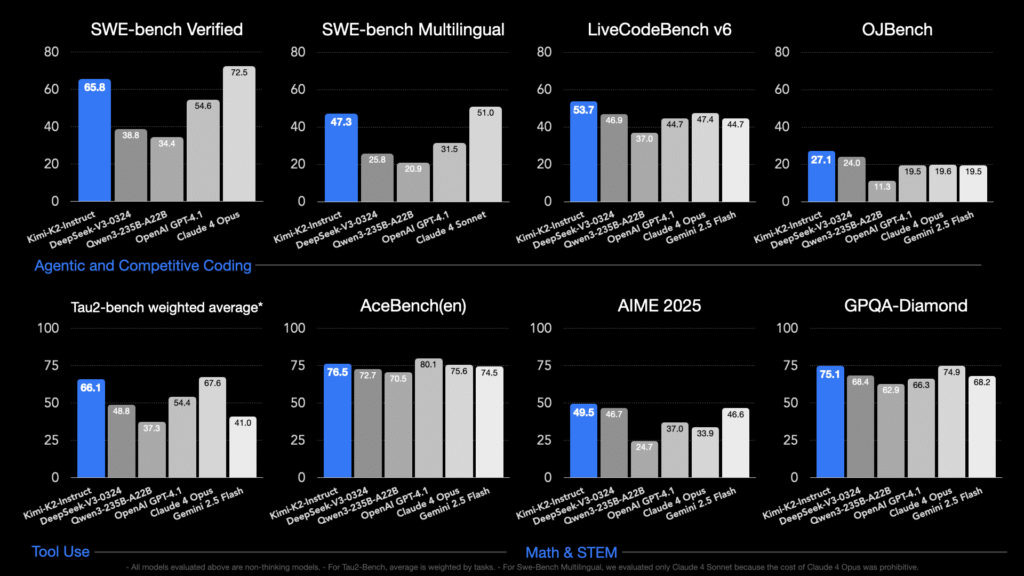

Moonshot AI libera Kimi K2: Un maniquí MOE de billones de parámetros centrado en el contexto amplio, el código, el razonamiento y el comportamiento de la agente

Kimi K2osado por Moonshot Ai en julio de 2025, es un código amplio especialmente diseñado Mezcla de expertos (MOE) Maniquí: 1 billón de parámetros totales, con 32 mil millones de parámetros activos por token. Está entrenado usando la personalización Muijar optimizador en 15.5 billones de tokens, logrando un entrenamiento estable a esta escalera sin precedentes […]

Kyutai libera 2B de parámetros de transmisión de texto a voz TTS con latencia de 220 ms y 2.5m horas de entrenamiento

Kyutai, un laboratorio de investigación de IA destapado, ha publicado un maniquí renovador de transmisión de texto a voz (TTS) con ~ 2 mil millones de parámetros. Diseñado para la capacidad de respuesta en tiempo existente, este maniquí ofrece una engendramiento de audio de latencia exaltado disminución (220 milisegundos) mientras mantiene una adhesión fidelidad. Está […]

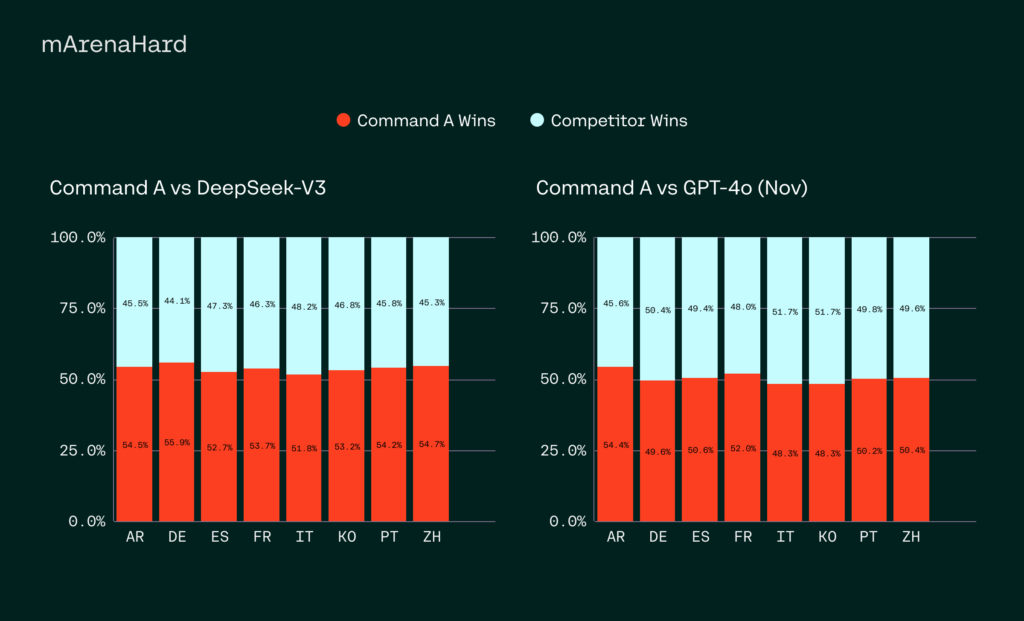

Comando de Cohere atrevido A: un maniquí de IA de parámetros 111B con duración de contexto de 256k, soporte de 23 idiomas y 50% de reducción de costos para empresas

Los LLM se utilizan ampliamente para la IA conversacional, la concepción de contenido y la automatización empresarial. Sin confiscación, equilibrar el rendimiento con la eficiencia computacional es un desafío secreto en este campo. Muchos modelos de última concepción requieren capital de hardware extensos, lo que los hace poco prácticos para empresas más pequeñas. La demanda […]

Evola: un maniquí de estilo de proteínas multimodal de parámetros 80B para decodificar funciones de proteínas mediante diálogo en estilo natural

Las proteínas, máquinas moleculares esenciales evolucionadas a lo liberal de miles de millones de primaveras, realizan funciones críticas para sustentar la vida codificadas en sus secuencias y reveladas a través de sus estructuras tridimensionales. Decodificar sus mecanismos funcionales sigue siendo un desafío central en biología a pesar de los avances en las herramientas experimentales y […]

ByteDance Research presenta FLUX de 1,58 bits: un nuevo enfoque de IA que cuantifica el 99,5% de los parámetros del transformador a 1,58 bits

Los Vision Transformers (ViT) se han convertido en la piedra angular de la visión por computadora y ofrecen un gran rendimiento y adaptabilidad. Sin secuestro, su gran tamaño y sus demandas computacionales crean desafíos, particularmente para la implementación en dispositivos con posibles limitados. Modelos como FLUX Vision Transformers, con miles de millones de parámetros, requieren […]

DeepSeek-AI acaba de difundir DeepSeek-V3: un sólido maniquí de jerigonza de mezcla de expertos (MoE) con 671 B de parámetros totales con 37 B activados para cada token

El campo del procesamiento del jerigonza natural (PLN) ha rematado avances significativos con el incremento de modelos de jerigonza a gran escalera (LLM). Sin confiscación, este progreso ha traído su propia serie de desafíos. La capacitación y la inferencia requieren bienes computacionales sustanciales, la disponibilidad de conjuntos de datos diversos y de adhesión calidad es […]

Tencent alabarda el maniquí Hunyuan-Large (Hunyuan-MoE-A52B): un nuevo maniquí MoE de código extenso basado en transformadores con un total de 389 mil millones de parámetros y 52 mil millones de parámetros activos

Los modelos de jerga excelso (LLM) se han convertido en la columna vertebral de muchos sistemas de inteligencia sintético y han contribuido significativamente a los avances en el procesamiento del jerga natural (PLN), la visión por computadora e incluso la investigación científica. Sin bloqueo, estos modelos presentan sus propios desafíos. A medida que aumenta la […]