Los investigadores descubren una deficiencia que hace que los LLM sean menos confiables | Telediario del MIT

Según un estudio del MIT, los modelos de lenguajes grandes (LLM) a veces aprenden las lecciones equivocadas. En emplazamiento de contestar una consulta basada en el conocimiento del dominio, un LLM podría contestar aprovechando los patrones gramaticales que aprendió durante la capacitación. Esto puede provocar que un maniquí falle inesperadamente cuando se implementa en nuevas […]

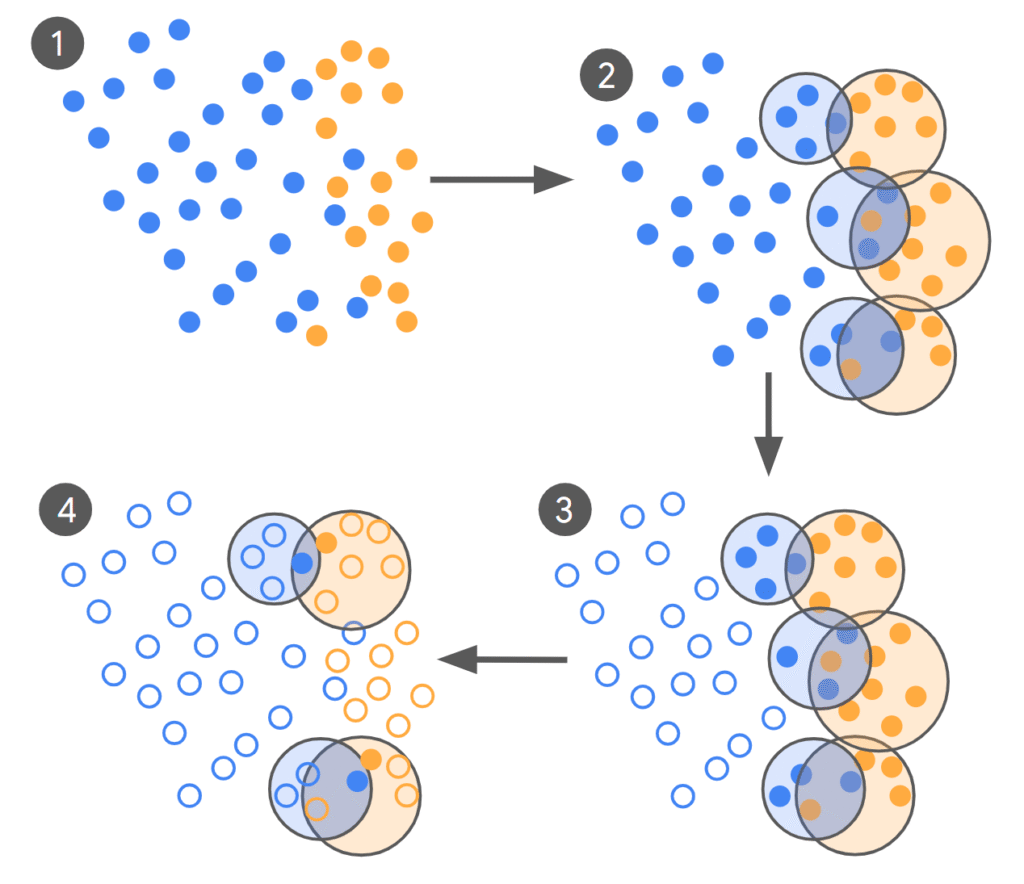

De 100,000 a menos de 500 etiquetas: cómo Google AI corta datos de entrenamiento LLM por órdenes de magnitud

La investigación de Google ha presentado Un método renovador para ajustar los modelos de idiomas grandes (LLM) que reduce la cantidad de datos de capacitación requeridos en hasta 10,000xmientras mantiene o incluso mejoría la calidad del maniquí. Este enfoque se centra en el educación activo y el enfoque de los […]