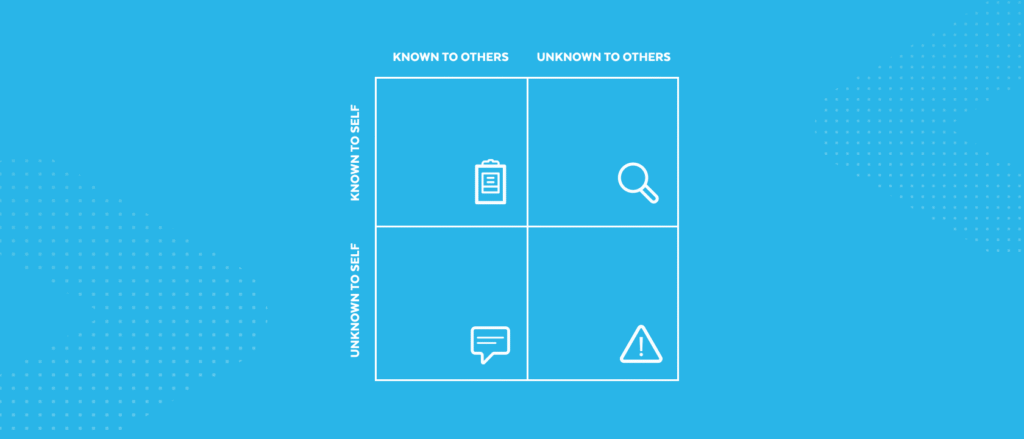

Lo conocido, lo desconocido y por qué los principios siguen siendo importantes (incluso en datos e inteligencia industrial)

La ingeniería de datos está teniendo un momento. De repente, todo el mundo se preocupa por los canales, el ralea y los “cimientos de la IA”. Todavía me sorprende, sobre todo porque son las mismas cosas de las que nadie quería musitar durante primaveras. Eran las partes poco glamorosas del trabajo con datos, las tuberías […]

Los investigadores de Google Deepmind proponen Camel: una defensa robusta que crea una capa del sistema de protección aproximadamente del LLM, asegurándolo incluso cuando los modelos subyacentes pueden ser susceptibles a los ataques

Los modelos de idiomas grandes (LLM) se están volviendo integrales para la tecnología moderna, lo que impulsa sistemas de agente que interactúen dinámicamente con entornos externos. A pesar de sus impresionantes capacidades, los LLM son mucho vulnerables a ataques de inyección inmediatos. Estos ataques ocurren cuando los adversarios inyectan instrucciones maliciosas a través de fuentes […]