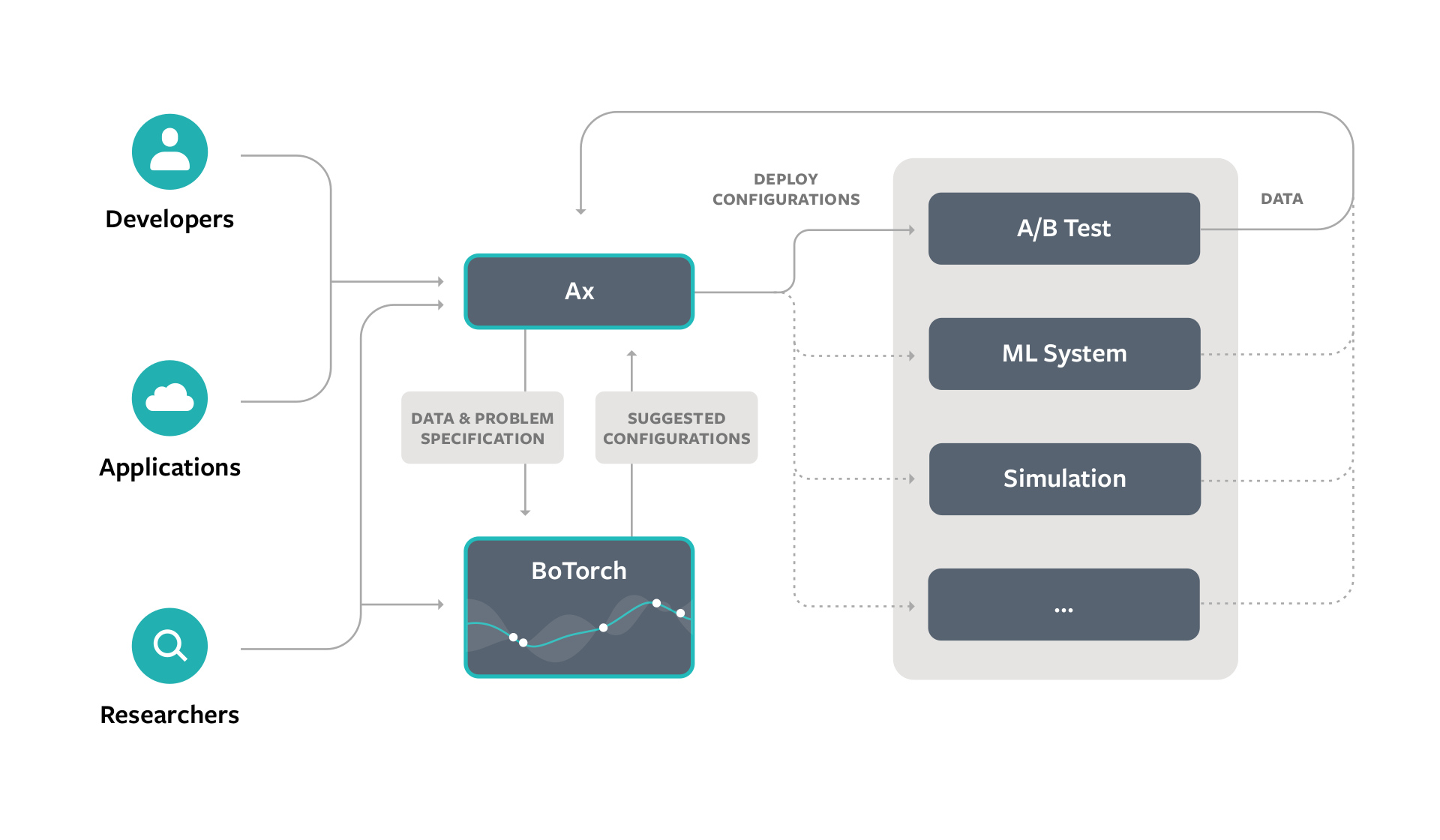

- hemos descocado Figura 1.0una plataforma de código destapado que utiliza el educación mecánico para aconsejar automáticamente experimentaciones complejas que requieren muchos capital.

- Axe se utiliza a escalera en Meta para mejorar los modelos de IA, ajustar la infraestructura de producción y acelerar los avances en ML e incluso en el diseño de hardware.

- Nuestro documento adjunto, “Ax: una plataforma para la experimentación adaptativa» explica la obra, la metodología y cómo se compara con otras bibliotecas de optimización de caja negra de última reproducción.

¿Cómo pueden los investigadores comprender y optimizar eficazmente los modelos o sistemas de IA que tienen una gran cantidad de configuraciones posibles? Este es un desafío que prevalece particularmente en dominios caracterizados por sistemas complejos e interactivos, como el mejora y la implementación de la IA moderna. La optimización en estas configuraciones exige experimentación y la eficiencia es de suma importancia cuando la evaluación de una única configuración requiere muchos capital y/o tiempo.

La experimentación adaptativa ofrece una posibilidad a este problema al proponer activamente nuevas configuraciones para la evaluación secuencial, aprovechando los conocimientos adquiridos en evaluaciones anteriores.

Este año, lanzamos la lectura 1.0 de Ax, una plataforma de experimentación adaptativa de código destapado que aprovecha el educación mecánico para aconsejar y automatizar el proceso de experimentación. Ax emplea la optimización bayesiana para permitir a los investigadores y desarrolladores realizar experimentos eficientes, identificando configuraciones óptimas para optimizar sus sistemas y procesos.

Pegado con este importante emanación, publicamos un artículo titulado «Ax: una plataforma para la experimentación adaptativa” que explora la obra central de Ax, proporciona una explicación más profunda de la metodología que impulsa la optimización y compara el rendimiento de Ax con otras bibliotecas de optimización de caja negra.

Axe se ha diligente con éxito en varias disciplinas en Meta, que incluyen:

- Tareas tradicionales de educación mecánico, como la optimización de hiperparámetros y la búsqueda de obra.

- Topar desafíos esencia en GenAI, incluido el descubrimiento de combinaciones de datos óptimas para entrenar modelos de IA.

- Ajuste de infraestructura o indicadores del compilador en entornos de producción.

- Optimización de parámetros de diseño en tareas de ingeniería física, como el diseño de dispositivos AR/VR.

Al utilizar Ax, los desarrolladores pueden gastar una metodología de última reproducción para realizar experimentos complejos y, en última instancia, obtener una comprensión más profunda y optimizar sus sistemas subyacentes.

Cómo originarse con Axe

Para comenzar a usar Ax para ajustar eficientemente los parámetros en sistemas complejos, instale la última lectura de la biblioteca a través de `pip install ax-platform` y visite el sitio web de Axe para obtener una finalidad de inicio rápido, tutoriales y estudio profundos de los métodos que Ax utiliza bajo el capó.

Axe es para la experimentación en el mundo efectivo

Los experimentos adaptativos son increíblemente efectos, pero su ejecución puede resultar difícil. Estos experimentos no solo requieren el uso de métodos sofisticados de educación mecánico para impulsar la optimización, sino que igualmente exigen una infraestructura especializada para tramitar el estado del experimentación, automatizar la orquestación, proporcionar estudio y diagnósticos efectos, y más. Encima, los objetivos de cualquier experimentación suelen ser más complejos que simplemente mejorar una única métrica. En la ejercicio, la experimentación suele ser un inmovilidad cuidadoso entre múltiples métricas objetivas sujetas a múltiples restricciones y barreras de seguridad.

Creamos Ax para permitir a los usuarios configurar y ejecutar fácilmente estos experimentos dinámicos utilizando técnicas de última reproducción, y para proporcionar una plataforma sólida y madura para que los investigadores integren métodos de vanguardia directamente en los sistemas de producción.

Figura para la comprensión

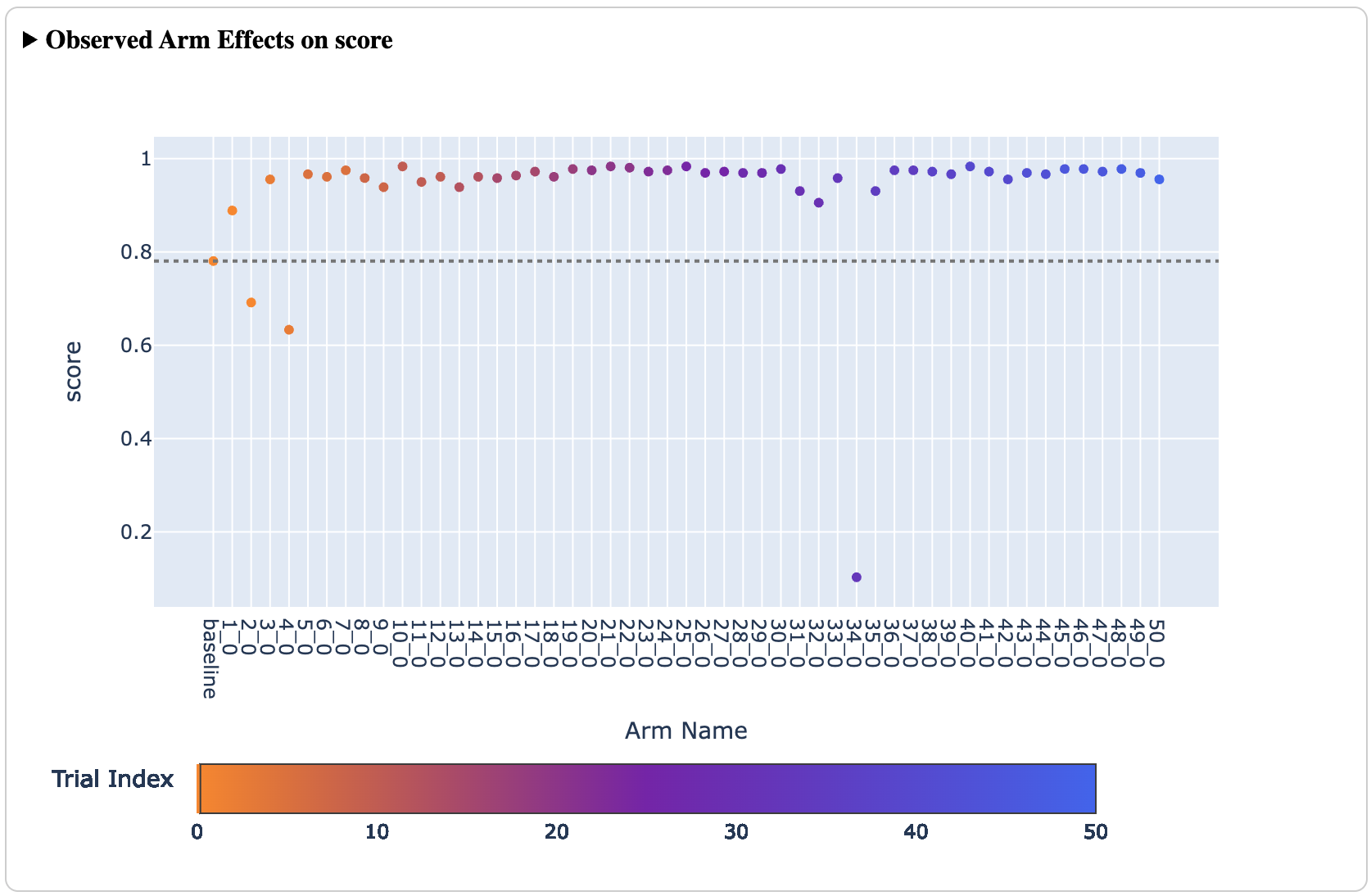

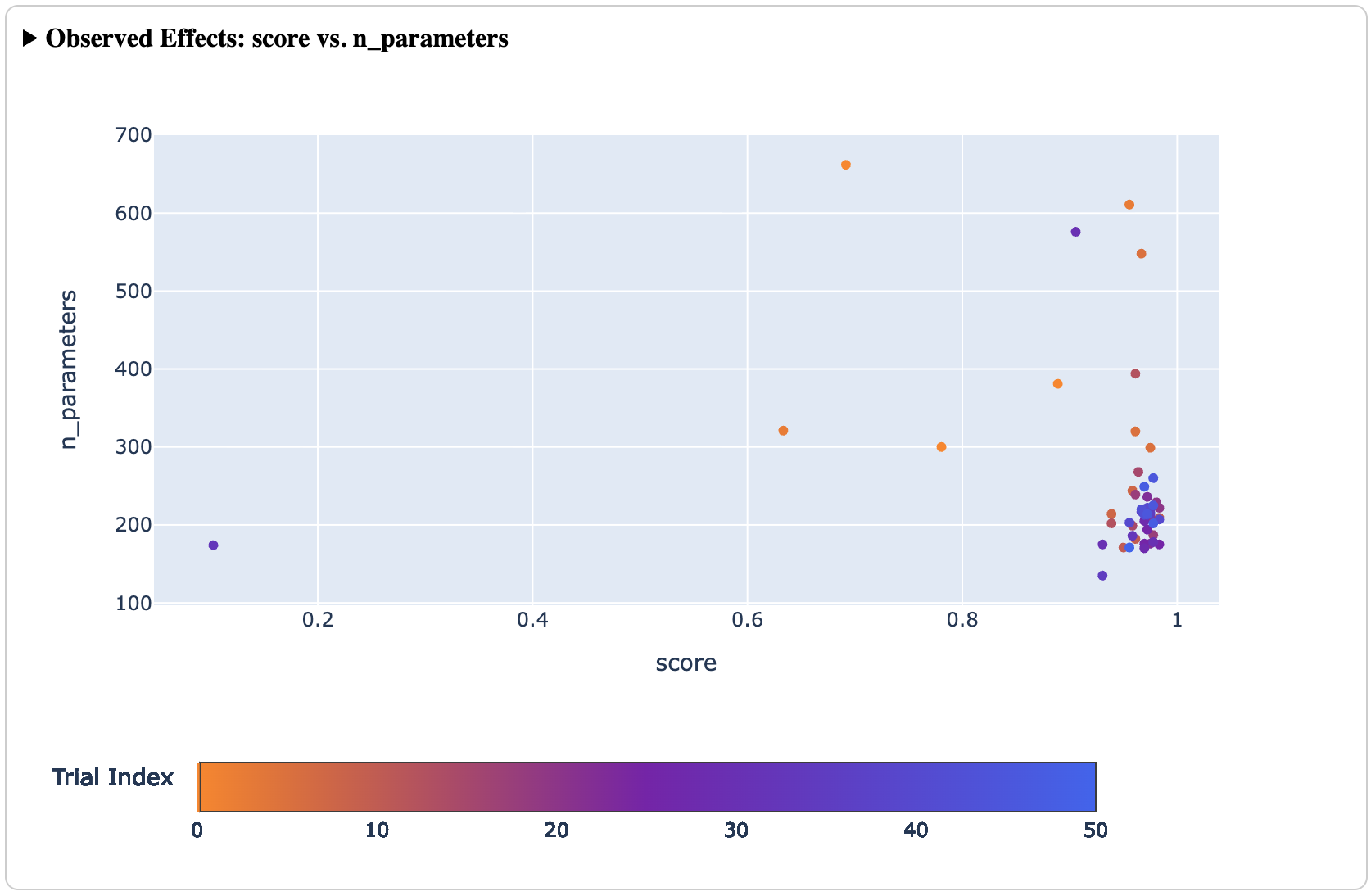

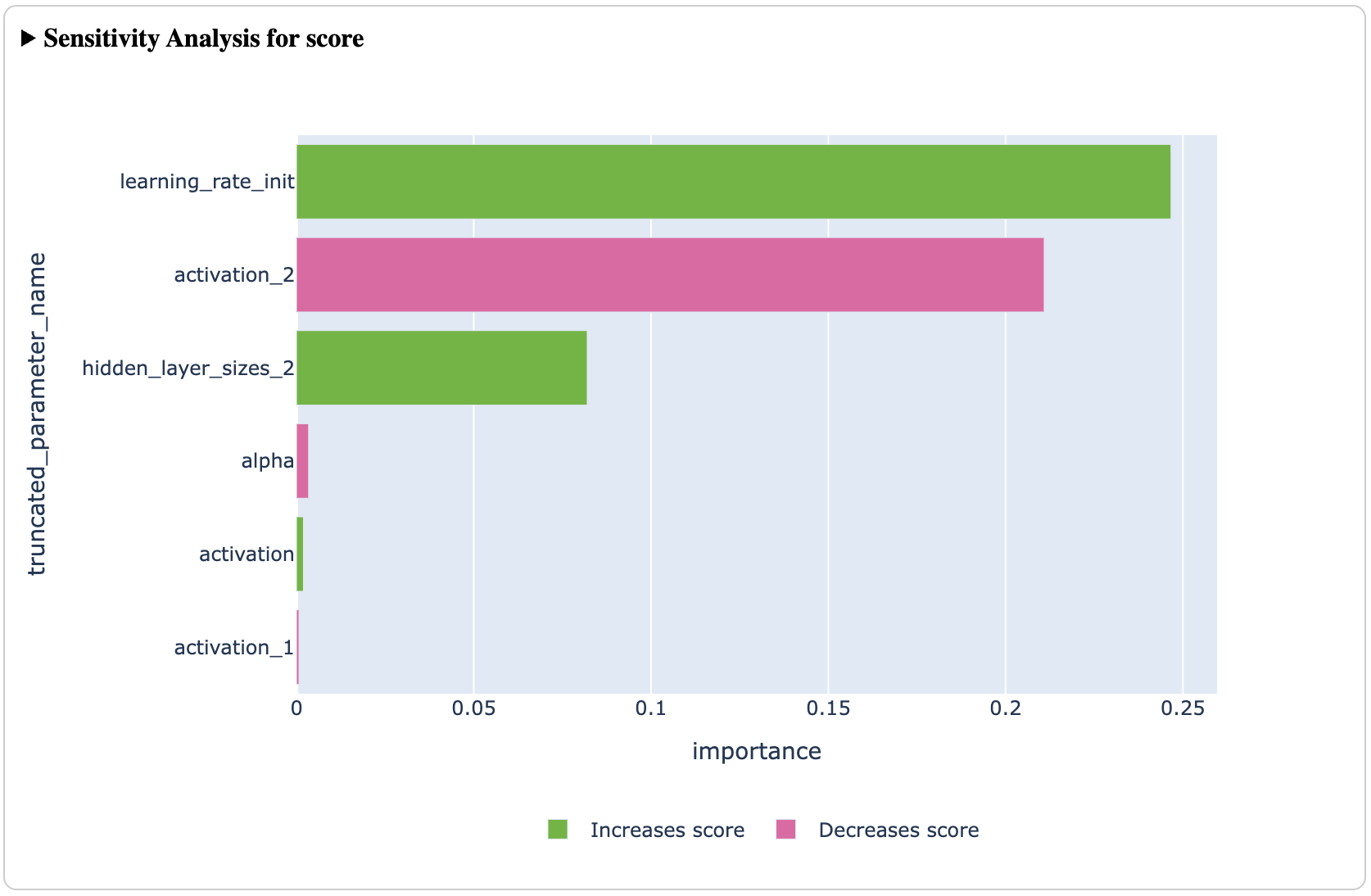

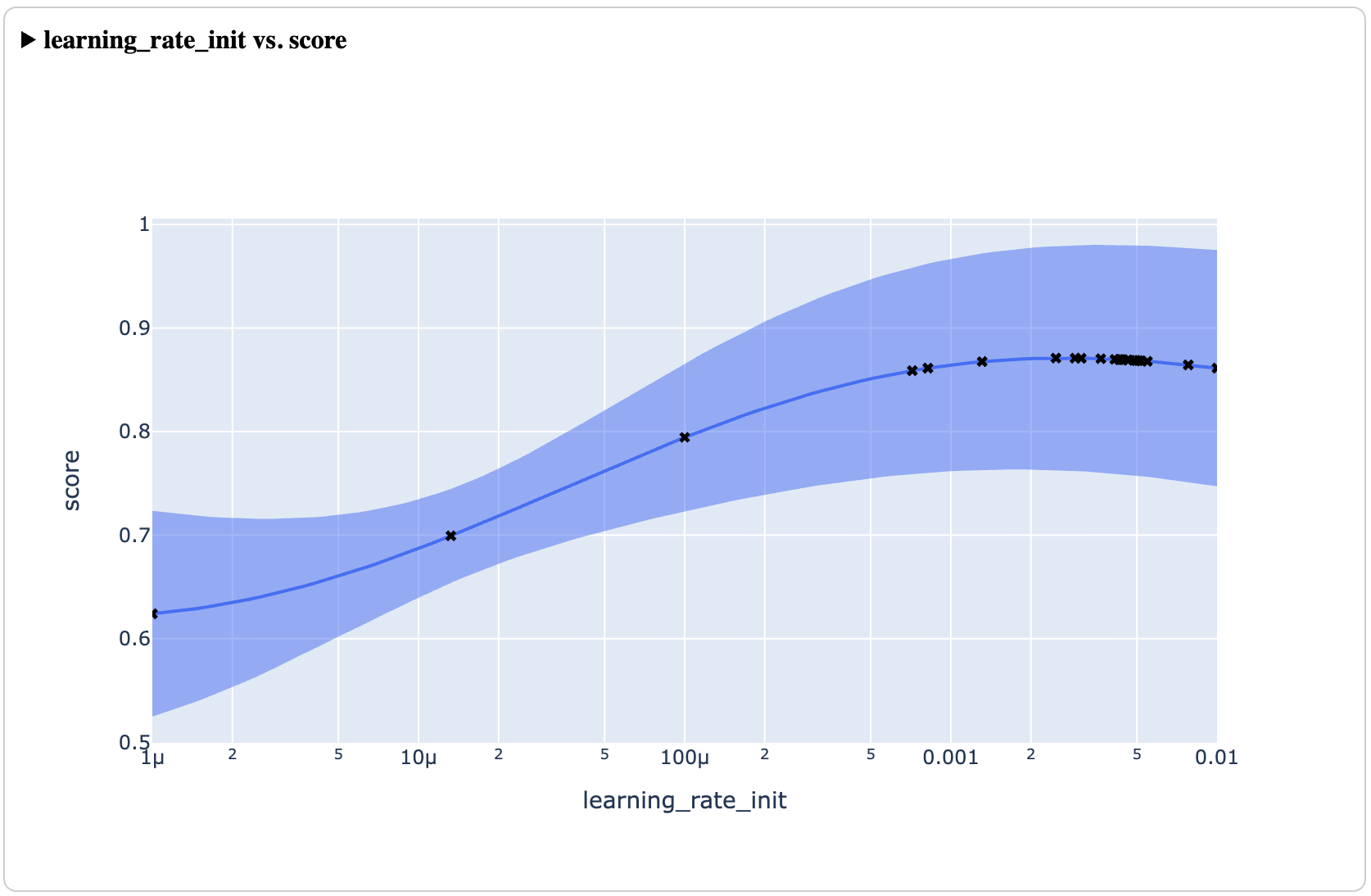

Encima de encontrar configuraciones óptimas de modo capaz, Ax es una aparejo poderosa para comprender el sistema subyacente que se está optimizando. Ax proporciona un conjunto de estudio (gráficos, tablas, etc.) que ayudan a sus usuarios a comprender cómo progresa la optimización a lo dadivoso del tiempo, las compensaciones entre diferentes métricas a través de un frontera de paretovisualice el sensación de uno o dos parámetros en el espacio de entrada y explique cuánto contribuye cada parámetro de entrada a los resultados (mediante estudio de sensibilidad).

Estas herramientas permiten a los experimentadores obtener una configuración óptima para implementar en producción y una comprensión más profunda de su sistema, que puede informar las decisiones en el futuro.

Cómo funciona el hachuela

De forma predeterminada, Ax utiliza la optimización bayesiana, un método de experimentación adaptativo eficaz que destaca en el inmovilidad. exploración – memorizar cómo funcionan las nuevas configuraciones, y explotación – refinar las configuraciones que previamente se había observado que eran buenas. El hachuela se sostén en BoTorch para su implementación de componentes de optimización bayesiana.

La optimización bayesiana es un enfoque iterativo para resolver el problema de optimización completo. que no asume ninguna información sobre la forma de la función f. En la ejercicio, esto significa optimizar los sistemas evaluando algunas configuraciones candidatas.

(es asegurar, probar algunas configuraciones y cronometrar su sensación), construir un maniquí sustituto utilizando estos datos, usar ese sustituto para identificar la configuración más prometedora para evaluar a continuación y repetir hasta que se haya antagónico una posibilidad óptima o se haya sofocado el presupuesto práctico.

En configuraciones típicas, Ax utiliza un proceso gaussiano (GP) como maniquí sustituto durante el ciclo de optimización bayesiano, un maniquí flexible que puede hacer predicciones mientras cuantifica la incertidumbre y es especialmente efectivo con muy pocos puntos de datos. Luego, Ax utiliza una función de adquisición de una grupo señal progreso esperada (EI) para sugerir las siguientes configuraciones candidatas a evaluar capturando el valencia esperado de cualquier configuración nueva en comparación con la mejor configuración evaluada previamente.

La próximo animación muestra este tirabuzón con un médico de colchoncillo que modela la métrica del objetivo trazada en lo alto en celeste y la IE trazada debajo en desfavorable; el valencia más suspensión de EI informa el próximo valencia de x a evaluar. Una vez que se ha evaluado el nuevo valencia de x, se vuelve a ajustar el médico de colchoncillo con el nuevo punto de datos y calculamos el próximo valencia de EI.

Este ejemplo unidimensional se puede ampliar para muchas dimensiones de entrada y salida, lo que permite a Ax optimizar problemas con muchos (potencialmente cientos) de parámetros y resultados ajustables. De hecho, en entornos de dimensiones superiores, en los que cubrir el espacio de búsqueda se vuelve exponencialmente más costoso, es donde el enfoque basado en sustitutos efectivamente brilla en comparación con otros enfoques.

Puede repasar más sobre la optimización bayesiana en el sitio web de Axe. Presentación a la optimización bayesiana página.

Cómo usamos Axe en Meta

Ax se ha implementado a escalera en Meta para resolver algunos de los problemas de optimización más desafiantes de la empresa. Miles de desarrolladores de Meta utilizan Ax para tareas como optimización de hiperparámetros y búsqueda de obra para modelos de IA, ajuste de parámetros para modelos de clasificación y recomendación en itinerario, optimizaciones de infraestructura y optimización de simulación para el diseño de hardware de AR y VR.

Estos experimentos optimizan objetivos matizados y aprovechan algoritmos sofisticados. Por ejemplo, hemos utilizado la optimización multiobjetivo para mejorar simultáneamente la precisión de un maniquí de educación mecánico y al mismo tiempo minimizar su uso de capital. Cuando a los investigadores se les encomendó la tarea de estrechar los modelos de estilo natural para adaptarlos a la primera reproducción de Ray-Ban Stories ellos usaron hachuela para inquirir modelos que equilibren de modo óptima el tamaño y el rendimiento. Encima, los metaingenieros utilizan técnicas de optimización restringidas para sistemas de recomendación de sintonización para optimizar métricas esencia evitando regresiones en otras.

Recientemente, Ax se utilizó para diseñar Nuevas mezclas de concreto bajas en carbono y de curado más rápido que se implementaron en uno de nuestros sitios de construcción de centros de datos. Estas nuevas mezclas están desempeñando un papel importante en el avance de nuestra objetivo de cero emisiones netas en 2030.

Vemos problemas en todos los dominios donde la calidad final de un sistema se ve afectada por parámetros cuyas interacciones son complejas de razonar sin experimentación y donde la experimentación tiene un costo significativo: Ax aborda estos desafíos empleando un enfoque basado en datos para adaptar los experimentos a medida que se desarrollan, lo que nos permite resolver estos problemas de modo capaz y efectiva.

El futuro del hachuela

Siempre estamos trabajando para mejorar Ax mediante la creación de nuevas funciones para representar diseños de experimentos innovadores, nuevos métodos de optimización interesantes o integraciones para usar Ax con plataformas externas. Ax se enorgullece de ser de código destapado (abuso del MIT), e invitamos tanto a los profesionales como a las comunidades de investigación a contribuir al tesina, ya sea a través de modelos sustitutos mejorados o funciones de adquisición, extensiones utilizadas para aplicaciones de investigación individuales que pueden beneficiar a la comunidad en normal, o simplemente correcciones de errores o mejoras en las capacidades principales. Comuníquese con el equipo a través de Problemas de Github.

Repasar el documento

Ax: una plataforma para la experimentación adaptativa

Para obtener más información sobre Meta Open Source, visite nuestro sitio websuscríbete a nuestro canal de youtubeo síguenos en Facebook, Trapos, intríngulis, Gloria celeste y LinkedIn.

Expresiones de agradecimiento

Axe fue creado por el equipo de Experimentación Adaptativa de Meta: Sebastian Ament, Eytan Bakshy, Max Balandat, Bernie Beckerman, Sait Cakmak, Cesar Cardoso, Ethan Che, Sam Daulton, David Eriksson, Mia Garrard, Matthew Grange, Carl Hvarfner, Paschal Igusti, Lena Kashtelyan, Cristian Lara, Ben Letham, Andy Lin, Jerry Lin, Jihao Andreas Lin, Samuel Müller, Miles Olson, Eric Onofrey, Shruti Patel, Elizabeth Santorella, Sunny Shen, Louis Tiao y Kaiwen Wu.