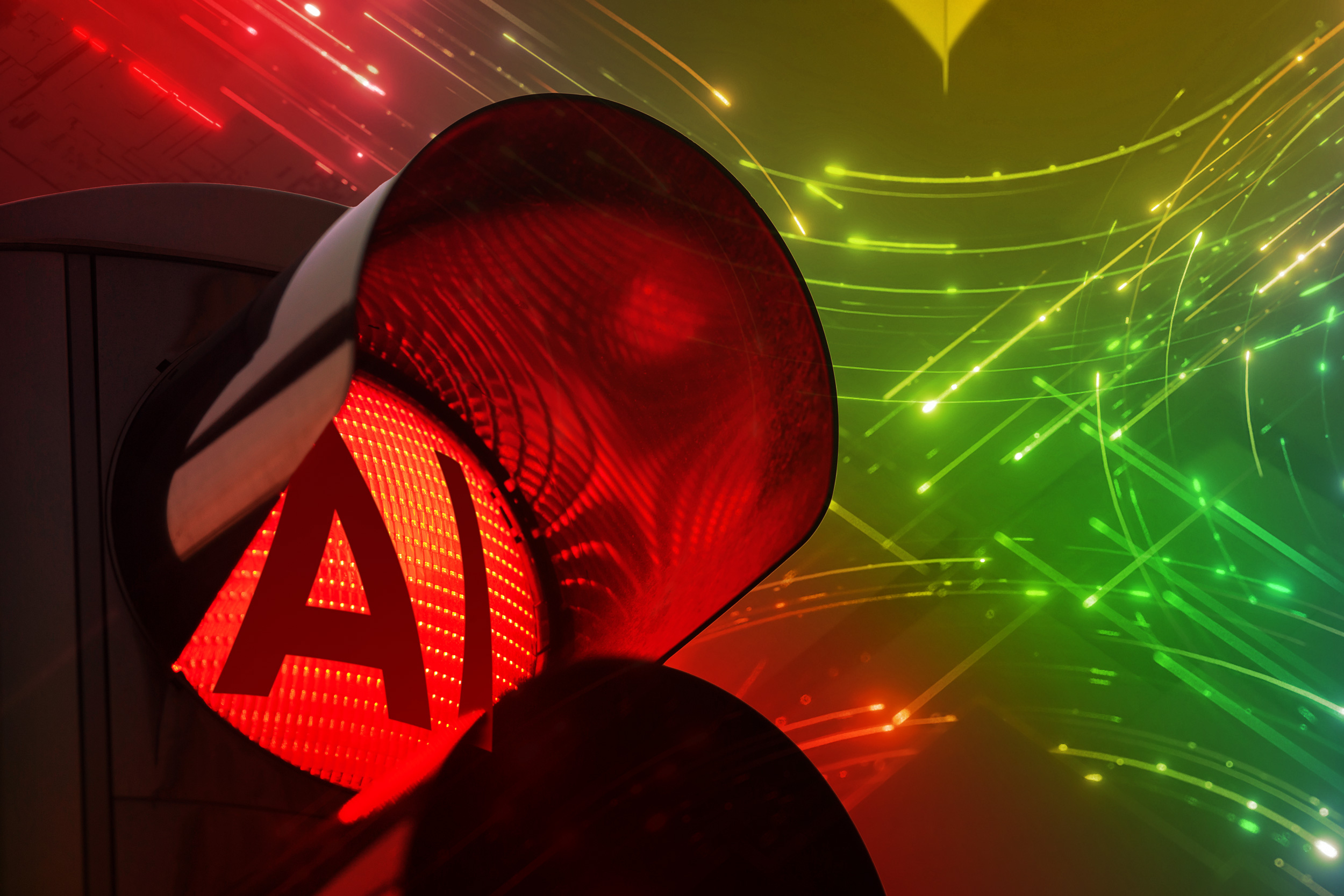

Campos que van desde la robótica hasta la medicina y las ciencias políticas están intentando entrenar sistemas de inteligencia fabricado para tomar decisiones significativas de todo tipo. Por ejemplo, utilizar un sistema de inteligencia fabricado para controlar de forma inteligente el tráfico en una ciudad congestionada podría ayudar a los conductores a aparecer más rápido a sus destinos, al tiempo que restablecimiento la seguridad o la sostenibilidad.

Desafortunadamente, enseñar a un sistema de IA a tomar buenas decisiones no es una tarea ligera.

Los modelos de estudios por refuerzo, que subyacen a estos sistemas de toma de decisiones de IA, todavía fallan a menudo cuando se enfrentan incluso a pequeñas variaciones en las tareas para las que están entrenados. En el caso del tráfico, un maniquí podría tener dificultades para controlar un conjunto de intersecciones con diferentes límites de velocidad, números de carriles o patrones de tráfico.

Para aumentar la confiabilidad de los modelos de estudios por refuerzo para tareas complejas con variabilidad, los investigadores del MIT han introducido un operación más capaz para entrenarlos.

El operación selecciona estratégicamente las mejores tareas para entrenar a un agente de IA para que pueda realizar eficazmente todas las tareas de un conjunto de tareas relacionadas. En el caso del control de semáforos, cada tarea podría ser una intersección en un espacio de tareas que incluya todas las intersecciones de la ciudad.

Al centrarse en un número último de intersecciones que contribuyen más a la efectividad genérico del operación, este método maximiza el rendimiento y mantiene bajo el costo de capacitación.

Los investigadores descubrieron que su técnica era entre cinco y 50 veces más capaz que los enfoques unificado en una variedad de tareas simuladas. Esta fruto en eficiencia ayuda al operación a instruirse una mejor posibilidad de modo más rápida y, en última instancia, restablecimiento el rendimiento del agente de IA.

“Pudimos ver mejoras de rendimiento increíbles, con un operación muy simple, pensando de modo innovadora. Un operación que no es muy complicado tiene más posibilidades de ser recogido por la comunidad porque es más ligera de implementar y más ligera de entender para otros”, dice la autora principal Cathy Wu, profesora asociada de exposición profesional de Thomas D. y Virginia W. Cabot. en Ingeniería Civil y Ambiental (CEE) y del Instituto de Datos, Sistemas y Sociedad (IDSS), y miembro del Laboratorio de Sistemas de Información y Valentía (LIDS).

Ella está unida en el papel por el autor principal Jung-Hoon Cho, estudiante de posgrado de ECO; Vindula Jayawardana, estudiante de posgrado del Sección de Ingeniería Eléctrica e Informática (EECS); y Sirui Li, estudiante de posgrado del IDSS. La investigación se presentará en la Conferencia sobre Sistemas de Procesamiento de Información Neural.

Encontrar un término medio

Para entrenar un operación para controlar los semáforos en muchas intersecciones de una ciudad, un ingeniero normalmente elegiría entre dos enfoques principales. Puede entrenar un operación para cada intersección de forma independiente, usando solo los datos de esa intersección, o entrenar un operación más prócer usando datos de todas las intersecciones y luego aplicarlo a cada una.

Pero cada enfoque tiene sus desventajas. Entrenar un operación separado para cada tarea (como una intersección determinada) es un proceso que requiere mucho tiempo y una enorme cantidad de datos y cálculos, mientras que entrenar un operación para todas las tareas a menudo conduce a un rendimiento deficiente.

Wu y sus colaboradores buscaron un punto inmejorable entre estos dos enfoques.

Para su método, eligen un subconjunto de tareas y entrenan un operación para cada tarea de forma independiente. Es importante destacar que seleccionan estratégicamente las tareas individuales que tienen más probabilidades de mejorar el rendimiento genérico del operación en todas las tareas.

Aprovechan un truco global del campo del estudios por refuerzo llamado estudios por transferencia de disparo cero, en el que un maniquí ya entrenado se aplica a una nueva tarea sin aceptar más entrenamiento. Con el estudios por transferencia, el maniquí a menudo funciona notablemente perfectamente en la tarea del nuevo vecino.

«Sabemos que sería ideal entrenar en todas las tareas, pero nos preguntamos si podríamos entrenar en un subconjunto de esas tareas, aplicar el resultado a todas las tareas y aun así ver un aumento en el rendimiento», dice Wu.

Para identificar qué tareas deberían decidir para maximizar el rendimiento esperado, los investigadores desarrollaron un operación llamado Estudios por transferencia basado en modelos (MBTL).

El operación MBTL tiene dos partes. Por un flanco, modela el rendimiento de cada operación si se entrenara de forma independiente en una tarea. Luego modela cuánto se degradaría el rendimiento de cada operación si se transfiriera a otras tareas, un concepto conocido como rendimiento de universalización.

Modelar explícitamente el rendimiento de la universalización permite a MBTL estimar el valía del entrenamiento en una nueva tarea.

MBTL hace esto de forma secuencial, eligiendo primero la tarea que conduce a la maduro fruto de rendimiento y luego seleccionando tareas adicionales que proporcionen las mayores mejoras marginales posteriores al rendimiento genérico.

Hexaedro que MBTL sólo se centra en las tareas más prometedoras, puede mejorar drásticamente la eficiencia del proceso de formación.

Someter los costes de formación

Cuando los investigadores probaron esta técnica en tareas simuladas, incluido el control de señales de tráfico, la papeleo de avisos de velocidad en tiempo existente y la ejecución de varias tareas de control clásicas, resultó entre cinco y 50 veces más capaz que otros métodos.

Esto significa que podrían aparecer a la misma posibilidad entrenándose con muchos menos datos. Por ejemplo, con un aumento de eficiencia 50 veces maduro, el operación MBTL podría entrenarse en solo dos tareas y obtener el mismo rendimiento que un método unificado que utiliza datos de 100 tareas.

«Desde la perspectiva de los dos enfoques principales, eso significa que los datos de las otras 98 tareas no eran necesarios o que el entrenamiento en las 100 tareas es confuso para el operación, por lo que el rendimiento termina peor que el nuestro», dice Wu.

Con MBTL, anexar incluso una pequeña cantidad de tiempo de entrenamiento adicional podría conducir a un rendimiento mucho mejor.

En el futuro, los investigadores planean diseñar algoritmos MBTL que puedan echarse a problemas más complejos, como espacios de tareas de suscripción dimensión. Todavía están interesados en aplicar su enfoque a problemas del mundo existente, especialmente en sistemas de movilidad de próxima vivientes.

La investigación está financiada, en parte, por un premio CAREER de la Fundación Doméstico de Ciencias, el software de becas de doctorado de la Fundación Educativa Kwanjeong y una chía de doctorado en Robótica de Amazon.