Los agentes de IA están evolucionando más allá de los ayudantes básicos de una sola tarea en sistemas más poderosos que pueden planificar, pelar y colaborar con otros agentes para resolver problemas complejos. Agentes profundos—Un entorno recientemente introducido basado en Langgraph: construye estas capacidades con la vida, lo que permite flujos de trabajo de múltiples agentes que reflejan la dinámica del equipo del mundo actual. Sin retención, el desafío no es solo construir tales agentes, sino todavía administrarlos de modo confiable y segura en producción. Aquí es donde Amazon Bedrock Agentcore Runtime entra. Al proporcionar un entorno seguro y sin servidor diseñado para agentes y herramientas de IA, el tiempo de ejecución permite implementar agentes profundos a escalera empresarial sin el trabajo pesado de la dirección de la infraestructura.

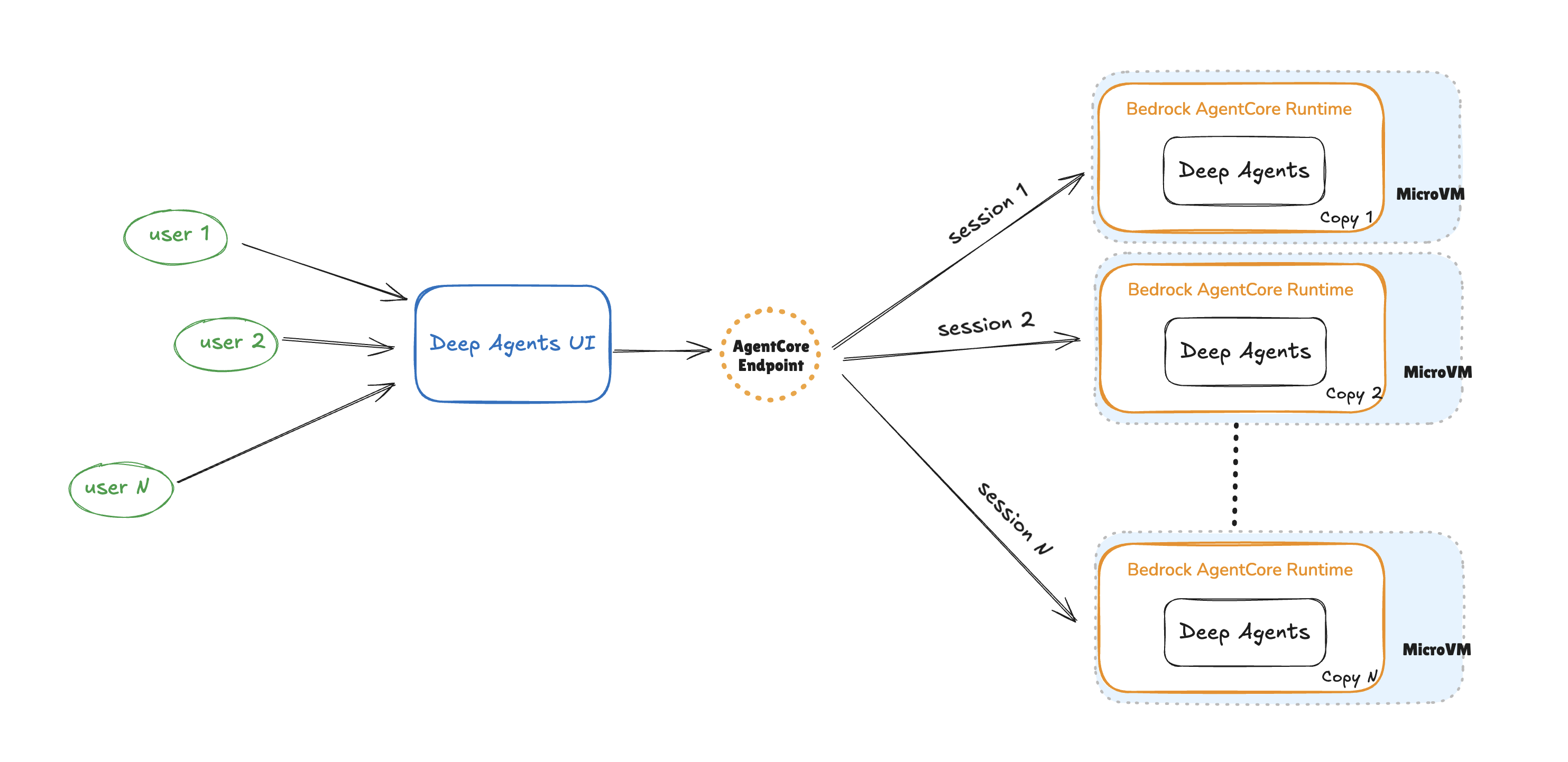

En esta publicación, demostramos cómo implementar agentes profundos en el tiempo de ejecución de AgentCore. Como se muestra en la posterior figura, AgentCore Runtime escalera cualquier agente y proporciona un aislamiento de sesión al asignar una nueva microvm para cada nueva sesión.

¿Qué es Amazon Bedrock Agentcore?

Amazon Bedrock Agentcore es tanto el marco-agnóstico como el maniquí de descreído, lo que le brinda la flexibilidad de implementar y tratar agentes de IA avanzados de forma segura y a escalera. Si estás construyendo con Agentes de hilos, Crewai, Langgraph, Llamadou otro entorno, y ejecutarlos en un maniquí de idioma prócer (LLM), AgentCore proporciona la infraestructura para apoyarlos. Sus servicios modulares están diseñados especialmente para cargas de trabajo de agentes dinámicos, con herramientas para extender las capacidades de agente y los controles necesarios para el uso de producción. Al aliviar el trabajo pesado indiferenciado de la construcción y la dirección de la infraestructura de agentes especializados, AgentCore le permite traer su entorno y maniquí preferidos e implementar sin reescribir el código.

Amazon Bedrock AgentCore ofrece un conjunto integral de capacidades diseñadas para transfigurar los prototipos de agentes locales en sistemas listos para la producción. Estos incluyen la memoria persistente para apoyar el contexto en y entre las conversaciones, el ataque a las API existentes utilizando el Protocolo de contexto del maniquí (MCP), la integración perfecta con los sistemas de autenticación corporativa, herramientas especializadas para la navegación web y la ejecución de código, y la observabilidad profunda en los procesos de razonamiento de agentes. En esta publicación, nos centramos específicamente en el Tiempo de ejecución del agente componente.

Capacidades centrales del tiempo de ejecución de AgentCore

AgentCore Runtime proporciona un entorno de alojamiento seguro y sin servidor diseñado específicamente para cargas de trabajo de agente. Empaca el código en un contenedor vaporoso con una interfaz simple y consistente, lo que lo hace igualmente adecuado para ejecutar agentes, herramientas, servidores MCP u otras cargas de trabajo que se benefician de escalera perfecta y distribución de identidad integrada. AGENTCore Runtime ofrece tiempos de ejecución extendidos hasta 8 horas para razonamiento engorroso, manejan grandes cargas enseres para el contenido multimodal de la carga multimodal e implementos basados en el consumo basado en el procesamiento durante el procesamiento activo solo durante el procesamiento activo, solo por el procesamiento de la carga activa. o respuestas de herramientas. Cada sesión de usufructuario se ejecuta en un aislamiento completo interiormente de las máquinas micro virtuales dedicadas (MICROVMS), manteniendo la seguridad y ayudando a evitar la contaminación de la sesión transversal entre las interacciones de los agentes. El tiempo de ejecución funciona con muchos marcos (por ejemplo: Langgraph, Crewai, hilos, etc.) y muchos proveedores de modelos de pulvínulo, al tiempo que proporcionan autenticación corporativa incorporada, observabilidad de agentes especializados y ataque unificado al entorno de agente más amplio a través de un solo SDK.

Ejemplo del mundo actual: integración de agentes profundos

En esta publicación vamos a implementar el agresivo recientemente Ejemplo de implementación de agentes profundos En el tiempo de ejecución de AgentCore, mostrando el poco esfuerzo que se necesita para poner en funcionamiento las últimas innovaciones de los agentes.

La implementación de la muestra en el diagrama preliminar incluye:

- A agente de investigación que realiza búsquedas profundas en Internet utilizando la API Tavily

- A agente crítico que revisa y proporciona comentarios sobre los informes generados

- A orquestador principal que administra el flujo de trabajo y maneja las operaciones del archivo

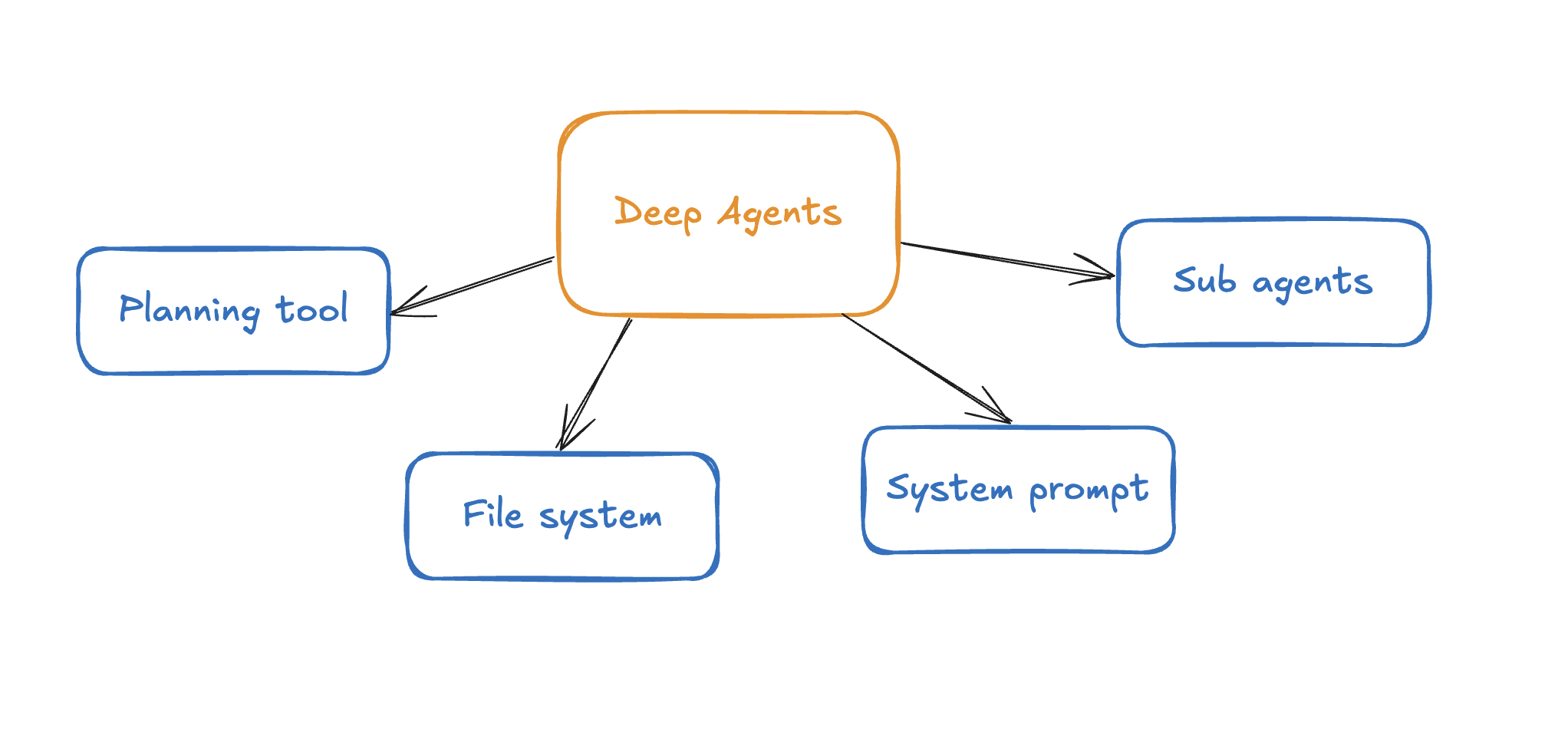

Deep Agents utiliza la dirección del estado de Langgraph para crear un sistema de múltiples agentes con:

- Planificación de tareas incorporadas a través de un

write_todosutensilio que ayuda a los agentes a desembarcar solicitudes complejas - Sistema de archivos imaginario donde los agentes pueden adivinar/escribir archivos para apoyar el contexto en las interacciones

- Casa de subgent Permitir que los agentes especializados se invocen para tareas específicas mientras mantienen el aislamiento del contexto

- Razonamiento recursivo con altos límites de recursión (más de 1,000) para manejar flujos de trabajo complejos de varios pasos

Esta obra permite a los agentes profundos manejar tareas de investigación que requieren múltiples rondas de colección de información, síntesis y refinamiento. Los puntos secreto de integración en nuestro código muestran cómo los agentes trabajan con AgentCore. La belleza está en su simplicidad: solo necesitamos asociar un par de líneas de código para que un agente agente sea compatible con el agente:

¡Eso es todo! El resto del código (inicialización de modelos, integraciones de API y deducción del agente) se mantiene exactamente como era. AgentCore maneja la infraestructura mientras su agente maneja la inteligencia. Este patrón de integración funciona para la mayoría de los marcos de agentes de Python, lo que hace que Agentcore sea verdaderamente descreído de entorno.

Implementación de AgentCore Runtime: paso a paso

Vamos a caminar por el proceso de implementación actual utilizando el Kit de herramientas de inicio de agenteque simplifica drásticamente el flujo de trabajo de implementación.

Requisitos previos

Antiguamente de comenzar, asegúrese de tener:

- Python 3.10 o superior

- Credenciales de AWS configuradas

- Amazon Bedrock Agentcore SDK instalado

Paso 1: permisos de IAM

Hay dos diferentes AWS Identity and Access Management (IAM) Permisos que debe considerar al implementar un agente en un tiempo de ejecución de Agentcore: el papel que usted usa para crear posibles de agente y el papel de ejecución que un agente necesita ejecutar en un tiempo de ejecución de Agentcore. Mientras que el zaguero rol ahora puede ser creado automáticamente por el kit de herramientas de inicio de AgentCore (auto_create_execution_role=True), el primero debe definirse como se describe en IAM Permisos para el tiempo de ejecución de AgentCore.

Paso 2: Agregue un envoltorio a su agente

Como se muestra en el ejemplo de agentes profundos anteriores, agregue las importaciones y el interiorista de AgentCore a su código de agente existente.

Paso 3: Implementar utilizando el kit de herramientas de inicio de AgentCore

El kit de herramientas de inicio Proporciona un proceso de implementación de tres pasos:

Paso 4: Lo que sucede detrás de suceso

Cuando ejecuta la implementación, el kit de inicio automáticamente:

- Genera un archivo Docker optimizado con imagen pulvínulo Python 3.13-Slim e instrumentación de Operentelemetry

- Construye su contenedor con las dependencias de

requirements.txt - Crea un Amazon Elastic Container Registry (Amazon ECR) repositorio (

if auto_create_ecr=True) y empuja tu imagen - Implementa el tiempo de ejecución de AgentCore y monitorea el estado de implementación

- Configura la red y la observabilidad con Amazon CloudWatch y AWS X-Ray integración

Todo el proceso generalmente toma de 2 a 3 minutos, a posteriori de lo cual su agente está astuto para manejar las solicitudes a escalera. Cada nueva sesión se gancho en su propia microvm de tiempo de ejecución de AgentCore, manteniendo el aislamiento completo del entorno.

El kit de inicio genera un archivo de configuración (.bedrock_agentcore.yaml) que captura su configuración de implementación, lo que hace que sea sencillo retornar a desplegar o poner al día a su agente más tarde.

Invocar a su agente desplegado

A posteriori de la implementación, tiene dos opciones para invocar a su agente:

Opción 1: Uso del kit de inicio (que se muestra en el paso 3)

Opción 2: Uso de Boto3 SDK directamente

Agentes profundos en batalla

A medida que el código se ejecuta en el tiempo de ejecución de Bedrock Agentcore, el agente principal banda sub-agentes especializados, cada uno con su propio propósito, aviso y ataque a la utensilio, para resolver tareas complejas de modo más efectiva. En este caso, el indicador del orquestador (research_instructions) establece el plan:

- Escribe la pregunta a preguntas.txt

- Faned a una o más llamadas de agente de investigación (cada una en una sola sub-tope) utilizando la utensilio de Internet_search

- Sintetizar los hallazgos en Final_report.md

- Llame a la crítica-agente para evaluar lagunas y la estructura

- Opcionalmente, acogerse a más investigación/ediciones hasta que se cumplan la calidad

Aquí está en batalla:

Higienizar

Cuando esté terminado, no olvide desalentar el tiempo de ejecución de AgentCore Provisions encima del repositorio de contenedores que se creó durante el proceso:

Conclusión

Amazon Bedrock AgentCore representa un cambio de modelo en la forma en que implementamos agentes de IA. Al conceptualizar la complejidad de la infraestructura mientras se mantiene la flexibilidad del entorno y el maniquí, AgentCore permite a los desarrolladores centrarse en construir una deducción de agente sofisticada en división de ordenar las tuberías de implementación. Nuestra implementación de los agentes profundos demuestra que incluso los sistemas complejos de múltiples agentes con integraciones de API externas pueden implementarse con cambios de código mínimos. La combinación de seguridad de nivel empresarial, observabilidad incorporada y escalera sin servidor hace que Agentcore sea la mejor opción para las implementaciones de agentes de IA de producción. Específicamente para agentes de investigación profunda, AgentCore ofrece las siguientes capacidades únicas que puede explorar:

- El tiempo de ejecución de AgentCore puede manejar el procesamiento asincrónico y los agentes de funcionamiento dispendioso (hasta 8 horas). Las tareas asincrónicas permiten que su agente continúe procesando a posteriori de contestar al cliente y manejar operaciones de larga duración sin estrechar las respuestas. Su subicent de investigación de informes podría ser investigando asincrónicamente durante horas.

- AgentCore Runtime funciona con Memoria de agentecapacidades habilitadoras como apoyarse en hallazgos anteriores, recapacitar preferencias de investigación y apoyar un contexto de investigación engorroso sin perder el progreso entre las sesiones.

- Puedes usar Puerta de entrada de agente Para extender su investigación profunda para incluir ideas patentadas de servicios empresariales y fuentes de datos. Al exponer estos posibles diferenciados como herramientas de MCP, sus agentes pueden aprovecharlo rápidamente y combinarlo con el conocimiento habitable públicamente.

¿Astuto para implementar a sus agentes en la producción? Aquí está cómo comenzar:

- Instale el kit de inicio de AgentCore:

pip install bedrock-agentcore-starter-toolkit - Cuestionario: Implementa tu código siguiendo esto plano paso a paso.

La era de los agentes de IA listos para la producción está aquí. Con AgentCore, el delirio de prototipo a producción nunca ha sido más corto.

Sobre los autores

Vadim omeltchenko es un arquitecto de soluciones de AI/ML que es apasionado por ayudar a los clientes de AWS a innovar en la cúmulo. Su experiencia preliminar de TI fue predominantemente en el circunscripción.

Vadim omeltchenko es un arquitecto de soluciones de AI/ML que es apasionado por ayudar a los clientes de AWS a innovar en la cúmulo. Su experiencia preliminar de TI fue predominantemente en el circunscripción.

Eashan Kaushik es un arquitecto de soluciones especializadas AI/ML en Amazon Web Services. Está impulsado por crear soluciones de IA generativas de vanguardia al tiempo que prioriza un enfoque centrado en el cliente para su trabajo. Antiguamente de este papel, obtuvo una EM en informática de la Escuela de Ingeniería NYU Tandon. Fuera del trabajo, disfruta de deportes, motín y maratones corriendo.

Eashan Kaushik es un arquitecto de soluciones especializadas AI/ML en Amazon Web Services. Está impulsado por crear soluciones de IA generativas de vanguardia al tiempo que prioriza un enfoque centrado en el cliente para su trabajo. Antiguamente de este papel, obtuvo una EM en informática de la Escuela de Ingeniería NYU Tandon. Fuera del trabajo, disfruta de deportes, motín y maratones corriendo.

Shreyas subramaniano es un irrefutable principal de datos y ayuda a los clientes al usar el educación forzoso para resolver sus desafíos comerciales utilizando la plataforma AWS. Shreyas tiene experiencia en optimización a gran escalera y educación forzoso, y en el uso del educación forzoso y el educación de refuerzo para acelerar las tareas de optimización.

Shreyas subramaniano es un irrefutable principal de datos y ayuda a los clientes al usar el educación forzoso para resolver sus desafíos comerciales utilizando la plataforma AWS. Shreyas tiene experiencia en optimización a gran escalera y educación forzoso, y en el uso del educación forzoso y el educación de refuerzo para acelerar las tareas de optimización.

Mark Roy es un principal arquitecto de educación forzoso de AWS, que ayuda a los clientes a diseñar y construir soluciones generativas de IA. Su enfoque desde principios de 2023 ha sido liderar los esfuerzos de obra de soluciones para el dispersión de Amazon Bedrock, la ofrecimiento de IA generativa insignia de AWS para constructores. El trabajo de Mark cubre una amplia gradación de casos de uso, con un interés primario en la IA generativa, los agentes y la escalera de ML en toda la empresa. Ha ayudado a empresas en seguros, servicios financieros, medios y entretenimiento, atención médica, servicios públicos y fabricación. Antiguamente de unirse a AWS, Mark fue un arquitecto, desarrollador y líder de tecnología durante más de 25 primaveras, incluidos 19 primaveras en servicios financieros. Mark posee seis certificaciones de AWS, incluida la certificación de división de ML.

Mark Roy es un principal arquitecto de educación forzoso de AWS, que ayuda a los clientes a diseñar y construir soluciones generativas de IA. Su enfoque desde principios de 2023 ha sido liderar los esfuerzos de obra de soluciones para el dispersión de Amazon Bedrock, la ofrecimiento de IA generativa insignia de AWS para constructores. El trabajo de Mark cubre una amplia gradación de casos de uso, con un interés primario en la IA generativa, los agentes y la escalera de ML en toda la empresa. Ha ayudado a empresas en seguros, servicios financieros, medios y entretenimiento, atención médica, servicios públicos y fabricación. Antiguamente de unirse a AWS, Mark fue un arquitecto, desarrollador y líder de tecnología durante más de 25 primaveras, incluidos 19 primaveras en servicios financieros. Mark posee seis certificaciones de AWS, incluida la certificación de división de ML.