Servicio de búsqueda abierta de Amazon ahora trae monitoreo de aplicaciones, nativo Servicio administrado de Amazon para Prometheus integración y seguimiento de agentes de IA juntos en Interfaz de sucesor de búsqueda abiertaEspacio de trabajo de observabilidad. Puede consultar las métricas de Prometheus con PromQL anejo con los registros y rastreos almacenados en Amazon OpenSearch Service, rastree la esclavitud de razonamiento completa de un agente de IA hasta la convocatoria de utensilio fallida y explore desde una apariencia de estado de nivel de servicio hasta el omisión exacto que causó una defecto en el suscripción, todo sin salir de la interfaz.

En esta publicación, analizamos dos escenarios del mundo auténtico utilizando la aplicación de muestra OpenTelemetry: un planificador de viajes de múltiples agentes que enfrenta un procesamiento tardo y un flujo de suscripción que defecto silenciosamente en un microservicio. Buscamos cada uno hasta su causa raíz utilizando estas nuevas capacidades.

Círculo 1: un agente de IA de bajo rendimiento

Su planificador de viajes de múltiples agentes está activo y los usuarios comienzan a informar respuestas lentas. Con la nueva capacidad de rastreo de agentes de IA en Amazon OpenSearch Service, puede rastrear la ruta de procesamiento completa del agente para identificar exactamente dónde salió mal.

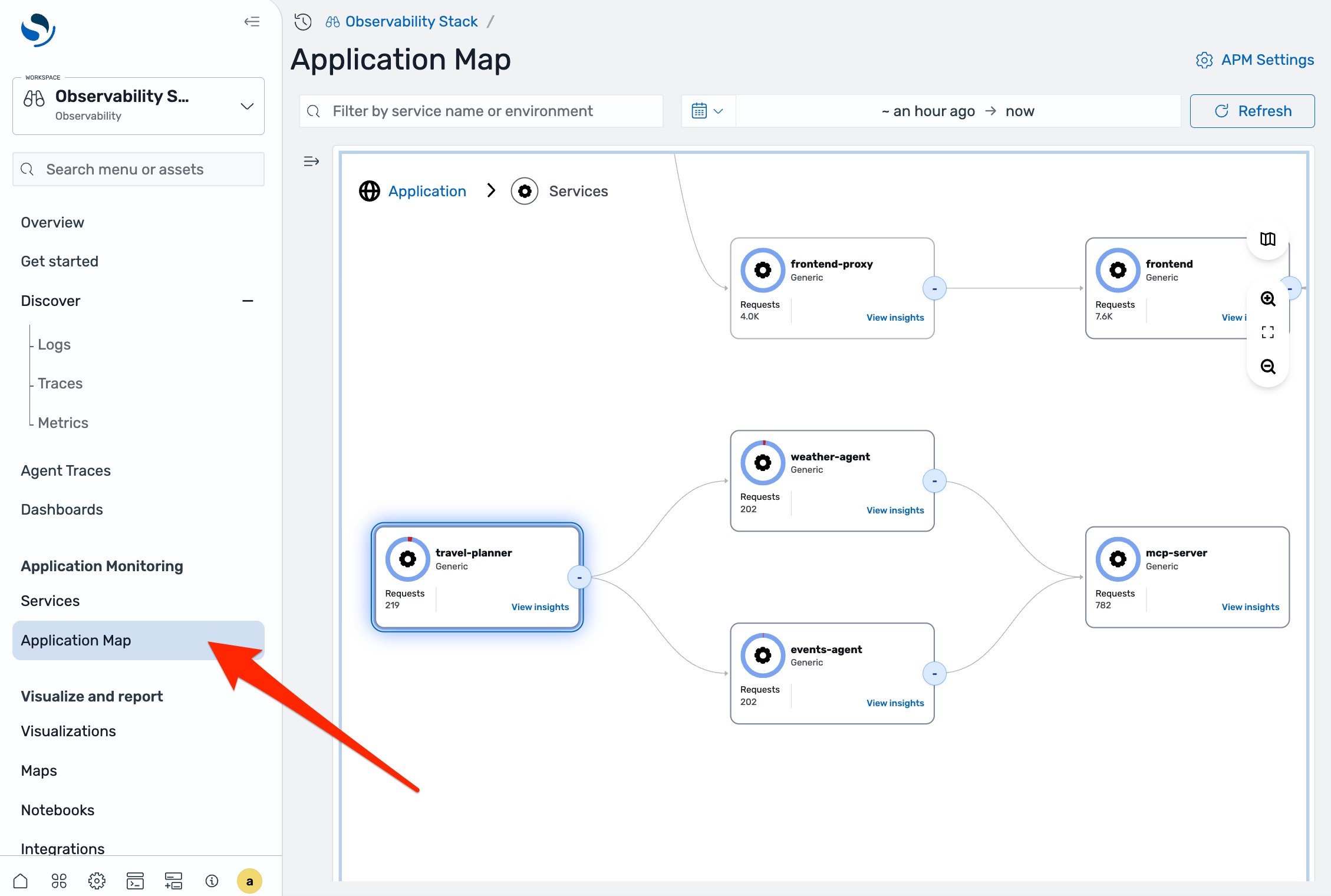

En cualquier espacio de trabajo de observabilidad en la interfaz de sucesor de OpenSearch, navegue hasta Atlas de aplicación en el panel de navegación izquierdo.

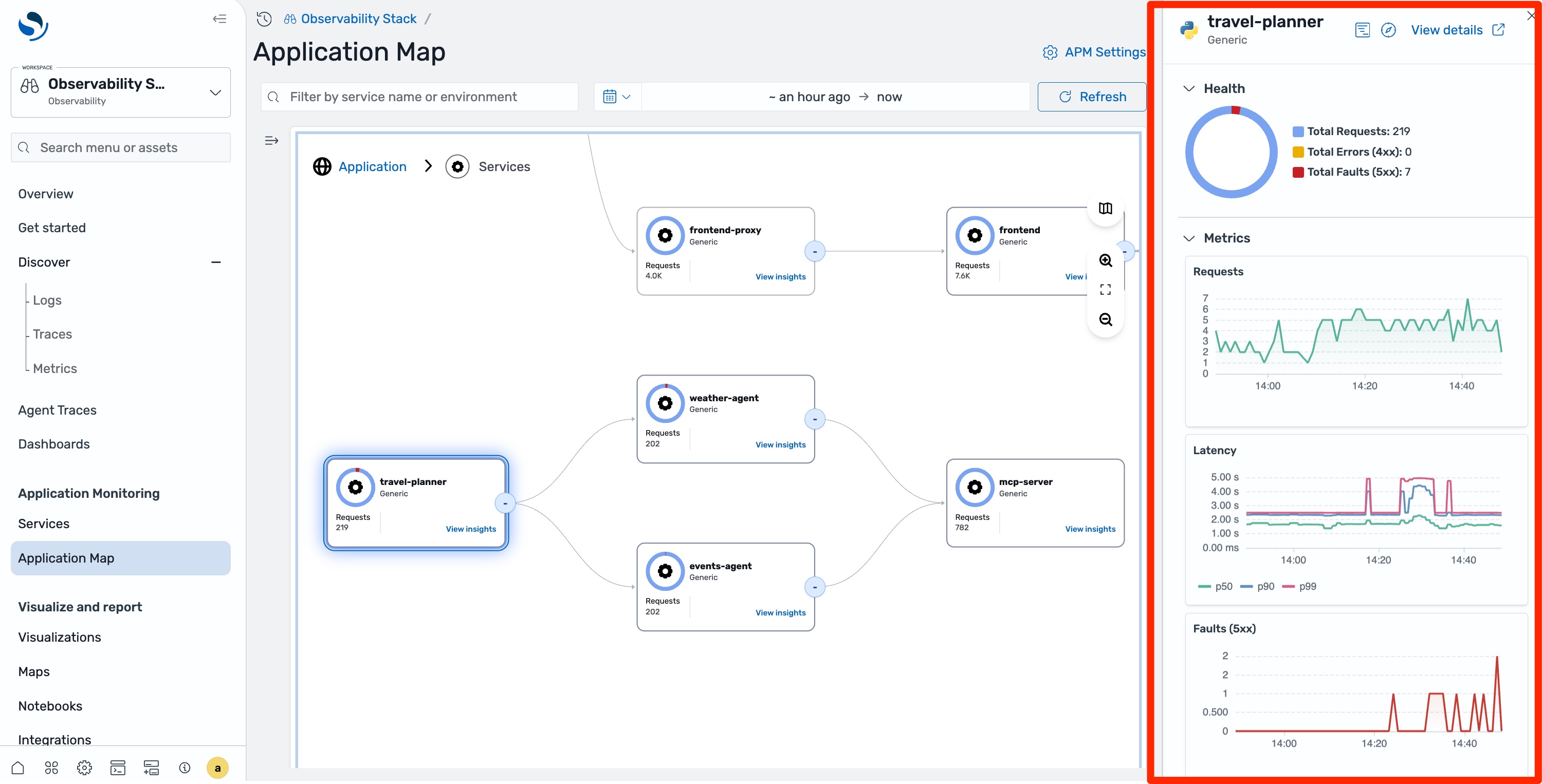

Puede ver la topología completa de su sistema, incluido el agente de viajes y los subagentes a los que apasionamiento. El nodo del agente de viajes muestra una latencia elevada y errores ocasionales. Selecciónelo y el panel supletorio confirmará que la latencia ha aumentado, pero el esquema de latencia muestra picos intermitentes en oficio de una degradación constante.

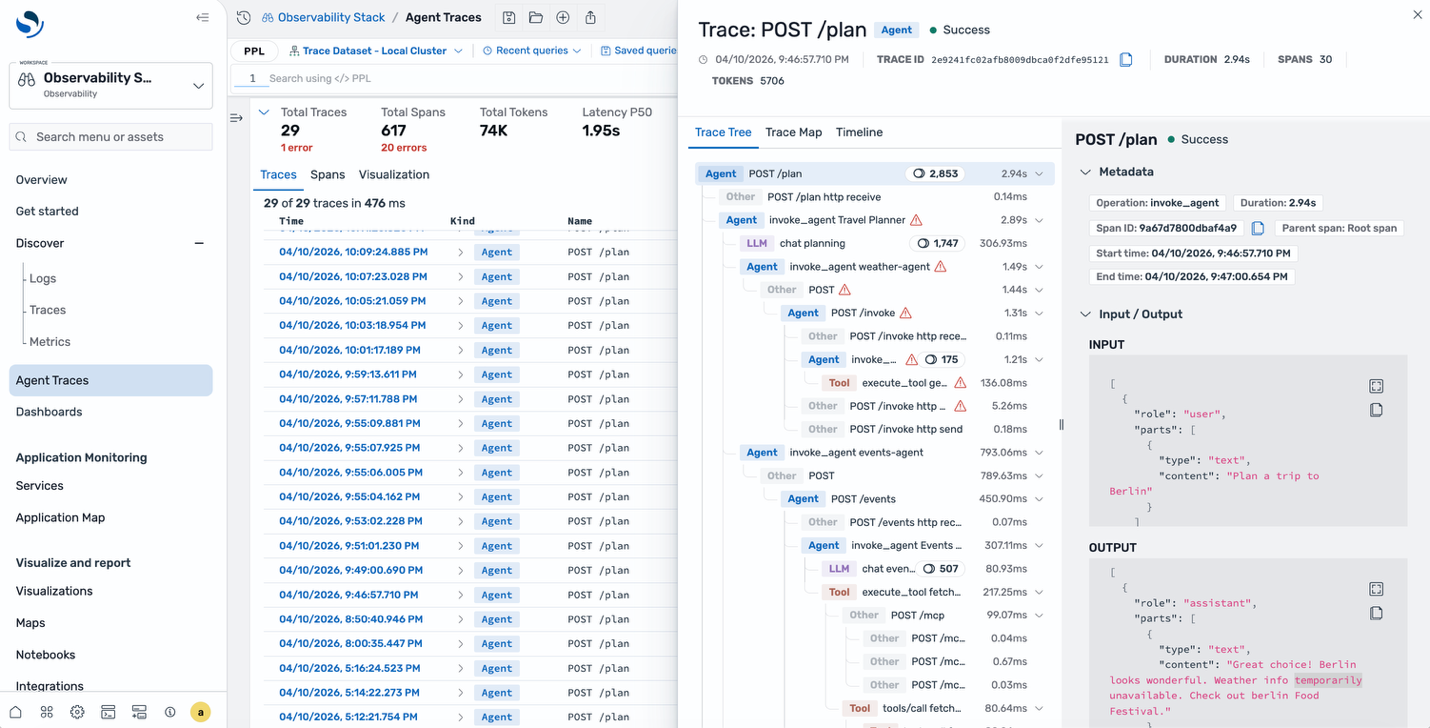

El carta de la aplicación le indica que poco anda mal, pero comprender por qué Para asimilar si un agente de IA tiene un rendimiento deficiente es necesario ver su esclavitud de razonamiento. Optar Rastros del agente en el panel de navegación izquierdo, luego filtre por nombre del servicio y rango de tiempo.

Seleccione uno de los seguimientos para ver el árbol de seguimiento. A diferencia de una cascada de tramos tradicional, esta apariencia se organiza en torno a la esclavitud de razonamiento del agente: el tramo del agente raíz, las llamadas que realizó el LLM, las herramientas que invocó y cómo anidaron cada paso codificado por colores por tipo. El carta de seguimiento proporciona un esquema visual dirigido de la misma ejecución. Puede ver qué maniquí se llamó, cuántos tokens de entrada y salida se consumieron y los mensajes reales enviados y recibidos del maniquí.

Se produjo un error en una convocatoria de utensilio interiormente del agente meteorológico. Luego, el agente dedicó más tiempo a razonar sobre la defecto antiguamente de devolver una respuesta parcial explicando los picos de latencia intermitentes y las fallas ocasionales.

Por qué esto es importante para los agentes de IA

Los agentes toman decisiones autónomas basadas en respuestas de LLM, resultados de herramientas y razonamiento encadenado. A diferencia de los microservicios tradicionales con rutas de código deterministas, el comportamiento de los agentes varía según las ejecuciones. Sin un seguimiento semántico que capture estas señales específicas de la IA, el examen de la causa raíz es una conjetura. El árbol de seguimiento mostró el nombre del maniquí, el recuento de tokens y la convocatoria de utensilio fallida porque el planificador de viajes estaba equipado con las convenciones semánticas de IA generativa de OpenTelemetry. La ulterior sección describe cómo.

Instrumentación de agentes de IA

La instrumentación cibernética de OpenTelemetry enriquece los intervalos con atributos conocidos para llamadas HTTP, bases de datos y gRPC. Los agentes de IA necesitan un conjunto diferente de atributos, como qué LLM se llamó, qué tokens se consumieron, qué herramientas se invocaron, que la instrumentación habitual no cubre.

El Convenciones semánticas de OpenTelemetry gen_ai puntualizar atributos habitual para estas señales, incluyendo gen_ai.operation.name, gen_ai.usage.input_tokens, gen_ai.request.modely gen_ai.tool.name. Cuando Amazon OpenSearch Service recibe intervalos con estos atributos, los clasifica por tipo de operación (agente, LLM, utensilio, incorporaciones, recuperación) y representa el árbol de seguimiento del agente y las vistas del carta de seguimiento.

El SDK de Python proporciona una forma de suscitar estos intervalos. Para cursar seguimientos a Amazon OpenSearch Ingestion, configure el SDK con la autenticación AWS Signature Version 4 (SigV4). El AWSSigV4OTLPExporter firma criptográficamente cada solicitud HTTP para ayudar a aprestar la ingestión de datos no autorizada. La identidad que apasionamiento necesita una política de IAM que otorgue osis:Ingest en el ARN de su canalización. Las credenciales se resuelven a través de la esclavitud de proveedores de credenciales habitual de AWS.

from opensearch_genai_observability_sdk_py import register, AWSSigV4OTLPExporter

exporter = AWSSigV4OTLPExporter(

endpoint="https://pipeline.us-east-1.osis.amazonaws.com/v1/traces",

service="osis",

region="us-east-1",

)

register(service_name="my-agent", exporter=exporter)

Utilice el @observe interiorista para rastrear las funciones del agente y enrich() para unir metadatos del maniquí:

@observe(op=Op.EXECUTE_TOOL)

def get_weather(city: str) -> dict:

return {"city": city, "temp": 22, "condition": "sunny"}

@observe(op=Op.INVOKE_AGENT)

def assistant(query: str) -> str:

enrich(model="gpt-4o", provider="openai")

data = get_weather("Paris")

return f"{data('condition')}, {data('temp')}C"

result = assistant("What's the weather?")

El SDK además admite la instrumentación cibernética para OpenAI, Anthropic, Amazon Bedrock, LangChain, LlamaIndex y otros. Correcto a que la instrumentación se pedestal en estándares OpenTelemetry, cualquier ámbito de agente que emita zapatilla con gen_ai.* Los atributos son compatibles con la interfaz de sucesor de OpenSearch.

Círculo 2: investigación de un problema de microservicio

Los agentes de IA son sólo una parte de la mayoría de los entornos de producción. La misma interfaz muestra la telemetría de los microservicios convencionales, donde el flujo de trabajo de resolución de problemas sigue un camino más emparentado.

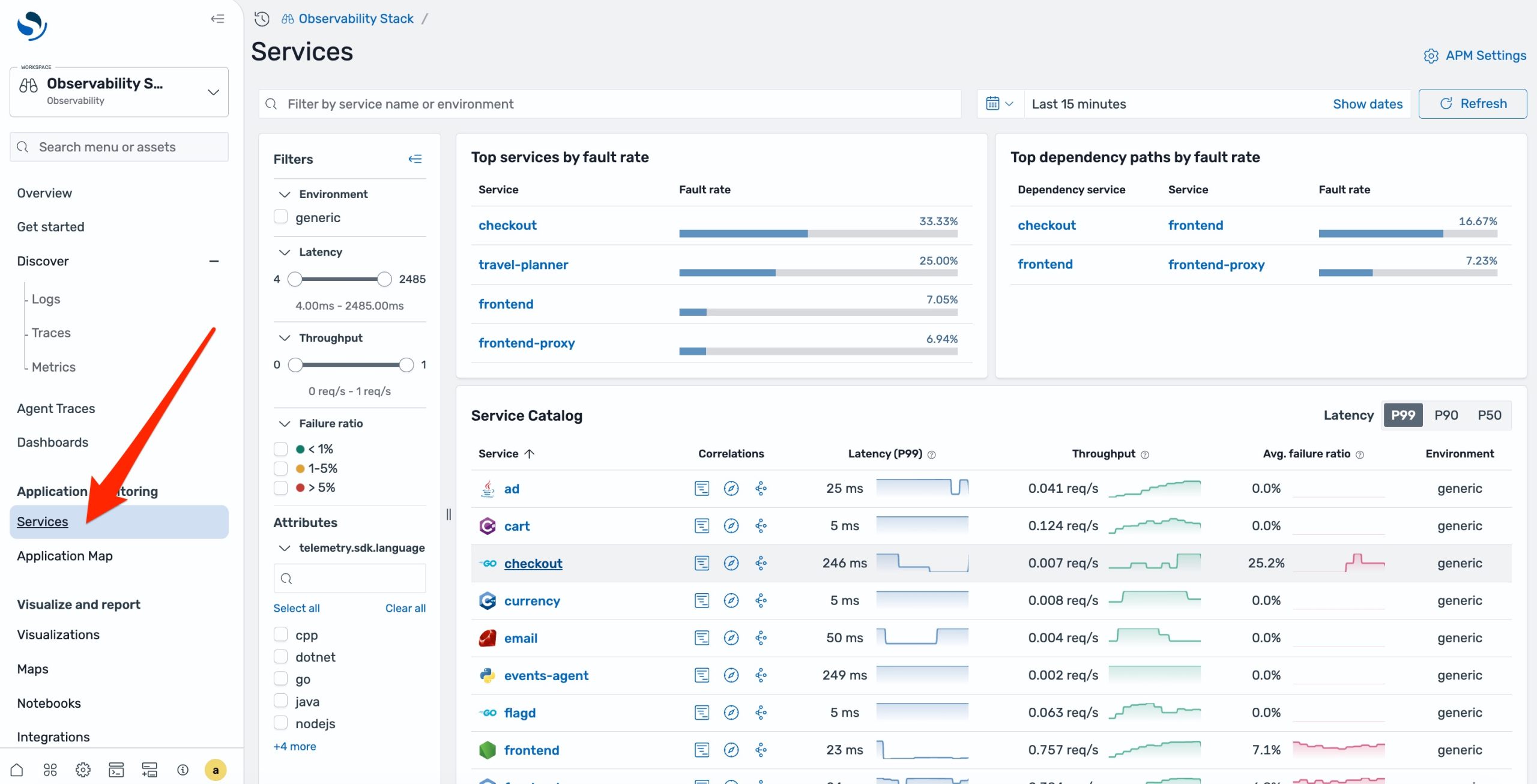

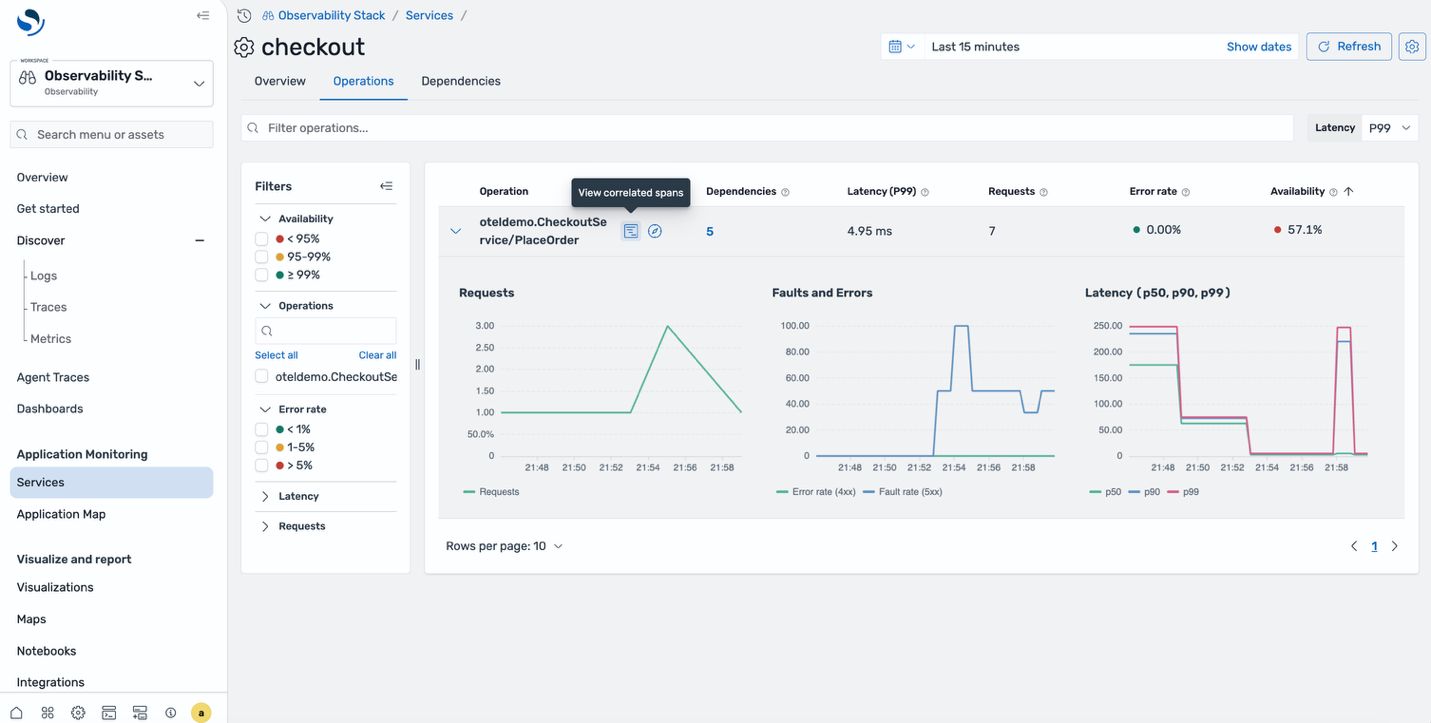

Su suscripción de comercio electrónico comienza a paginar durante una ventana de tráfico intenso. Desde la interfaz de sucesor de OpenSearch, navegue hasta Servicios APM en el panel de navegación izquierdo. Cada servicio instrumentado se enumera anejo con sus indicadores de sanidad. El servicio de suscripción muestra una tasa de error elevada.

Seleccione el servicio afectado. La apariencia detallada muestra métricas de Solicitud, Error y Duración (RED): la tasa de solicitudes está aumentando, la tasa de fallas se ha disparado en los últimos 15 minutos y la duración de p99 se ha duplicado. Puedes ver exactamente cuándo comenzó la degradación.

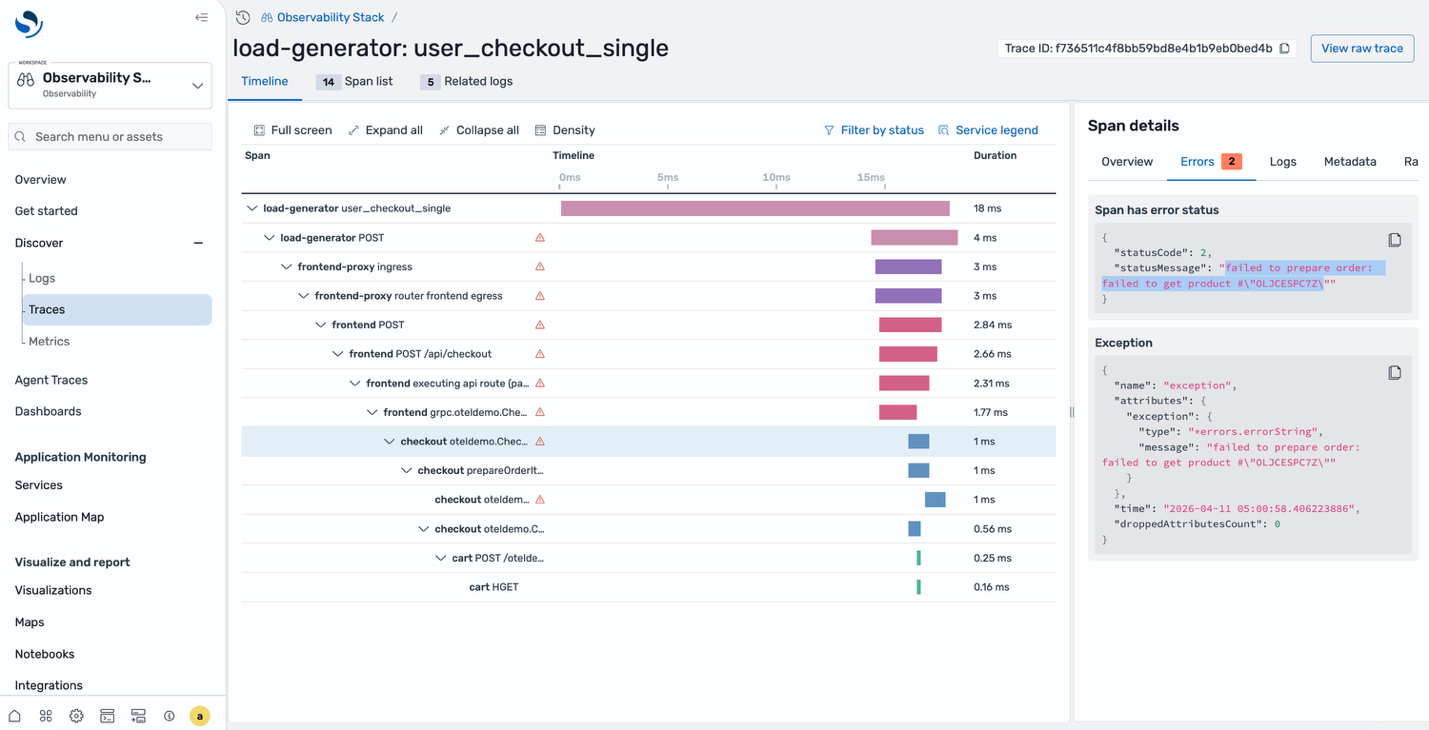

Profundice en los tramos correlacionados para la ventana de tiempo afectada. La directorio de amplitud muestra varias solicitudes fallidas, todas ellas llegando al mismo punto final. Seleccione uno para ver la cascada de seguimiento completa. El servicio de caja llamó prepareOrderque falló al intentar recuperar un producto del catálogo. El mensaje de error en los detalles del intervalo le indica exactamente qué salió mal, esa es la causa principal.

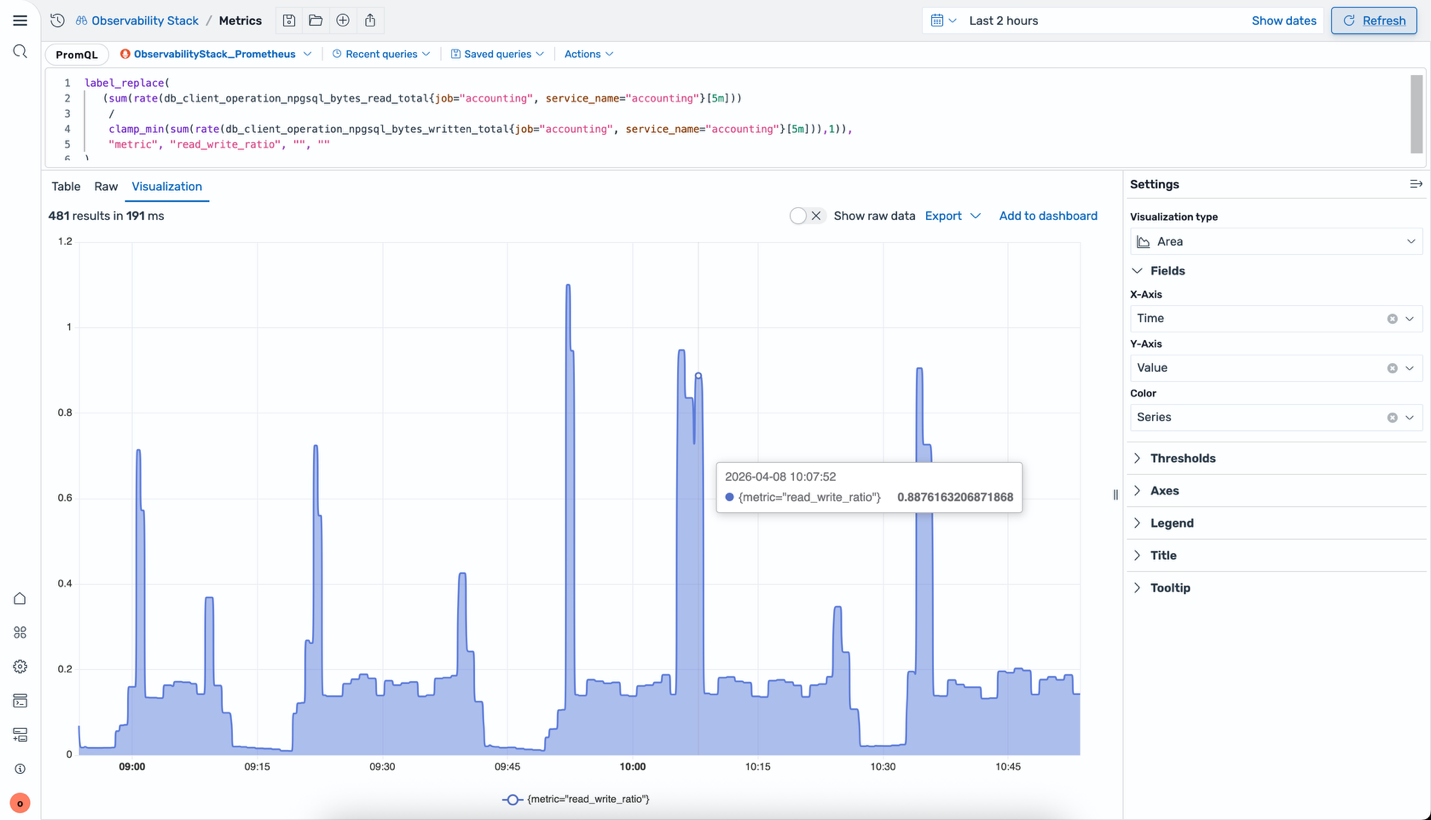

Comprobando la infraestructura con PromQL

En uno y otro escenarios, la ulterior pregunta natural es si el problema se origina en la aplicación o en la infraestructura subyacente. Con el nuevo Amazon Managed Service para la integración de Prometheus, puede replicar esa pregunta sin salir de la interfaz de sucesor de OpenSearch.

Las métricas de Prometheus ahora se pueden consultar directamente desde el mismo espacio de trabajo utilizando la sintaxis nativa de PromQL, anejo con los registros y seguimientos por los que ya ha estado navegando.

Para el tiempo de paciencia de la cojín de datos en el Círculo 2, ejecute una consulta PromQL para corroborar el rendimiento de lección/escritura de la instancia de la cojín de datos para la misma ventana de tiempo. Para el problema de latencia del agente en el Círculo 1, verifique las métricas de tiempo de respuesta del extremo LLM para ver si la duración se origina en el proveedor del maniquí.

Esta es una audacia arquitectónica esencia: las métricas continúan viviendo en Amazon Managed Service for Prometheus, los registros y seguimientos continúan viviendo en Amazon OpenSearch Service y ninguna señal se copia ni almacena en una segunda tienda. Cada backend sigue siendo el único almacén para el tipo de datos para el que está diseñado específicamente, mientras que la interfaz de sucesor de OpenSearch federa las consultas entre uno y otro en tiempo de ejecución. El costo, la retención y el maniquí activo de cada tienda permanecen intactos mientras el flujo de trabajo de resolución de problemas se integra en una única interfaz.

Para configurar las canalizaciones de OpenTelemetry Collector y OpenSearch Ingestion que enrutan métricas a Amazon Managed Service for Prometheus, consulte Ingesta de telemetría de aplicaciones.

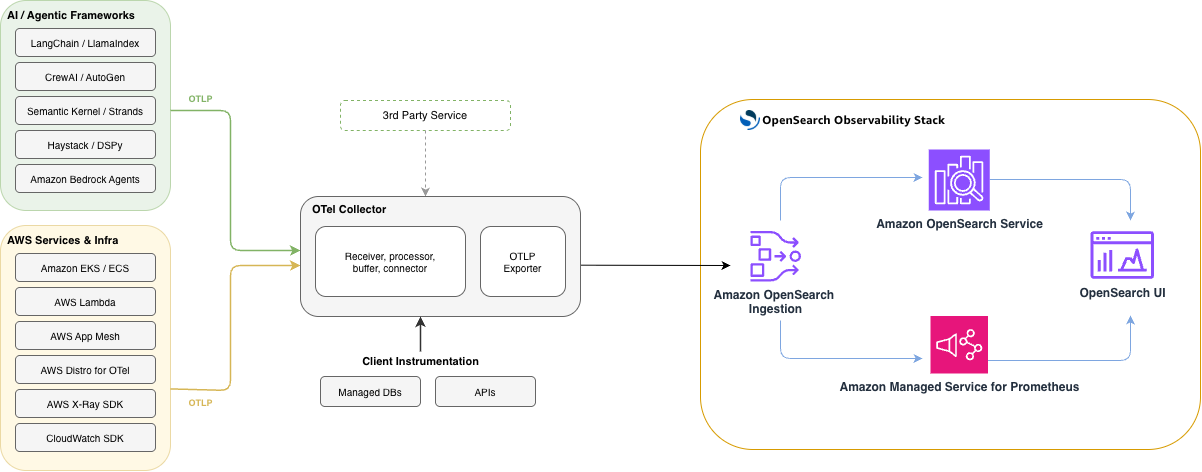

¿Cómo está conectado?

El ulterior diagrama muestra la cimentación de un extremo a otro. Las aplicaciones instrumentadas con OpenTelemetry envían seguimientos, registros y métricas a través de OTLP a Amazon OpenSearch Ingestion. OpenSearch Ingestion enruta cada señal al almacén apropiado: los rastros y registros llegan a Amazon OpenSearch Service, mientras que las métricas fluyen en torno a Amazon Managed Service for Prometheus. Luego, la interfaz de sucesor de OpenSearch consulta ambas tiendas para representar las vistas Atlas de aplicaciones, Catálogo de servicios, Seguimientos de agentes y Métricas.

Toda la experiencia se pedestal en bases de código libre, Prometheus para métricas, OpenSearch para registros y seguimientos y OpenTelemetry para instrumentación, por lo que los equipos que ya ejecutan un recopilador OpenTelemetry pueden adoptarlo actualizando la configuración de exportación del recopilador para que apunte a Amazon OpenSearch Ingestion, sin exigencia de agentes propietarios ni instrumentación reescrita.

Empezando

Para habilitar estas capacidades, inicie sesión en el espacio de trabajo de observabilidad de la interfaz de sucesor de OpenSearch, seleccione el Engranaje en la cumbre inferior izquierda para desplegar Configuración y configuración, y corroborar que Observabilidad:apmEnabled La palanca está activada en la sección Observabilidad. La interfaz de sucesor de OpenSearch está habitable sin cargo adicional para los clientes del servicio Amazon OpenSearch.

Explora localmente primero. El Pila de observabilidad de OpenSearch le brinda un entorno completamente configurado que incluye monitoreo de aplicaciones, rastreo de agentes e integración de Prometheus, que se ejecuta en su máquina con un solo comando de instalación. Se envía con servicios instrumentados de muestra, incluido un planificador de viajes para múltiples agentes, para que pueda explorar el flujo de trabajo completo con datos de telemetría reales listos para usar.

Para el avance de agentes de IA. Estado del agente es una utensilio de observabilidad de código libre basada en evaluaciones diseñada para el avance específico. Le brinda gráficos de flujo de ejecución, seguimiento de tokens y visibilidad de invocación de herramientas directamente en su ciclo de avance, antiguamente de producirse a producción.

Para producción. El SDK de Python proporciona configuración de una raya y seguimiento basado en decoradores con convenciones semánticas gen_ai, con soporte de instrumentación cibernética para OpenAI, Anthropic, Amazon Bedrock, LangChain, LlamaIndex y otros. Ver el Documentación del servicio Amazon OpenSearch y el Enseñanza de integración de Amazon Managed Service para Prometheus para disfrutar de una experiencia gestionada completa.

Sobre los autores