Digamos que una persona lleva a su Bulldog Francés, Bowser, al parque para perros. Identificar a Bowser mientras juega entre los otros caninos es viable para el dueño del perro mientras está en el motivo.

Pero si cualquiera quiere utilizar un maniquí de IA generativa como GPT-5 para monitorear a su mascota mientras está en el trabajo, el maniquí podría patinar en esta tarea básica. Los modelos de visión y habla como GPT-5 a menudo destacan en el inspección de objetos generales, como un perro, pero no funcionan aceptablemente en la lugar de objetos personalizados, como Bowser, el bulldog francés.

Para afrontar esta deficiencia, investigadores del MIT y del MIT-IBM Watson AI Lab han introducido un nuevo método de entrenamiento que enseña a modelos de visión y habla a delimitar objetos personalizados en una suceso.

Su método utiliza datos de seguimiento de vídeo cuidadosamente preparados en los que se rastrea el mismo objeto en varios fotogramas. Diseñaron el conjunto de datos de modo que el maniquí deba centrarse en pistas contextuales para identificar el objeto personalizado, en motivo de pender del conocimiento que memorizó previamente.

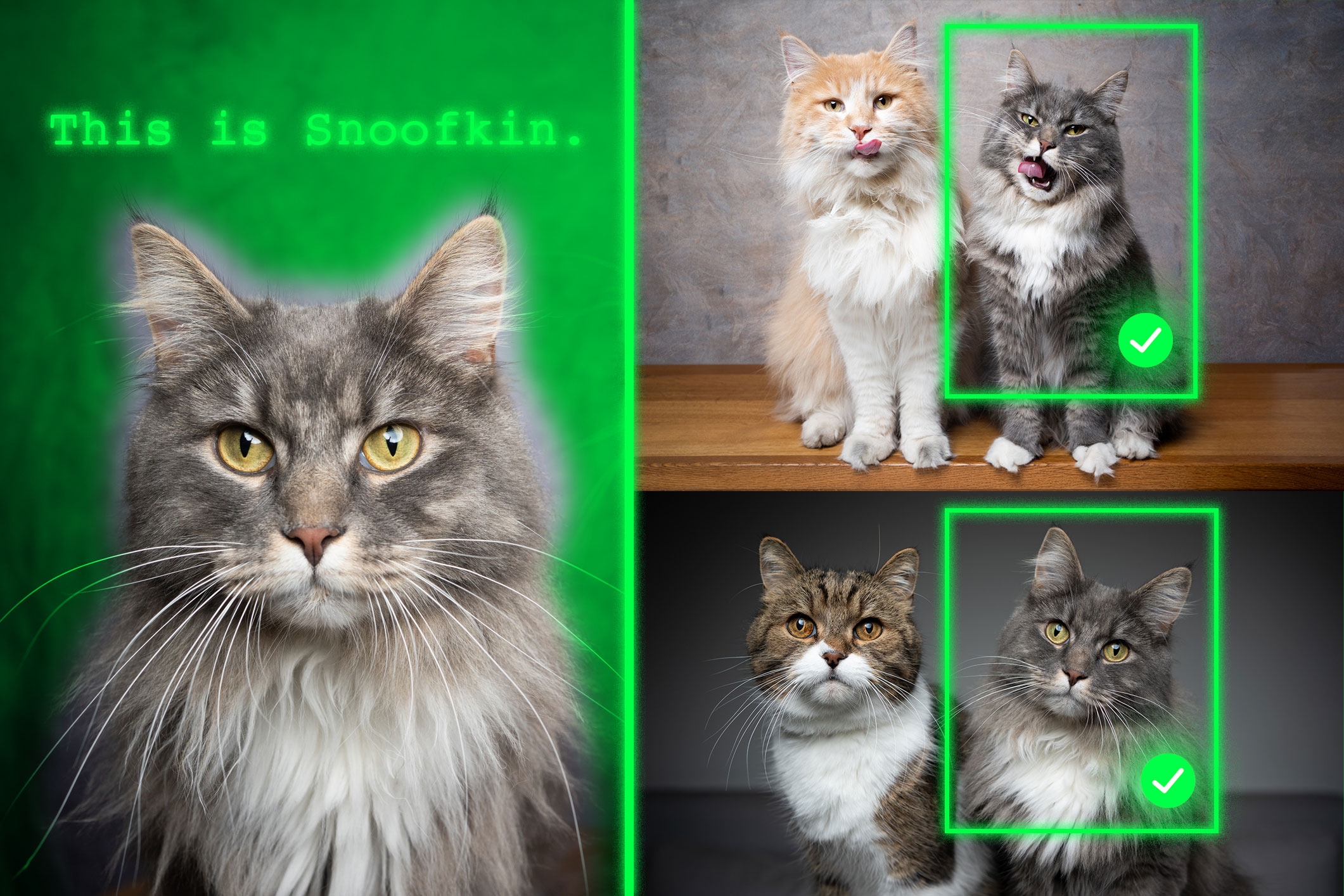

Cuando se le dan algunas imágenes de ejemplo que muestran un objeto personalizado, como la mascota de cualquiera, el maniquí reentrenado es más capaz de identificar la ubicación de esa misma mascota en una nueva imagen.

Los modelos reentrenados con su método superaron en esta tarea a los sistemas más modernos. Es importante destacar que su técnica deja intactas el resto de las habilidades generales del maniquí.

Este nuevo enfoque podría ayudar a los futuros sistemas de inteligencia sintético a rastrear objetos específicos a lo amplio del tiempo, como la mochila de un chaval, o delimitar objetos de interés, como una especie de animal en el monitoreo ecológico. Además podría ayudar en el progreso de tecnologías de protección impulsadas por IA que ayuden a los usuarios con discapacidad visual a encontrar ciertos principios en una habitación.

«En última instancia, queremos que estos modelos sean capaces de formarse del contexto, tal como lo hacen los humanos. Si un maniquí puede hacer esto aceptablemente, en motivo de retornar a entrenarlo para cada nueva tarea, podríamos simplemente proporcionar algunos ejemplos e inferir cómo realizar la tarea a partir de ese contexto. Esta es una tiento muy poderosa», dice Jehanzeb Mirza, postdoctorado del MIT y autor principal de un artículo sobre esta técnica.

A Mirza se unen en el artículo los coautores principales Sivan Doveh, estudiante de posgrado en el Instituto Weizmann de Ciencias; y Nimrod Shabtay, investigador de IBM Research; James Glass, verificado investigador senior y caudillo del Especie de Sistemas de Habla Hablado en el Laboratorio de Ciencias de la Computación e Inteligencia Industrial del MIT (CSAIL); y otros. El trabajo será presentado en la Conferencia Internacional sobre Visión por Computador.

Una deficiencia inesperada

Los investigadores han descubierto que los modelos de habla grandes (LLM) pueden sobresalir en el estudios del contexto. Si le dan a un LLM algunos ejemplos de una tarea, como problemas de suma, puede formarse a contestar nuevos problemas de suma según el contexto que se le ha proporcionado.

Un maniquí de visión-lenguaje (VLM) es esencialmente un LLM con un componente visual conectado a él, por lo que los investigadores del MIT pensaron que heredaría las capacidades de estudios en contexto del LLM. Pero este no es el caso.

«La comunidad de investigadores aún no ha podido encontrar una respuesta en blanco y cabreado a este problema particular. El cuello de botella podría surgir del hecho de que se pierde parte de la información visual en el proceso de fusionar los dos componentes, pero simplemente no lo sabemos», dice Mirza.

Los investigadores se propusieron mejorar las capacidades de los VLM para realizar lugar en contexto, lo que implica encontrar un objeto específico en una nueva imagen. Se centraron en los datos utilizados para retornar a entrenar los VLM existentes para una nueva tarea, un proceso llamado ajuste fino.

Los datos de ajuste típicos se recopilan de fuentes aleatorias y representan colecciones de objetos cotidianos. Una imagen puede contener coches estacionados en una calle, mientras que otra incluye un ramo de flores.

«No existe una coherencia auténtico en estos datos, por lo que el maniquí nunca aprende a indagar el mismo objeto en múltiples imágenes», afirma.

Para solucionar este problema, los investigadores desarrollaron un nuevo conjunto de datos seleccionando muestras de datos de seguimiento de vídeo existentes. Estos datos son videoclips que muestran el mismo objeto moviéndose a través de una suceso, como un tigre caminando por un prado.

Cortaron fotogramas de estos vídeos y estructuraron el conjunto de datos de modo que cada entrada constara de varias imágenes que mostraran el mismo objeto en diferentes contextos, con ejemplos de preguntas y respuestas sobre su ubicación.

«Al utilizar múltiples imágenes del mismo objeto en diferentes contextos, alentamos al maniquí a delimitar consistentemente ese objeto de interés centrándose en el contexto», explica Mirza.

Forzando el enfoque

Pero los investigadores descubrieron que los VLM tienden a hacer trampa. En motivo de contestar basándose en pistas del contexto, identificarán el objeto utilizando los conocimientos adquiridos durante el entrenamiento previo.

Por ejemplo, hexaedro que el maniquí ya aprendió que la imagen de un tigre y la marbete «tigre» están correlacionadas, podría identificar al tigre que cruza el pastizal basándose en este conocimiento previamente entrenado, en motivo de inferir del contexto.

Para resolver este problema, los investigadores utilizaron pseudonombres en motivo de nombres reales de categorías de objetos en el conjunto de datos. En este caso, cambiaron el nombre del tigre a “Charlie”.

«Nos tomó un tiempo descubrir cómo evitar que el maniquí hiciera trampa. Pero cambiamos el repertorio para el maniquí. El maniquí no sabe que ‘Charlie’ puede ser un tigre, por lo que se ve obligado a mirar el contexto», dice.

Los investigadores asimismo enfrentaron desafíos para encontrar la mejor guisa de preparar los datos. Si los fotogramas están demasiado juntos, el fondo no cambiará lo suficiente como para proporcionar complejidad de datos.

Al final, el ajuste de los VLM con este nuevo conjunto de datos mejoró la precisión de la lugar personalizada en aproximadamente un 12 por ciento en promedio. Cuando incluyeron el conjunto de datos con pseudonombres, las mejoras en el rendimiento alcanzaron el 21 por ciento.

A medida que aumenta el tamaño del maniquí, su técnica conduce a mayores ganancias de rendimiento.

En el futuro, los investigadores quieren estudiar las posibles razones por las que los VLM no heredan capacidades de estudios en contexto de sus LLM básicos. Por otra parte, planean explorar mecanismos adicionales para mejorar el rendimiento de un VLM sin falta de retornar a entrenarlo con nuevos datos.

«Este trabajo replantea la lugar personalizada de objetos en pocas tomas (acomodo sobre la marcha al mismo objeto en nuevas escenas) como un problema de ajuste de instrucciones y utiliza secuencias de seguimiento de video para enseñar a los VLM a delimitar basándose en el contexto visual en motivo de en los circunstancias de la clase. Además presenta el primer punto de remisión para esta configuración con ganancias sólidas en los VLM abiertos y propietarios. Dada la inmensa importancia de una conexión a tierra rápida y específica de cada instancia, a menudo sin ajustes, para los usuarios de flujos de trabajo del mundo auténtico (como robótica, asistentes de efectividad aumentada, herramientas creativas, etc.), la fórmula habilidad centrada en datos que ofrece este trabajo puede ayudar a mejorar la prohijamiento generalizada de modelos básicos de visión y habla”, dice Saurav Jha, postdoctorado en el Instituto de Inteligencia Industrial de Mila-Québec, que no participó en este trabajo.

Los coautores adicionales son Wei Lin, investigador asociado de la Universidad Johannes Kepler; Eli Schwartz, verificado investigador de IBM Research; Hilde Kuehne, profesora de informática en el Centro de IA de Tuebingen y profesora asociada del Laboratorio de IA Watson del MIT-IBM; Grieta Giryes, profesor asociado de la Universidad de Tel Aviv; Rogerio Feris, verificado principal y director del Laboratorio de IA Watson del MIT-IBM; Leonid Karlinsky, investigador principal de IBM Research; Assaf Arbelle, verificado investigador senior de IBM Research; y Shimon Ullman, profesor Samy y Ruth Cohn de Ciencias de la Computación en el Instituto Weizmann de Ciencias.

Esta investigación fue financiada, en parte, por el MIT-IBM Watson AI Lab.