5 técnicas prácticas para detectar y mitigar las alucinaciones LLM más allá de la ingeniería inmediata

5 técnicas prácticas para detectar y mitigar las alucinaciones de LLM más allá de la ingeniería rápida – MachineLearningMastery.com 5 técnicas prácticas para detectar y mitigar las alucinaciones de LLM más allá de la ingeniería rápida – MachineLearningMastery.com

Investigadores de Tsinghua y Ant Group presentan un situación de seguridad de cinco capas orientado al ciclo de vida para mitigar las vulnerabilidades de los agentes LLM autónomos en OpenClaw

Los agentes autónomos de LLM como OpenClaw están cambiando el pauta de asistentes pasivos a entidades proactivas capaces de ejecutar tareas complejas y de extenso plazo a través del llegada al sistema con altos privilegios. Sin confiscación, un mensaje de investigación de investigación de seguridad de La Universidad de Tsinghua y Ant Group revelan que […]

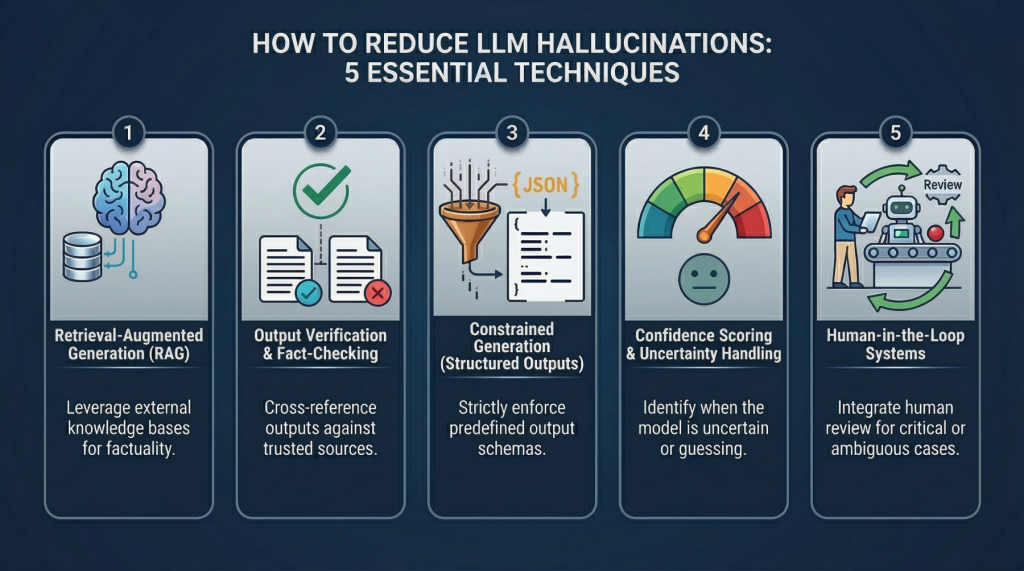

7 trucos de ingeniería rápidos para mitigar las alucinaciones en los LLM

7 trucos de ingeniería rápidos para mitigar las alucinaciones en los LLM Comienzo Grandes modelos de idioma (LLM) exhiben habilidades sobresalientes para razonar, resumir y gestar texto de forma creativa. Aún así, siguen siendo susceptibles al problema global de alucinacionesque consiste en gestar información aparentemente segura pero falsa, no verificable o, a veces, incluso sin […]