Los datos empresariales rara vez son aperos en un silo. Replicar preguntas como: «¿Cuáles de nuestros productos han tenido una disminución en las ventas durante los últimos tres meses y qué problemas potencialmente relacionados surgen en las reseñas de los clientes en varios sitios de vendedores?» requiere razonamiento a través de una combinación de fuentes de datos estructurados y no estructurados, incluidos lagos de datos, datos de revisión y sistemas de mandato de información de productos. En este blog, demostramos cómo Agente de Databricks Agente supervisor de Bricks (SA) puede ayudar con estas tareas complejas y realistas mediante un razonamiento de varios pasos basado en un híbrido de datos estructurados y no estructurados.

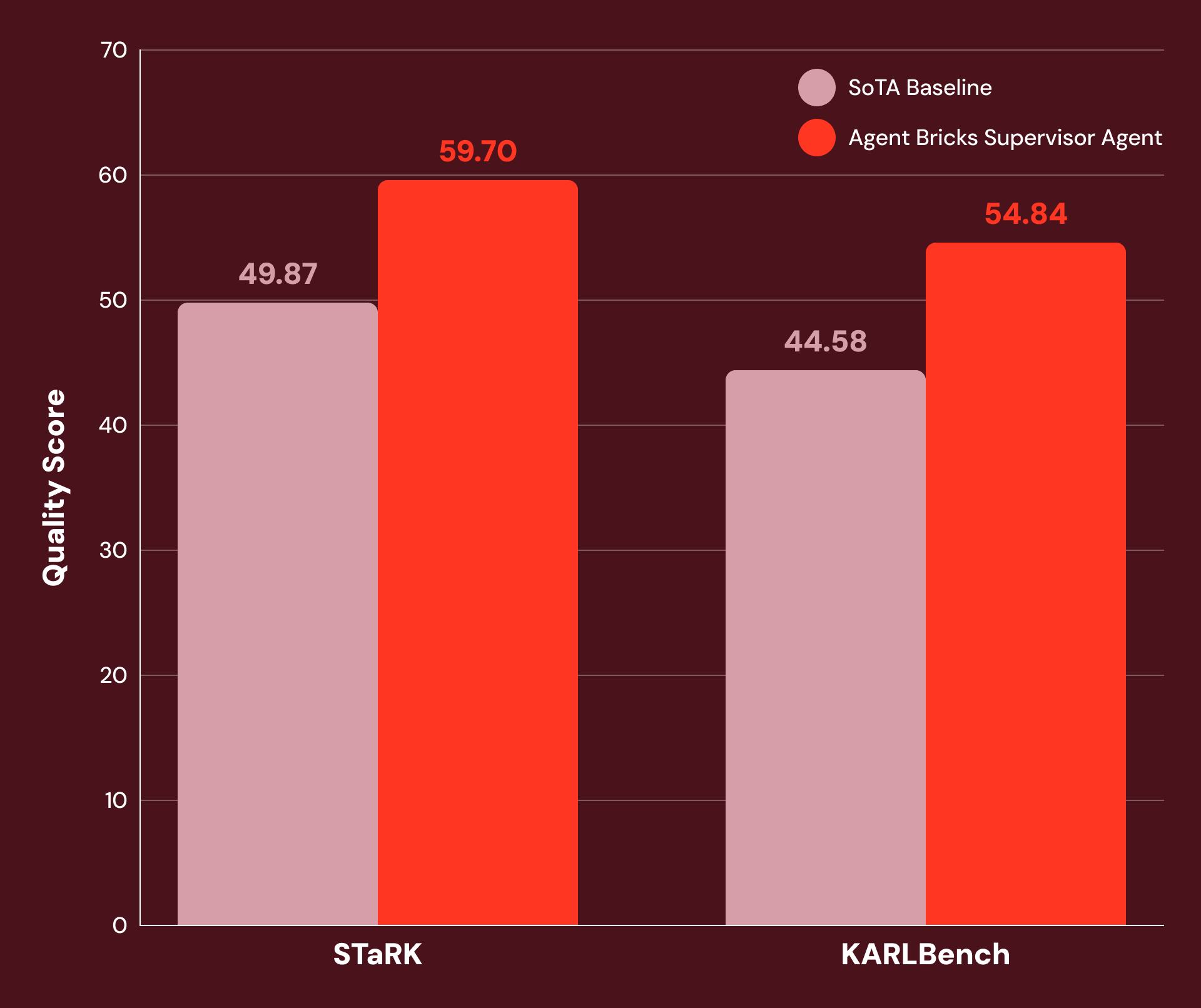

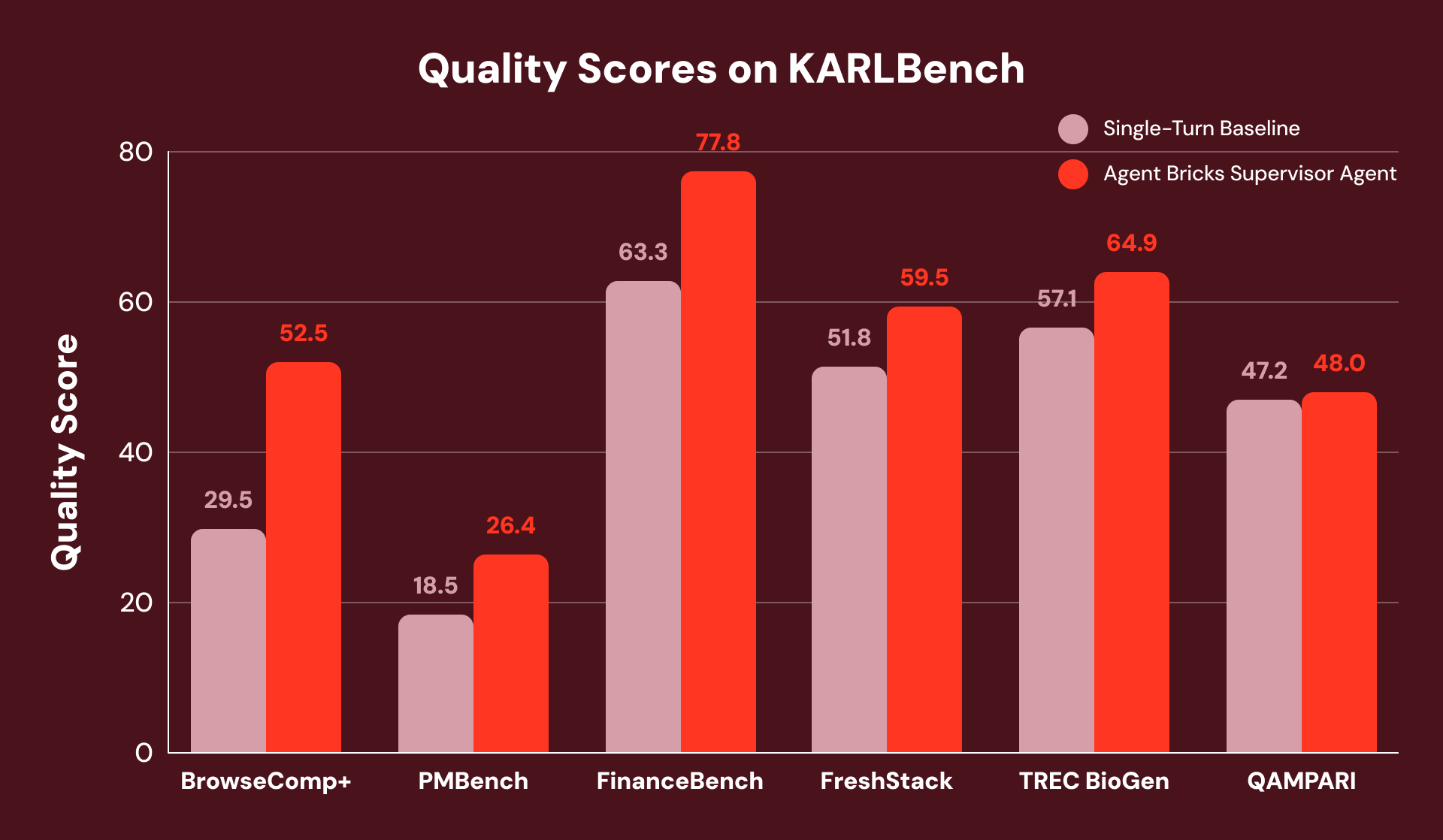

Con instrucciones ajustadas y una configuración cuidadosa de las herramientas, consideramos que SA tiene un detención rendimiento en una amplia escala de tareas empresariales que requieren un uso intensivo de conocimiento. La Figura 1 muestra que SA logra una progreso del 20 % o más con respecto a las líneas de colchoneta de SoTA en:

- Rígido: un conjunto de tres tareas de recuperación semiestructuradas publicadas por investigadores de Stanford.

- KARLBanco: un conjunto de relato para razonamiento fundamentado complicado publicado recientemente por Databricks.

El agente supervisor demuestra ganancias significativas en una amplia escala de tareas económicamente valiosas: desde recuperación académica (+21 % en STaRK-MAG) hasta razonamiento biomédico (+38 % en STaRK Prime) y investigación financiero (+23 % en FinanceBench).

Configuración del agente

Agent Bricks Supervisor Agent es un creador de agentes declarativos que organiza agentes y herramientas. esta construido sobre arollar – un situación de agencia interno para crear, evaluar e implementar flujos de trabajo de LLM de varios pasos a escalera.1 arollar y SA fueron diseñados específicamente para los casos de uso de agentes avanzados que nuestros clientes encuentran con frecuencia.

arollar permite asociar nuevas herramientas e instrucciones personalizadas a través de simples cambios de configuración, puede manejar miles de conversaciones simultáneas y ejecuciones de herramientas paralelas e incorpora técnicas avanzadas de orquestación de agentes y mandato de contexto para refinar consultas y recuperarse de respuestas parciales. Todo esto es difícil de conquistar con los sistemas de una sola dorso de SoTA en la presente.

Adecuado a que SA se cimiento en esta construcción flexible, su calidad se puede mejorar continuamente a través de una simple selección por parte del heredero, como ajustar las instrucciones de nivel superior o refinar las descripciones de los agentes, sin condición de escribir ningún código personalizado.

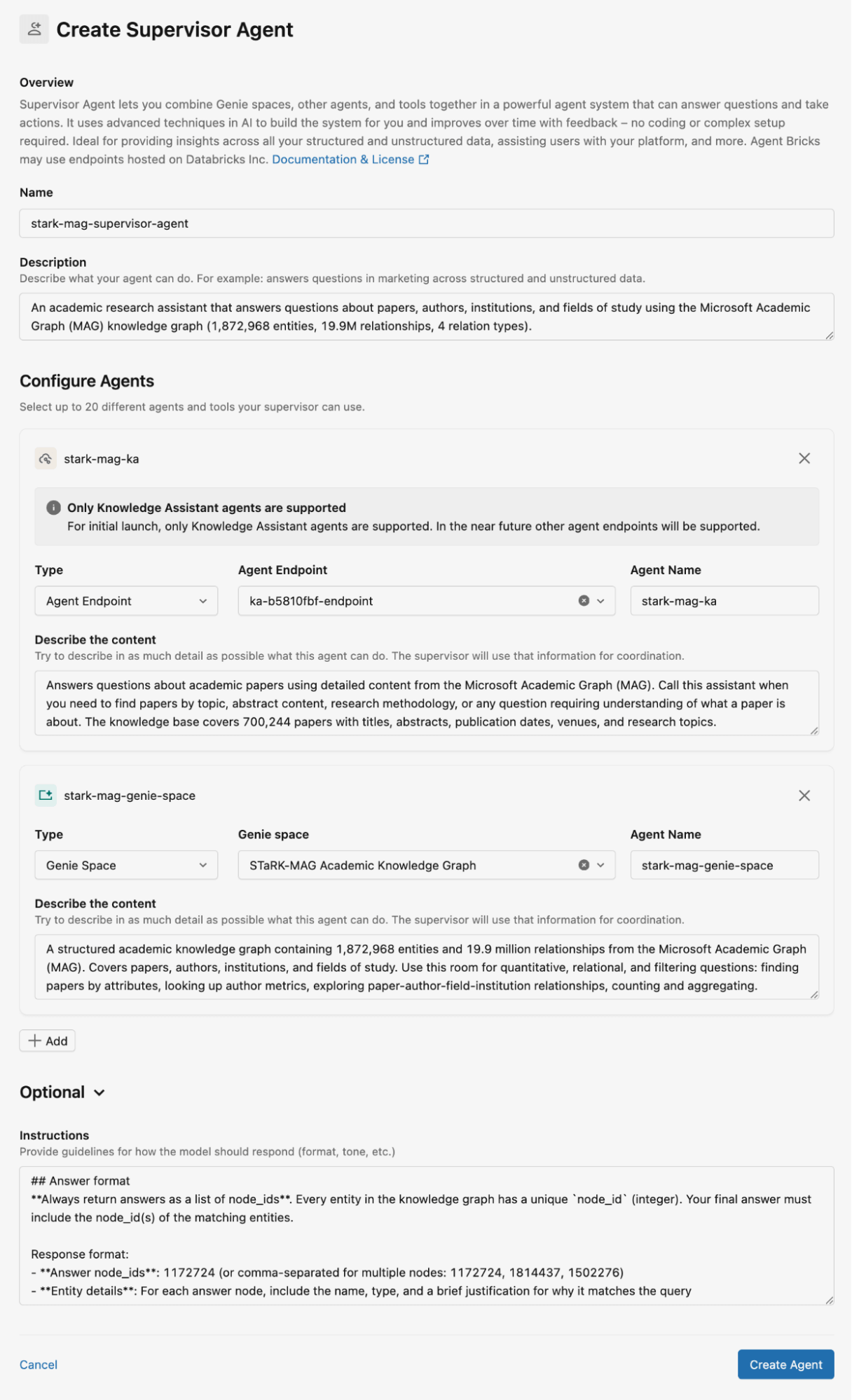

La Figura 2 muestra cómo configuramos el Agente Supervisor para el conjunto de datos STaRK-MAG. En este blog, utilizamos espacios Genie para juntar las bases de conocimiento relacionales y Knowledge Assistants para juntar documentos no estructurados para su recuperación. Proporcionamos descripciones detalladas de todos los espacios Knowledge Assistants y Genie, así como instrucciones para las respuestas de los agentes.

Razonamiento híbrido: lo estructurado se encuentra con lo no estructurado

Para evaluar el razonamiento fundamentado basado en un híbrido de datos estructurados y no estructurados, utilizamos el punto de relato STaRK, que incluye tres dominios:

- Amazon: atributos de producto (estructurados) y reseñas (no estructuradas)

- MAG: redes de citas (estructuradas) y artículos académicos (no estructurados)

- Prime: entidades biomédicas (estructuradas) y letras (no estructuradas)

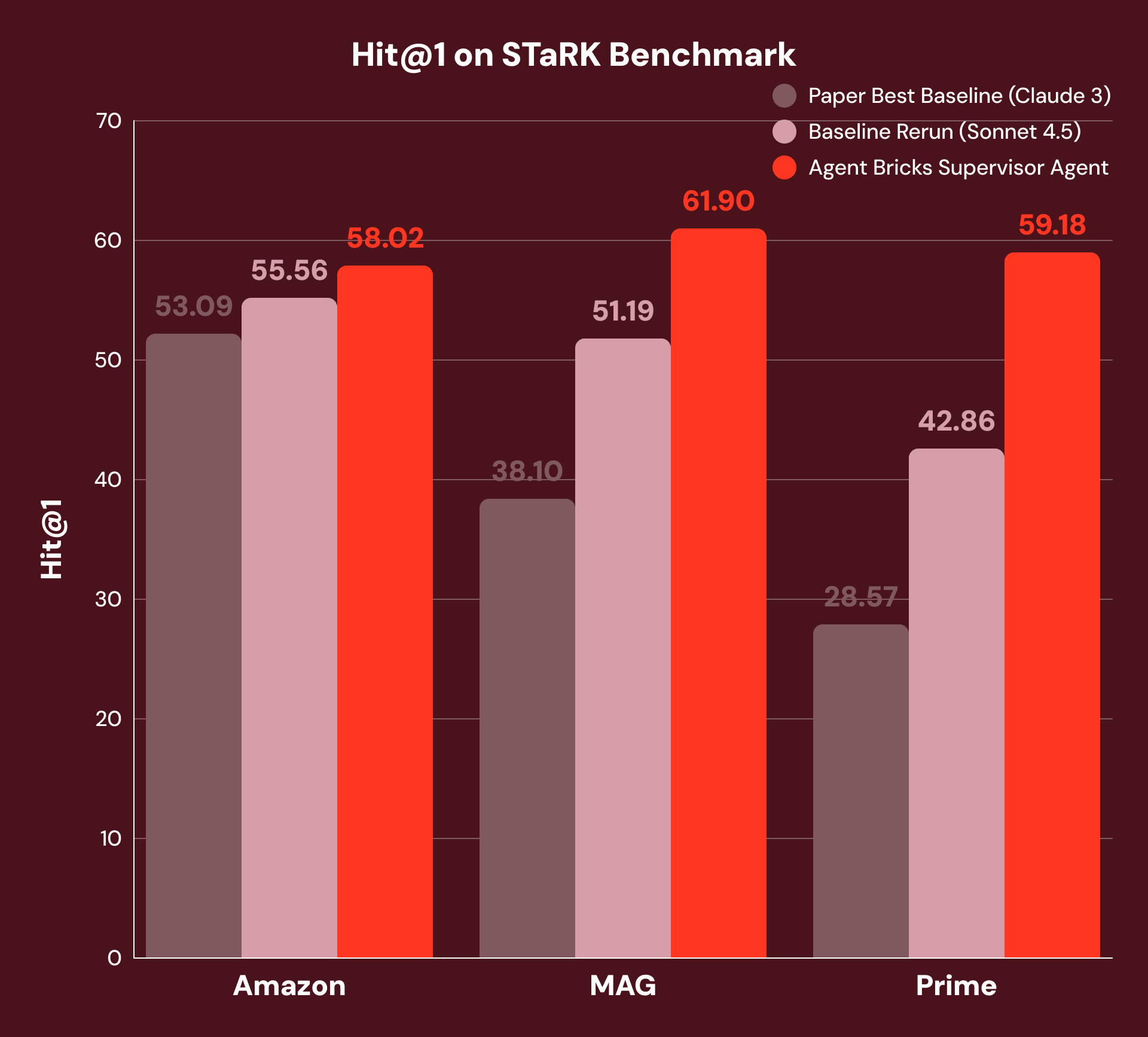

Por ejemplo, «Búsqueme un artículo escrito por un coautor con 115 artículos y que trate sobre el átomo de Rydberg» requiere que el sistema combine el filtrado estructurado («coautor con 115 artículos») con comprensión no estructurada («sobre el átomo de Rydberg»). El mejores líneas de colchoneta publicadas utilice la búsqueda de similitud de vectores con un reclasificador basado en LLM: un enfoque sólido de un solo turno, pero que no puede descomponer las consultas entre tipos de datos. Para asegurar una comparación reto, volvimos a ejecutar esta radio de colchoneta con el maniquí fundamental flagrante de SoTA, proporcionando una radio de colchoneta sustancialmente más sólida.

Con nuestro enfoque, SA descompone cada pregunta, dirige las subpreguntas a la aparejo adecuada y sintetiza los resultados en múltiples pasos de razonamiento. Como muestra la Figura 3, esto logra un +4 % de Hit@1 en Amazon, un +21 % en MAG y un +38 % en Prime sobre las mejores líneas de colchoneta originales y nuestras líneas de colchoneta repetidas con el maniquí fundamental flagrante de SoTA. Vemos las mejores mejoras en MAG y Prime, donde la respuesta requiere la integración más estrecha de datos estructurados y no estructurados.

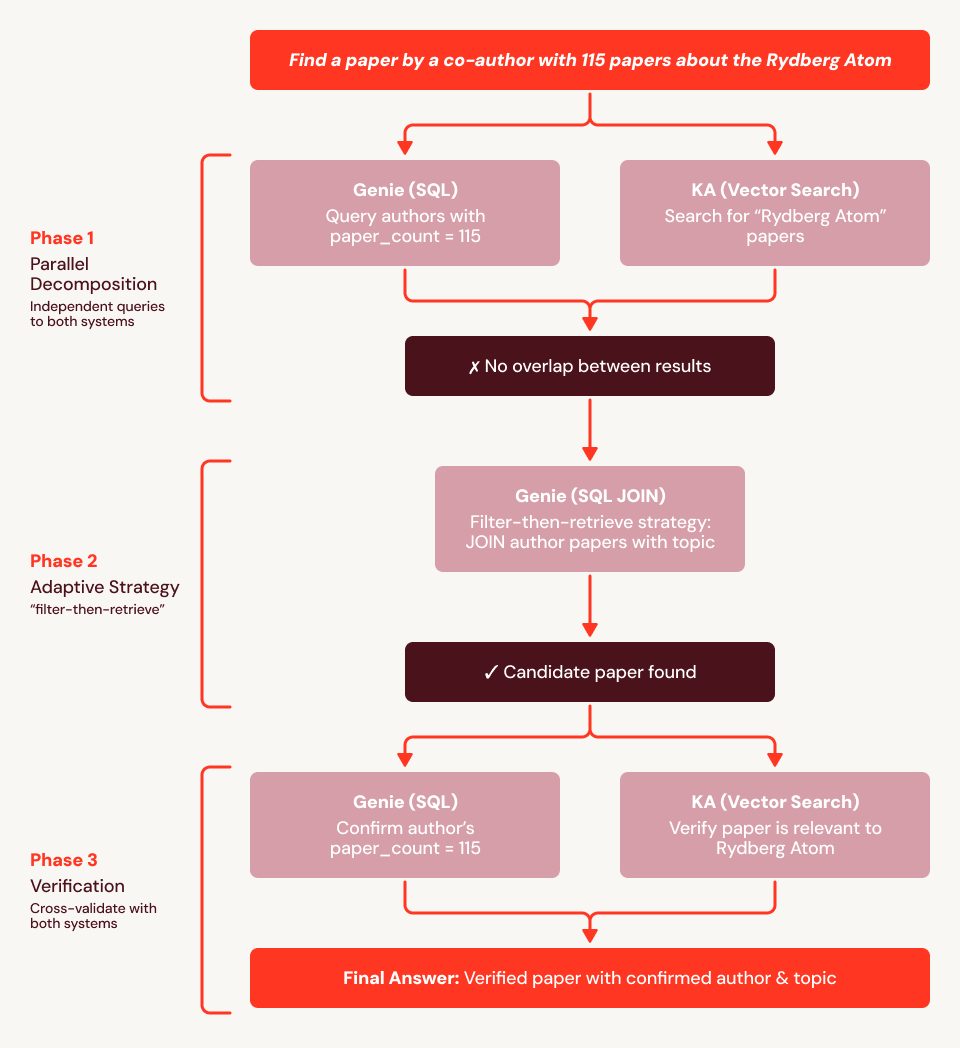

Utilizando nuestra pregunta de ejemplo preparatorio (“Búsqueme un artículo escrito por un coautor con 115 artículos y que trate sobre el átomo de Rydberg”), encontramos que la radio de colchoneta error porque las incorporaciones no pueden codificar la restricción estructural (“el coautor tiene exactamente 115 artículos”). En la Figura 4, mostramos un seguimiento de ejecución para SA: primero utiliza Genie para encontrar los 759 autores con 115 artículos y Knowledge Assistant para recuperar los artículos de Rydberg, luego cruza las referencias de los dos conjuntos. Cuando no se encuentra ninguna superposición, SA se adapta: emite un SQL JOIN de la índice de autores de 115 artículos contra todos los artículos que mencionan «Rydberg» en el título o breviario, mostrando la respuesta directamente a partir de los datos estructurados. Luego fogata a Knowledge Assistant para repasar la relevancia y a Genie para confirmar el recuento de artículos del autor y devuelve exitosamente el papel correcto.

La superioridad de los agentes en tareas intensivas en conocimiento

Para comparar el rendimiento de Agent Bricks SA con una sólida radio de colchoneta de un solo turno (similar a la mejor radio de colchoneta publicada para STaRK) donde no se requieren datos estructurados, los evaluamos utilizando KARLBancoun conjunto de pruebas comparativas de razonamiento fundamentado que en conjunto pone a prueba diferentes capacidades de recuperación y razonamiento:

- NavegarComp+: búsqueda de entidades de proceso de asesinato

- TREC BioGen: síntesis de letras biomédica

- FinanzasBanco: razonamiento aritmético sobre declaraciones financieras

- QAMPARI: recuperación exhaustiva de entidades

- pila fresca: alternativa de problemas técnicos sobre documentación

- PMBench: comprensión de documentos empresariales internos de Databricks

En militar, el Agente Supervisor logra ganancias consistentes en los seis puntos de relato, con las mayores mejoras en tareas que exigen un investigación profundo o autocorrección. En FinanceBench, se recupera de una recuperación inicialmente incompleta al detectar lagunas y reformular consultas, lo que arroja una progreso militar del +23 %.

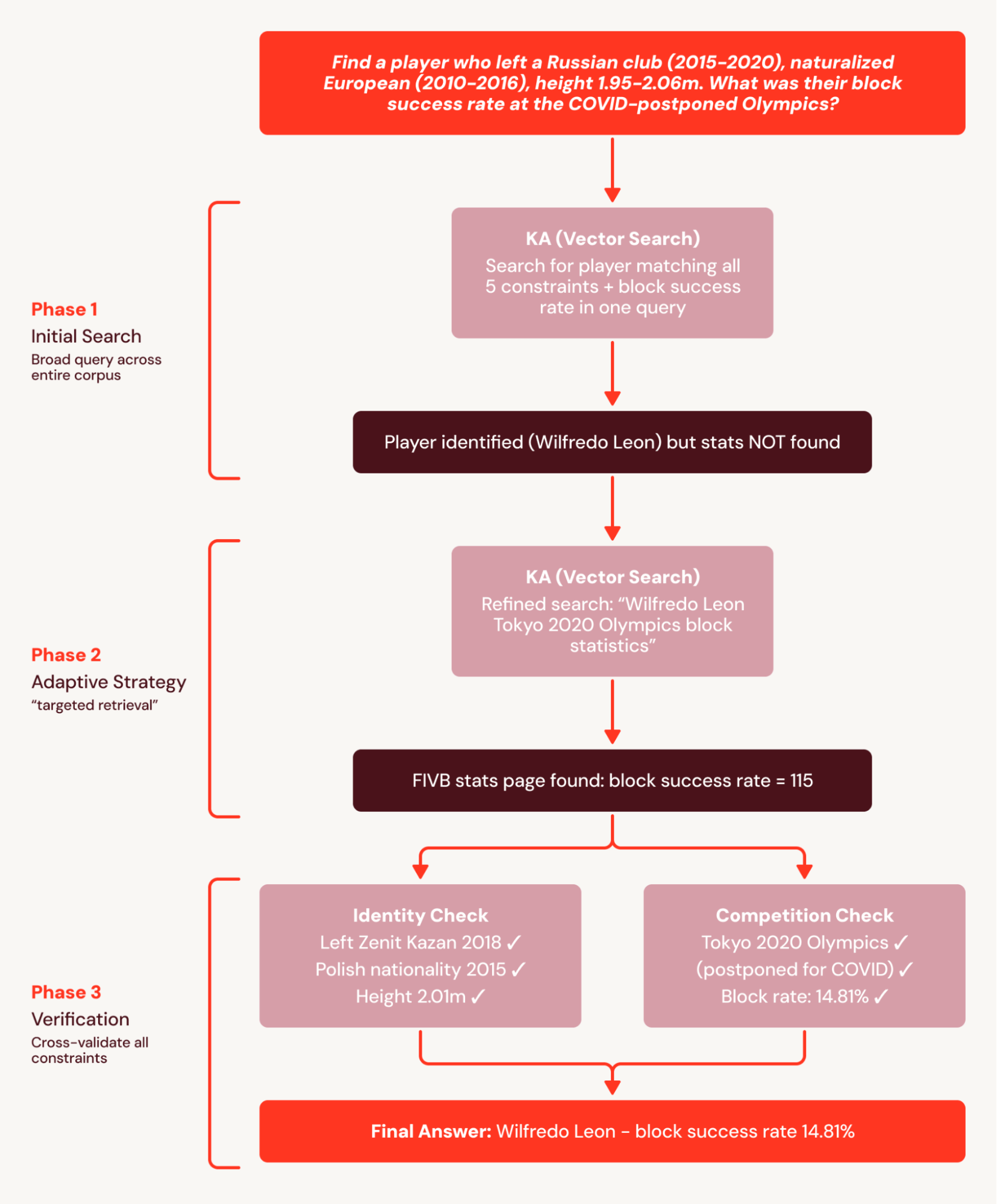

Por ejemplo, cada una de las preguntas de BrowseComp+ tiene entre 5 y 10 restricciones entrelazadas, como «Encontrar un componente que dejó un club ruso (2015-2020), naturalizado europeo (2010-2016), cumbre entre 1,95 y 2,06 m. ¿Cuál fue su tasa de éxito en bloqueos en los Juegos Olímpicos pospuestos por COVID?» La radio de colchoneta de un solo turno emite una consulta amplia que identifica correctamente al componente, pero no logra mostrar documentos estadísticos granulares y no replica la pregunta.

SA divide esta tarea en un plan de búsqueda coordinado y descompone el plan en subconjuntos de búsqueda. Esto evita el error de relato de un solo turno en el que no se encuentran las estadísticas porque se recuperan en una búsqueda posterior. Como resultado, SA logra una progreso relativa del +78%.

En otro ejemplo de PMBench, una de las preguntas es «¿cuáles son los tipos de barandillas que usan los clientes?», lo que requiere 26 pepitas (consulte la definición en KARL referencia) en más de 10 documentos de conversaciones con clientes para obtener una respuesta exhaustiva. La radio de colchoneta de un solo turno encuentra solo una mención de cliente porque no puede agenciárselas en todas las categorías de barandillas en una sola pregunta. SA exploración cada categoría de barrera de seguridad por separado (“detección de PII”, “sueño”, “toxicidad”, “inyección rápida”) y, de forma incremental, muestra más y más menciones de clientes en el proceso.

Lo que aprendimos

Los resultados de nuestros experimentos apuntan a algunas conclusiones esencia:

- Los agentes de razonamiento fundamentado pueden beneficiarse de un híbrido de recuperación de datos estructurados y no estructurados si se les da comunicación a las herramientas y representaciones de datos adecuadas.

- Para escenarios de recuperación de adhesión calidad, se debe evitar la creación de canalizaciones RAG personalizadas sobre conjuntos de datos heterogéneos, incluso si se utilizan modelos SoTA para la etapa de reclasificación. El razonamiento de varios pasos en el que, en cada paso, el agente selecciona la fuente de datos adecuada y reflexiona sobre su utilidad, es crucial para mejorar el rendimiento.

- Un enfoque declarativo para la creación de agentes, como el implementado por el Agente supervisor de Databricks, proporciona un buen contrapeso entre facilidad de uso y calidad.

Usamos el Agente supervisor de Databricks para crear agentes para los tres dominios STaRK y seis conjuntos de datos no estructurados en KARLBench. Lo único que difiere entre estas nueve tareas son las instrucciones y herramientas: no se requirió ningún código personalizado para procesar estos diversos conjuntos de datos. Por lo tanto, crear un agente eficaz para una nueva tarea empresarial es en gran medida una cuestión de escribir instrucciones precisas y equiparlo con las herramientas adecuadas, en oficio de crear un nuevo sistema desde cero.

El agente supervisor de Bricks es adecuado para todos nuestros clientes. Puede comenzar con Agent Bricks SA simplemente creando un agente y conectándolo a sus agentes, herramientas y servidores MCP existentes. Explora el documentación para ver cómo se adapta Supervisor Agent a sus flujos de trabajo de producción.

Autores: Xinglin Zhao, Arnav Singhvi, Mark Rizkallah, Jonathan Li, Jacob Portes, Elise Gonzales, Sabhya Chhabria, Kevin Wang, Yu Batintín, Moonsoo Lee, Michael Bendersky y Matei Zaharia.

1Consulte nuestra publicación nuevo “KARL: Agentes de conocimiento a través del enseñanza por refuerzo” para obtener más detalles sobre cómo se utiliza aroll para la procreación de datos sintéticos, el entrenamiento de RL escalable y la inferencia en radio para tareas de agencia.