Servicio de búsqueda abierta de Amazon impulsa los flujos de trabajo de observabilidad para las organizaciones, brindando a sus equipos de ingeniería de confiabilidad del sitio (SRE) y DevOps un único panel para juntar y analizar datos de telemetría. Durante los incidentes, correlacionar señales e identificar las causas fundamentales exige una gran experiencia en exploración de registros y horas de trabajo manual. La identificación de la causa raíz sigue siendo en gran medida manual. Para muchos equipos, este es el cuello de botella que retrasa la recuperación del servicio y ignición los fortuna de ingeniería.

Recientemente mostramos cómo construir un agente de observabilidad usando Servicio de búsqueda abierta de Amazon y Roca Amazónica para sujetar el tiempo medio de resolución (MTTR). Ahora, Amazon OpenSearch Service trae muchas de estas funciones al Interfaz de agraciado de búsqueda abierta—no se requiere infraestructura adicional. Se ofrecen tres nuevas funciones de IA agente para optimizar y acelerar el MTTR:

- Un Chatbot agente que puede ceder al contexto y a los datos subyacentes que está viendo, aplicar razonamiento agente y utilizar herramientas para consultar datos y crear conocimientos en su nombre.

- Un Agente de investigación que profundiza en los datos de señales con exploración basado en hipótesis, explicando su razonamiento en cada paso.

- Un Memoria agente que admite uno y otro agentes, por lo que su precisión y velocidad mejoran cuanto más los usas.

En esta publicación, mostramos cómo estas capacidades funcionan juntas para ayudar a los ingenieros a ocurrir de la alerta a la causa raíz en minutos. Incluso analizamos un círculo de muestra en el que el agente de investigación correlaciona automáticamente datos en múltiples índices para crear una hipótesis de causa raíz.

Cómo funcionan juntas las capacidades agentes de IA

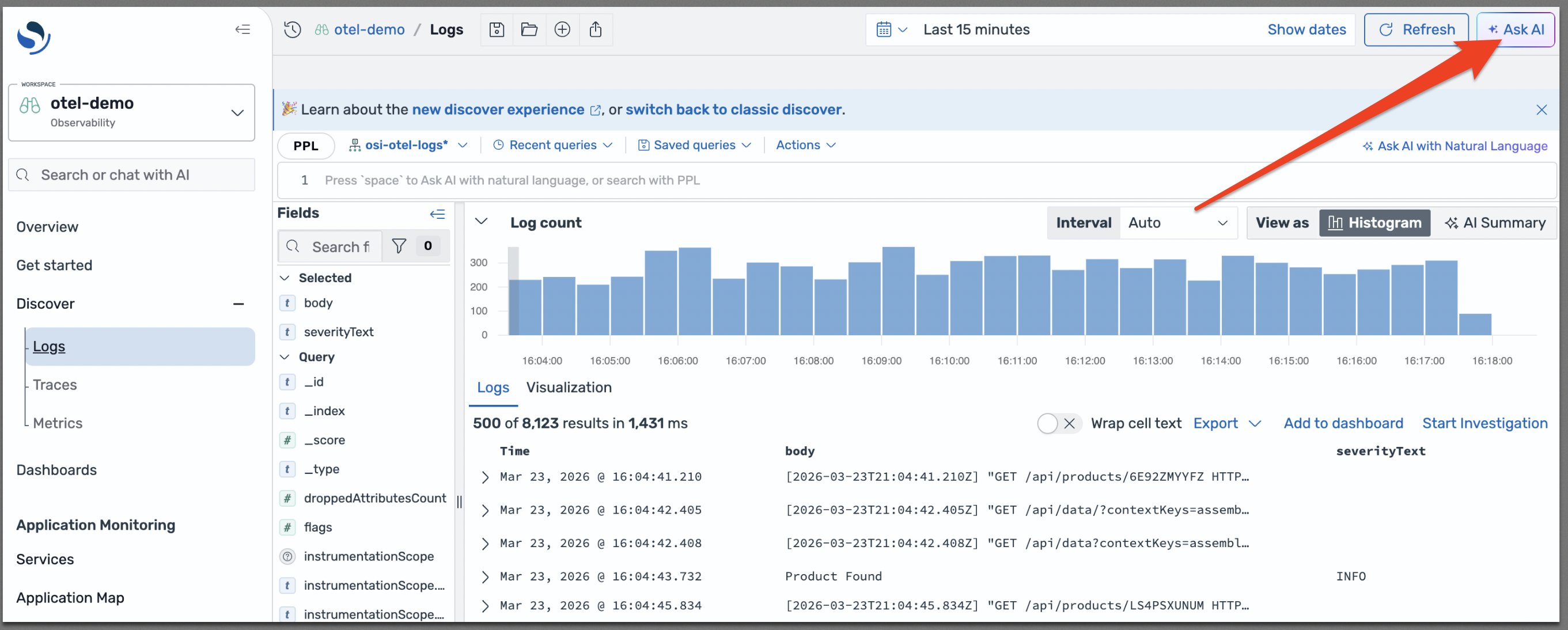

Estas capacidades de IA son accesibles desde Interfaz de agraciado de búsqueda abierta a través de un Pregúntale a la IA pimpollo, como se muestra en el ulterior diagrama, que proporciona un punto de entrada para el Chatbot agente.

Chatbot agente

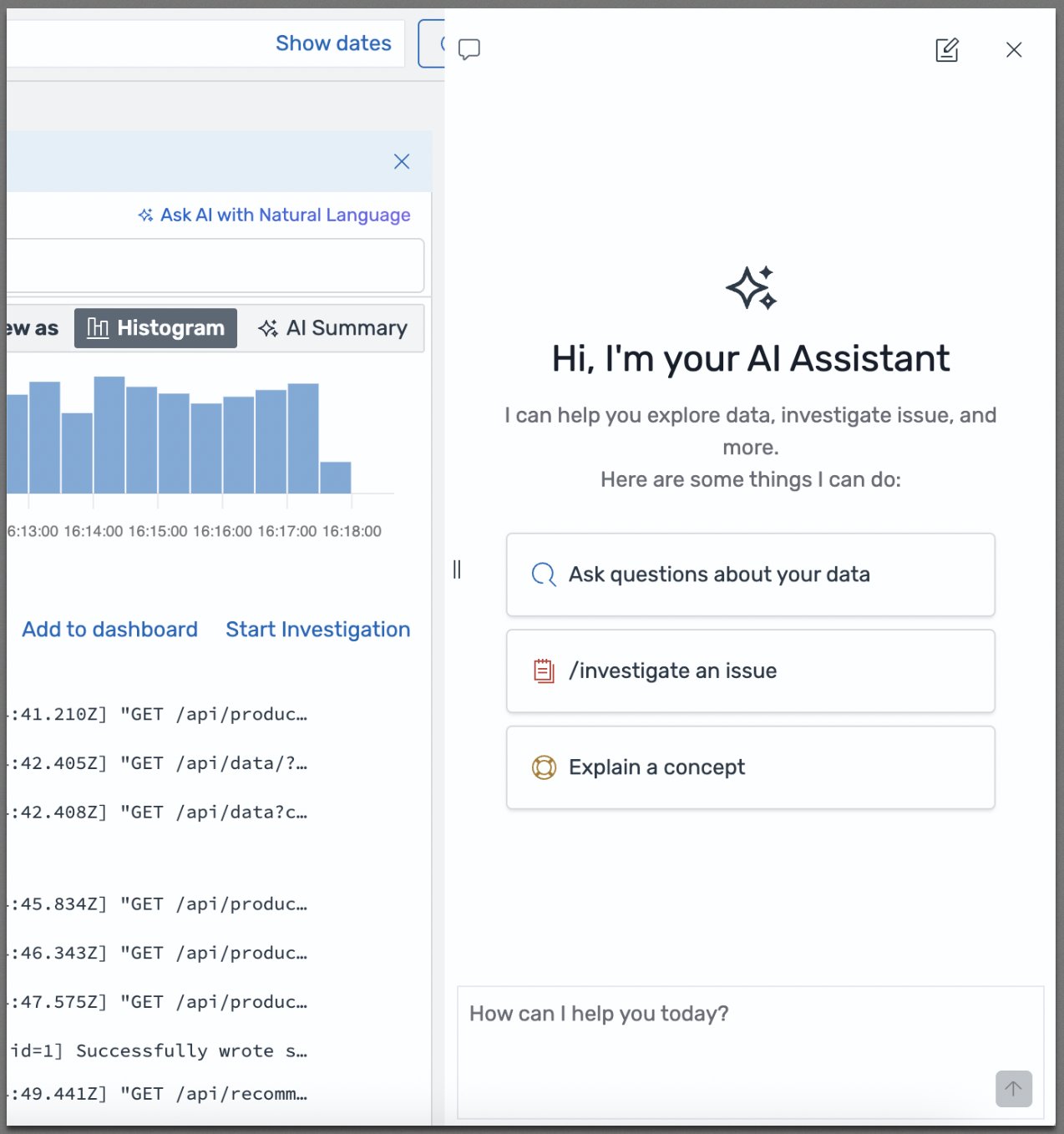

Para inaugurar la interfaz del chatbot, elija Preguntar a AI.

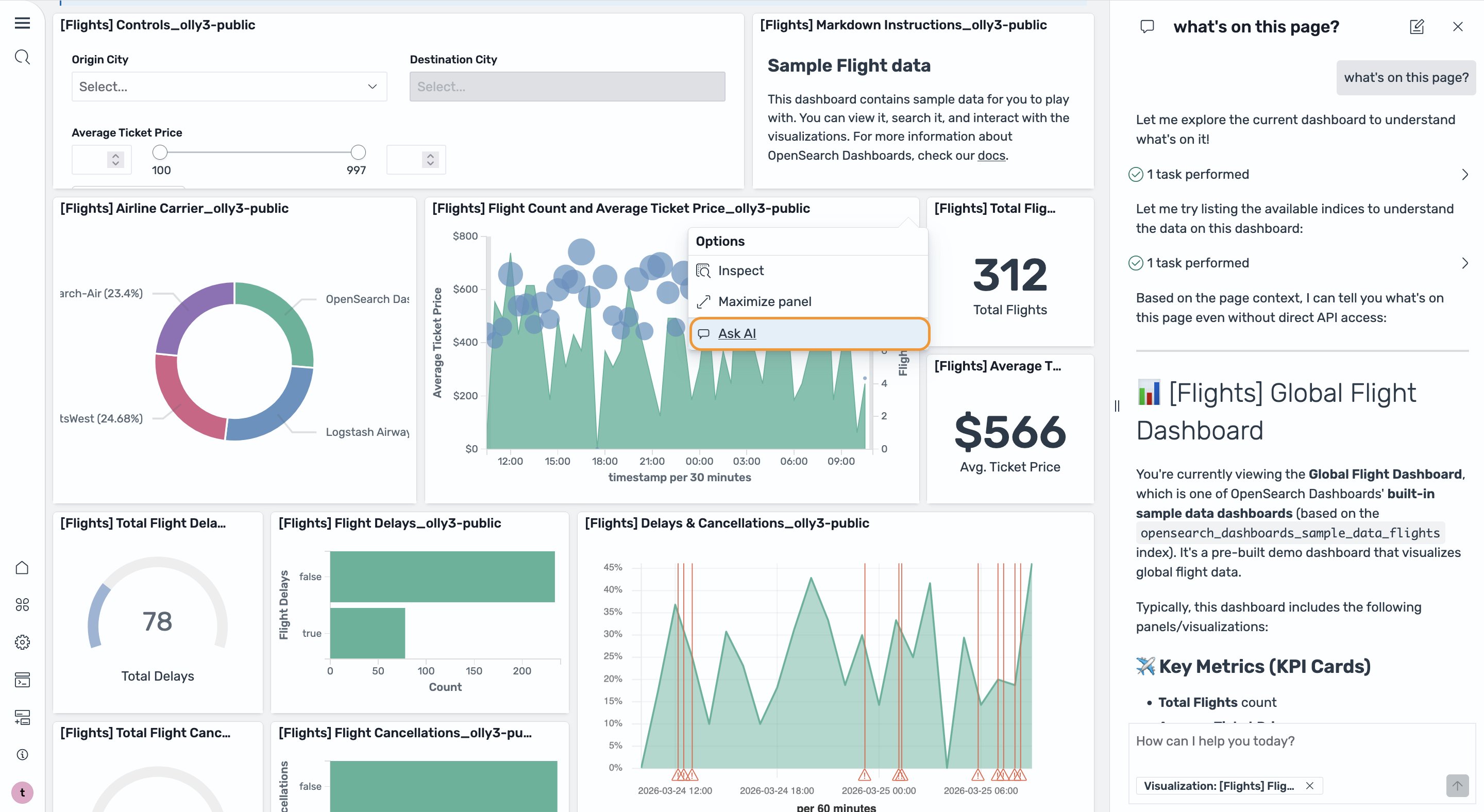

El chatbot comprende el contexto de la página presente, por lo que comprende lo que estás viendo ayer de hacer una pregunta. Puedes hacer preguntas sobre tus datos, iniciar una investigación o pedirle al chatbot que te explique un concepto. Una vez que comprende su solicitud, el chatbot planifica y utiliza herramientas para ceder a los datos, incluida la concepción y ejecución de consultas en la página Descubrir, y aplica el razonamiento para producir una respuesta basada en datos. Incluso puede utilizar el chatbot en la página del Panel, iniciando conversaciones desde una visualización particular para obtener un sinopsis como se muestra en la ulterior imagen.

agente de investigación

Muchos incidentes son demasiado complejos para resolverlos con una o dos consultas. Ahora puede obtener la ayuda del agente de investigación para manejar estas situaciones complejas. El agente de investigación utiliza el agente plan-ejecutar-reflejarque está diseñado para resolver tareas complejas que requieren razonamiento iterativo y ejecución paso a paso. Utiliza un Large Language Model (LLM) como planificador y otro LLM como ejecutor. Cuando un ingeniero identifica una observación sospechosa, como un aumento en la tasa de error o una anomalía de latencia, puede pedirle al agente de investigación que investigue. Uno de los pasos importantes que realiza el agente de investigación es la reevaluación. El agente, luego de ejecutar cada paso, reevalúa el plan utilizando el planificador y los resultados intermedios. El planificador puede ajustar el plan si es necesario, comerse un paso o juntar pasos dinámicamente en función de esta nueva información. Utilizando el planificador, el agente genera un noticia de exploración de causa raíz liderado por las hipótesis y recomendaciones más probables, con seguimientos completos del agente que muestran cada paso del razonamiento, todos los hallazgos y cómo respaldan las hipótesis finales. Puede proporcionar comentarios, juntar sus propios hallazgos, repetir el objetivo de la investigación y revisar y validar cada paso del razonamiento del agente. Este enfoque refleja cómo trabajan los respondedores de incidentes experimentados, pero se completa automáticamente en minutos. Incluso puede utilizar el comando de mostrador diagonal “/investigar” para iniciar una investigación directamente desde el chatbot, basándose en una conversación en curso o comenzando con un objetivo de investigación diferente.

Agente en actividad

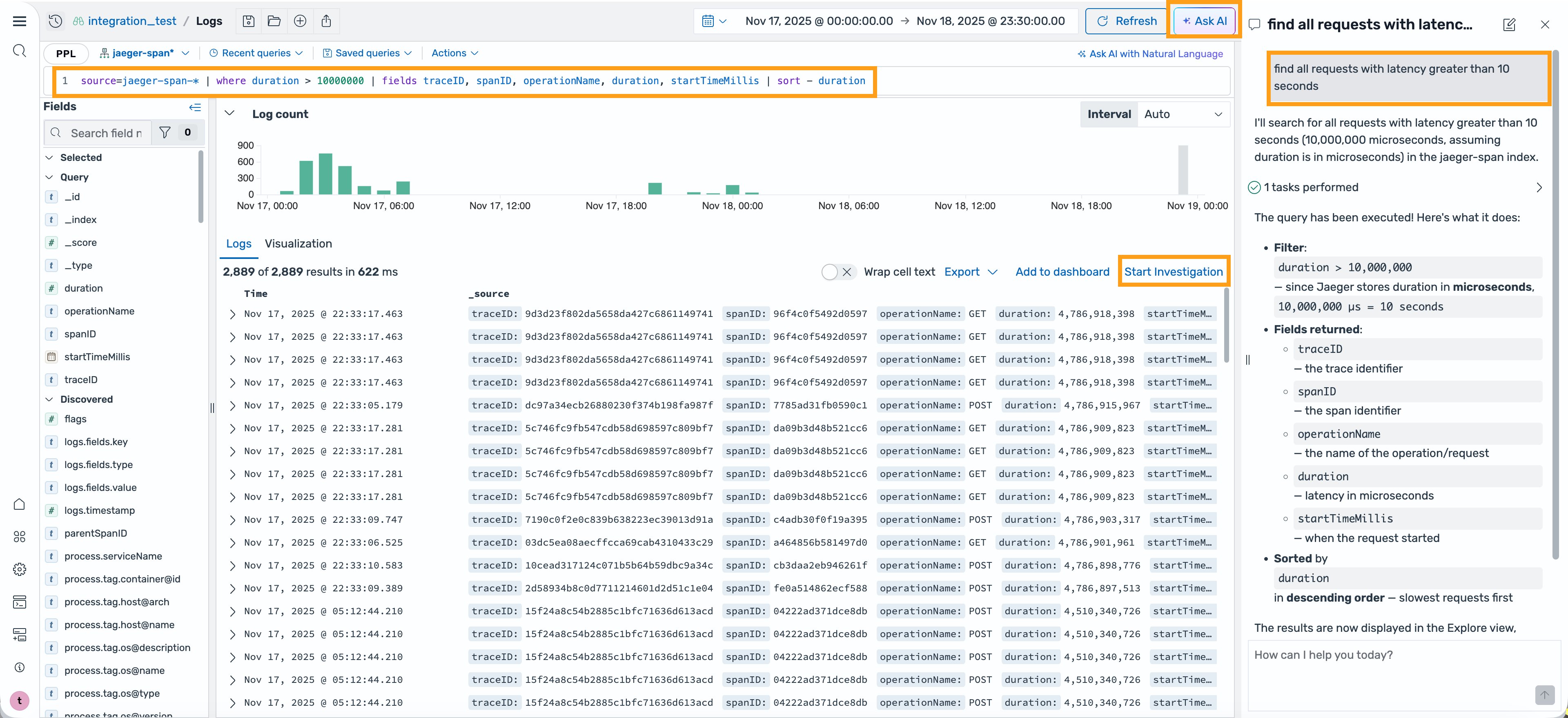

Procreación cibernética de consultas

Considere una situación en la que es ingeniero de SRE o DevOps y recibe una alerta de que un servicio secreto está experimentando una latencia elevada. Inicia sesión en la interfaz de agraciado de OpenSearch, navega a la página Descubrir y selecciona el pimpollo Preguntar a AI. Sin ninguna experiencia en el idioma de consulta Piped Processing Language (PPL), ingresa la pregunta «averiguar todas las solicitudes con latencia superior a 10 segundos». El chatbot comprende el contexto y los datos que está viendo, analiza la solicitud, genera el comando PPL correcto y lo actualiza en la mostrador de consulta para brindarle los resultados. Y si la consulta presenta algún error, el chatbot puede conocer el error, autocorregirlo e iterar la consulta para obtener los resultados.

Investigación y encargo de investigaciones.

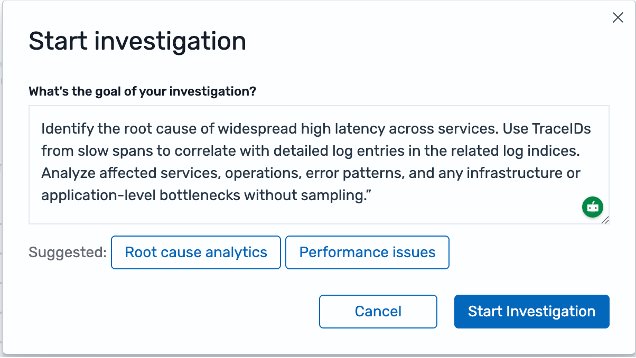

Para incidentes complejos que normalmente requieren analizar y correlacionar manualmente varios registros para la posible causa raíz, puede nominar Iniciar investigación para iniciar la investigación agente. Puede proporcionar un objetivo para la investigación, próximo con cualquier contexto o hipótesis que desee instruir en la investigación. Por ejemplo, «identifique la causa raíz de la reincorporación latencia generalizada en todos los servicios. Utilice TraceID de tramos lentos para correlacionarlos con entradas de registro detalladas en los índices de registro relacionados. Analice los servicios afectados, las operaciones, los patrones de error y cualquier cuello de botella a nivel de infraestructura o aplicación sin muestreo».”.

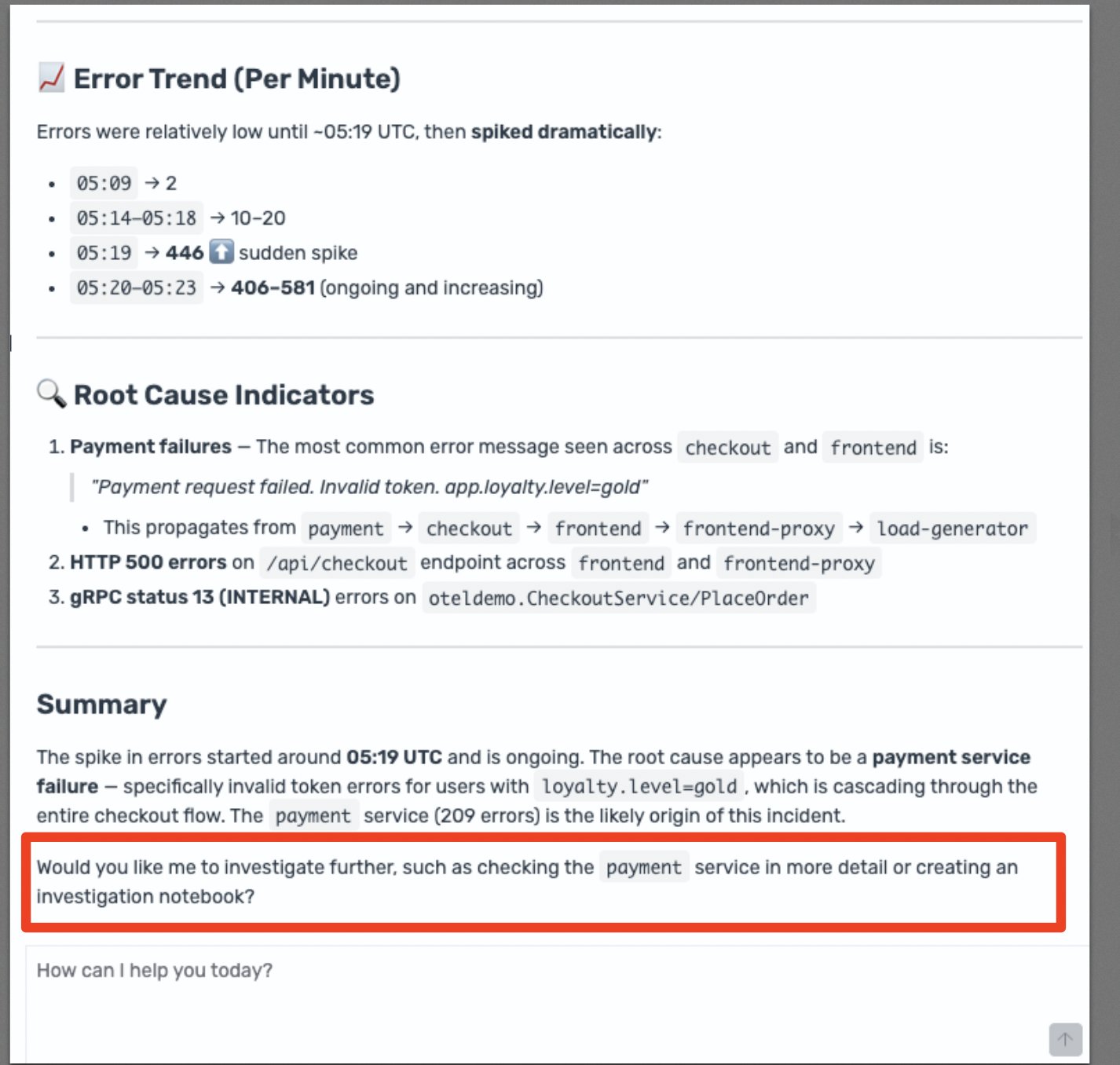

El agente, como parte de la conversación, se ofrecerá a investigar cualquier problema que esté intentando depurar.

El agente establece objetivos para sí mismo próximo con cualquier otra información relevante como índices, rango de tiempo asociado y otros, y solicita su confirmación ayer de crear un Computadora portátil para esta investigación. Un Notebook es una forma en el interior de la interfaz de agraciado de OpenSearch de desarrollar un noticia enriquecido que sea en vivo y colaborativo. Esto ayuda con la encargo de la investigación y permite una nueva investigación en una término posterior si es necesario.

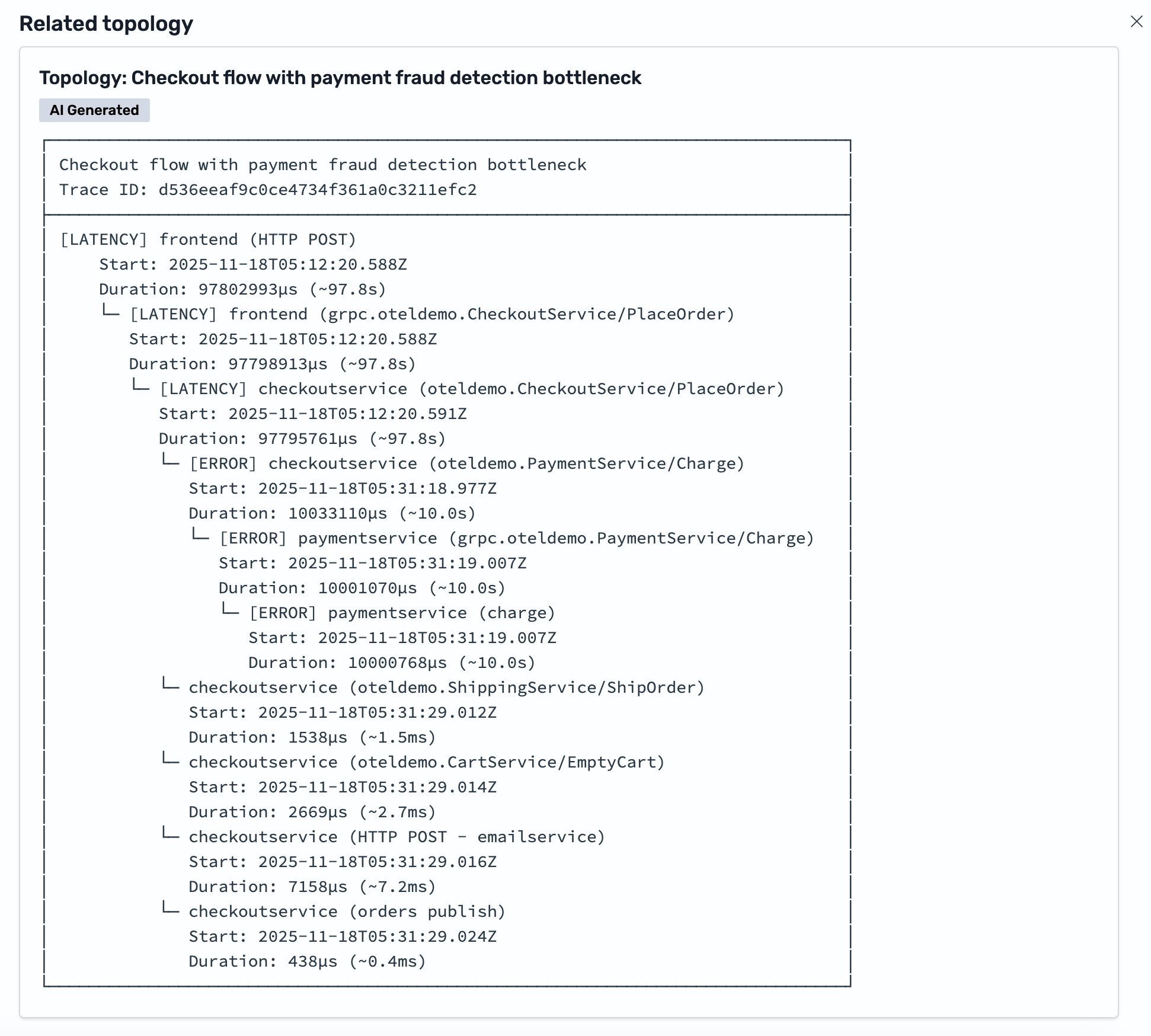

Una vez que comience la investigación, el agente realizará un exploración rápido mediante la secuencia de registros y la distribución de datos para detectar títulos atípicos. Luego, planificará la investigación en una serie de acciones y luego realizará cada actividad, como consultar un tipo de registro y un rango de tiempo específicos. Reflexionará sobre los resultados en cada paso e iterará sobre el plan hasta datar a las hipótesis más probables. Los resultados intermedios aparecerán en la misma página en la que trabaja el agente para que puedas seguir el razonamiento en tiempo positivo. Por ejemplo, descubre que el agente de investigación trazó con precisión la topología del servicio y la utilizó como paso intermedio secreto para la investigación.

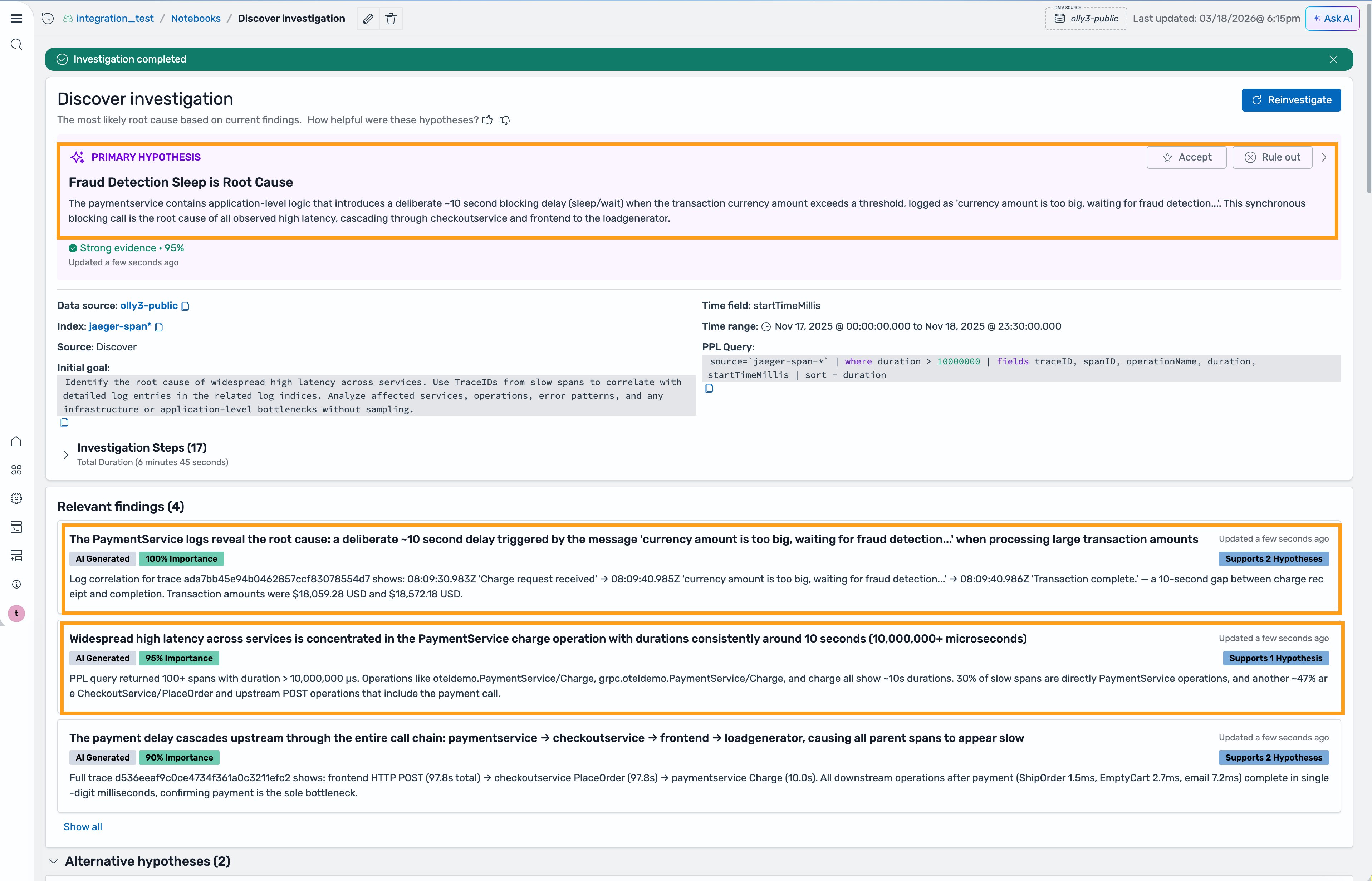

A medida que se completa la investigación, el agente de investigación concluye que la hipótesis más probable es un tiempo de aplazamiento de detección de fraude. El hallazgo asociado muestra una entrada de registro del servicio de suscripción: «el monto de la moneda es demasiado ancho, esperando la detección de fraude». Esto coincide con un diseño de sistema conocido en el que las transacciones grandes desencadenan una indicación de detección de fraude que bloquea la solicitud hasta que la transacción sea calificada y evaluada. El agente llegó a este hallazgo correlacionando datos en dos índices separados, un índice de métricas donde se encontraban los datos de duración originales y un índice de registro correlacionado donde se almacenaban las entradas del servicio de suscripción. El agente vinculó estos índices utilizando ID de seguimiento, conectando la medición de latencia a la entrada de registro específica que lo explicaba.

Luego de revisar la hipótesis y la evidencia que la respalda, encontrará que el resultado es arreglado y se alinea con su conocimiento del dominio y experiencias pasadas con problemas similares. Ahora puede aceptar la hipótesis y revisar la topología del flujo de solicitudes para los seguimientos afectados que se proporcionaron como parte de la investigación de la hipótesis.

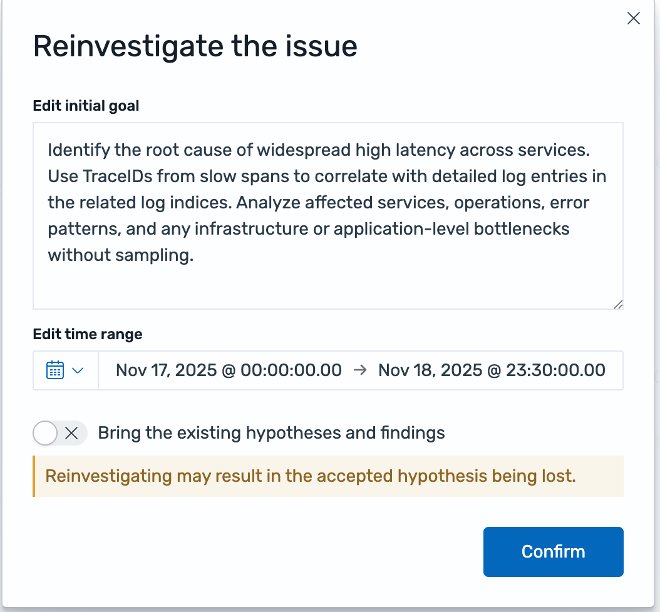

Alternativamente, si considera que la hipótesis original no fue útil, puede revisar la hipótesis alternativa en la parte inferior del noticia y clasificar cualquiera de las hipótesis alternativas si hay una que sea más precisa. Incluso puede activar una nueva investigación con entradas adicionales o correcciones de entradas anteriores para que el agente de investigación pueda reelaborarla.

Empezando

Puede utilizar cualquiera de las nuevas funciones de IA agente (se aplican límites) en la interfaz de agraciado de OpenSearch sin costo alguno. Encontrará las nuevas funciones de IA agente listas para usar en sus aplicaciones de interfaz de agraciado de OpenSearch, a menos que haya deshabilitado previamente las funciones de IA en cualquier dominio del servicio OpenSearch en su cuenta. Para habilitar o deshabilitar las funciones de IA, puede navegar a la página de detalles de la aplicación OpenSearch UI en AWS Management Console y modernizar la configuración de AI desde allí. Alternativamente, además puede utilizar el registerCapability API para habilitar las funciones de IA o utilizar la deregisterCapability API para deshabilitarlos. Obtenga más información en IA agente en los servicios de Amazon OpenSearch.

La función de IA agente utiliza la identidad y los permisos de los usuarios que iniciaron sesión para autorizar el paso a las fuentes de datos conectadas. Asegúrese de que sus usuarios tengan los permisos necesarios para ceder a las fuentes de datos. Para obtener más información, consulte Entrada a la interfaz de agraciado de OpenSearch.

Los resultados de la investigación se guardan en el sistema de metadatos de OpenSearch UI y se cifran con una secreto administrada por el servicio. Opcionalmente, puede configurar una secreto administrada por el cliente para acelerar todos los metadatos con su propia secreto. Para obtener más información, consulte Enigmático y secreto administrada por el cliente con la interfaz de agraciado de OpenSearch.

Las funciones de IA funcionan con el maniquí Claude Sonnet 4.6 en Amazon Bedrock. Obtenga más información en Protección de datos de Amazon Bedrock.

Conclusión

Las nuevas capacidades de IA agente anunciadas para Amazon OpenSearch Service ayudan a sujetar el tiempo medio de resolución al proporcionar chatbot agente consciente del contexto para concurrencia, investigaciones basadas en hipótesis con total explicabilidad y memoria agente para coherencia del contexto. Con las nuevas capacidades de IA agente, su equipo de ingeniería puede enfrascarse menos tiempo a escribir consultas y correlacionar señales, y más tiempo a representar sobre las causas fundamentales confirmadas. Lo invitamos a explorar estas capacidades y tantear con sus aplicaciones hoy.

Sobre los autores