Solo 3 meses luego del divulgación de su maniquí de última procreación Gemini 3 Pro, Google DeepMind está aquí con su última lectura: Géminis 3.1 Pro.

Una progreso radical en términos de capacidades y seguridad, el maniquí Gemini 3.1 Pro se esfuerza por ser accesible y operable por todos. Independientemente de sus preferencias, plataforma o poder adquisitivo, el maniquí tiene mucho que ofrecer para todos los usuarios.

Estaría probando las capacidades de Gemini 3.1 Pro y daría más detalles sobre sus características secreto. Desde cómo ceder a Gemini 3.1 Pro hasta los puntos de remisión, en este artículo se aborda todo lo relacionado con este nuevo maniquí.

Géminis 3.1 Pro: ¿Qué hay de nuevo?

Gemini 3.1 Pro es el posterior miembro de la comunidad de modelos Gemini. Como es habitual, el maniquí viene con una asombrosa cantidad de características y mejoras respecto al pasado. Algunos de los más notables son:

- 1 millón de ventanas de contexto: Mantiene la capacidad de entrada de 1 millón de tokens líder en la industria, lo que le permite procesar más de 1500 páginas de texto o repositorios de código completos en un solo mensaje.

- Rendimiento de razonamiento progresista: Ofrece más del doble de rendimiento de razonamiento que Gemini 3 Pro, puntuando 77,1% en el punto de remisión ARC-AGI-2.

- Fiabilidad agente mejorada: Optimizado específicamente para flujos de trabajo autónomos, incluido un punto final API dedicado (gemini-3.1-pro-preview-herramientas personalizadas) para orquestación de herramientas de inscripción precisión y ejecución de bash.

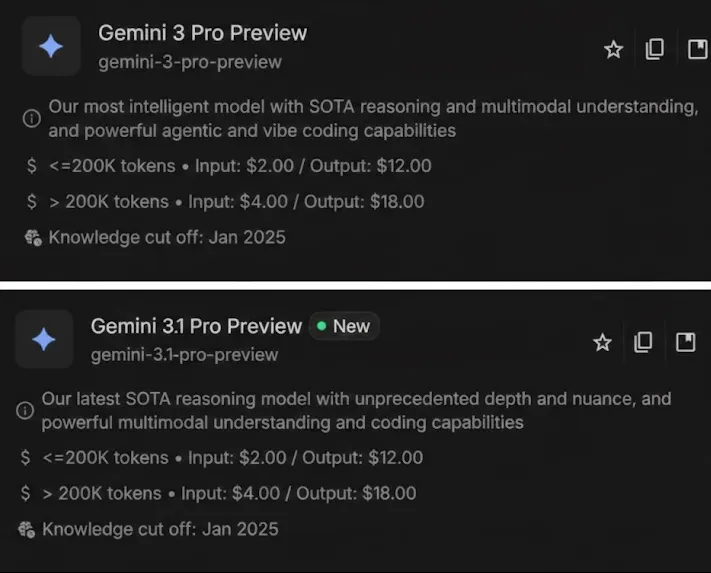

- Precios: El costo/token del posterior maniquí es el mismo que el de su predecesor. Para aquellos acostumbrados a la variable Pro, obtendrán una aggiornamento gratuita.

- Codificación de temblor destacamento: El maniquí maneja excepcionalmente perfectamente la codificación visual. Puede difundir SVG animados listos para sitios web exclusivamente a través de código, lo que significa un escalado nítido y tamaños de archivo pequeños.

- Alucinaciones: Gemini 3.1 Pro ha abordado el problema de las alucinaciones reduciendo su tasa de alucinaciones del 88% al 50% al otro banda de AA-Omniciencia: punto de remisión del conocimiento y las alucinaciones

- Pensamiento granular: El maniquí añade más granularidad a la opción de pensamiento ofrecida por su predecesor. Ahora los usuarios pueden designar entre parámetros de pensamiento altos, medios y bajos.

| Nivel de pensamiento | Géminis 3.1 Pro | Géminis 3 Pro | Géminis 3 Destello | Descripción |

| Reducido | No compatible | No compatible | Apoyado |

Coincide con la configuración de no pensar para la mayoría de las consultas. El maniquí puede pensar mínimamente para tareas de codificación complejas. Minimiza la latencia para chat o aplicaciones de stop rendimiento. |

| Bajo | Apoyado | Apoyado | Apoyado |

Minimiza la latencia y el coste. Lo mejor para seguir instrucciones simples o aplicaciones de stop rendimiento. |

| Medio | Apoyado | No compatible | Apoyado |

Razonamiento sensato para la mayoría de las tareas. |

| Detención | Compatible (predeterminado, dinámico) | Compatible (predeterminado, dinámico) | Compatible (predeterminado, dinámico) |

Maximiza la profundidad del razonamiento. Puede aumentar la latencia, pero los resultados se razonan con más cuidado. |

Experiencia: Divirtámonos un poco

Toda la charla del mundo no serviría de mínimo si el desempeño fracasa en la experiencia. Para evaluar Gemini 3.1 Pro correctamente, lo probé en tres categorías:

- razonamiento difícil

- Vivientes y depuración de código

- Síntesis de contexto dilatado

Tarea 1: Razonamiento inductivo de varios pasos

Qué prueba esto: Razonamiento en sujeción de pensamientos, manejo de restricciones y resistor a las alucinaciones.

Inmediato:

“Se le presenta el sucesivo marco:

Cinco analistas (A, B, C, D y E) están asignados a tres proyectos: Alfa, Beta y Gamma.

Normas:

1. Cada plan deberá contar con al menos un analista.

2. A no puede trabajar con C.

3. B debe estar asignado al mismo plan que D.

4. E no puede estar en Alfa.

5. Ningún plan podrá tener más de tres analistas.

Pregunta: enumera todas las combinaciones de asignaciones válidas. Muestre su razonamiento claramente y asegúrese de que no se viole ninguna regla.

“

Respuesta:

Gemini 3.1 Pro manejó una deducción con muchas restricciones sin caer en contradicciones, que es donde la mayoría de los modelos tropiezan. La coherencia y claridad en la enumeración de combinaciones válidas mostraron una gran profundidad de razonamiento.

Tarea 2: Vivientes y refactorización de código

Qué prueba esto: Pensamiento estructurado, conocimiento de los casos extremos, corrección del código y realismo de producción.

Inmediato:

“Se le proporciona la sucesivo función de Python:

def process_orders(orders):

total = 0

for order in orders:

if order("status") == "completed":

total += order("amount")

return totalRefactorice esta función para:

1. Maneje las llaves perdidas de guisa segura.

2. Ignore las cantidades negativas.

3. El registro omitió entradas no válidas.

4. Esté preparado para producción con sugerencias de tipo y cadenas de documentación.

5. Incluya pruebas unitarias para casos extremos.

Devuelve exclusivamente código Python expedito y perfectamente estructurado.

“

Respuesta:

import logging

import unittest

from typing import List, Dict, Any

logger = logging.getLogger(__name__)

def process_orders(orders: List(Dict(str, Any))) -> float:

"""

Process a list of order dictionaries and calculate

the total amount of completed orders.

"""

total: float = 0.0

if not isinstance(orders, list):

logger.error("'orders' must be a list.")

return total

for index, order in enumerate(orders):

if not isinstance(order, dict):

logger.warning("Skipping index %d: Not a dictionary.", index)

continue

if order.get("status") != "completed":

continue

if "amount" not in order:

logger.warning("Skipping index %d: Missing 'amount'.", index)

continue

amount = order("amount")

if not isinstance(amount, (int, float)) or isinstance(amount, bool):

logger.warning("Skipping index %d: 'amount' must be numeric.", index)

continue

if amount < 0:

logger.warning("Skipping index %d: Negative amount (%.2f).", index, amount)

continue

total += float(amount)

return total

class TestProcessOrders(unittest.TestCase):

def setUp(self):

logging.disable(logging.WARNING)

def tearDown(self):

logging.disable(logging.NOTSET)

def test_valid_completed_orders(self):

orders = (

{"status": "completed", "amount": 100},

{"status": "completed", "amount": 50.5}

)

self.assertEqual(process_orders(orders), 150.5)

def test_ignore_pending_orders(self):

orders = (

{"status": "pending", "amount": 100},

{"status": "completed", "amount": 50}

)

self.assertEqual(process_orders(orders), 50.0)

def test_missing_keys_skipped(self):

orders = (

{"amount": 100},

{"status": "completed"},

{"status": "completed", "amount": 20}

)

self.assertEqual(process_orders(orders), 20.0)

def test_negative_amounts_ignored(self):

orders = (

{"status": "completed", "amount": -10},

{"status": "completed", "amount": 3El código refactorizado se sintió consciente de la producción, no a nivel de bártulo. Anticipó casos extremos, impuso la seguridad de tipos e incluyó pruebas significativas. Este es el tipo de resultado que en realidad respeta los estándares de progreso del mundo vivo.

Tarea 3: Síntesis analítica de contexto dilatado

Qué prueba esto: Compresión de información, breviario estructurado y razonamiento en contexto.

Inmediato:

“A continuación se muestra un noticia comercial sintético:

Empresa: NovaGrid AI

Ingresos 2022: 12 millones de dólares

2023 Rendimiento : 28 millones de dólares

2024 Rendimiento: 46 millones de dólares

La rotación de clientes aumentó del 4% al 11% en 2024.

El pago en I+D aumentará un 70% en 2024.

El ganancia eficaz cayó del 18% al 9%.

Los clientes empresariales crecieron un 40%.

Los clientes de PYMES disminuyeron un 22%.

Los costos de infraestructura en la montón se duplicaron.

Tarea:

1. Diagnosticar las causas fundamentales más probables de la disminución del ganancia.

2. Identificar riesgos estratégicos.

3. Recomiende 3 acciones respaldadas por datos.

4. Presente su respuesta en un formato de memorando ejecutante estructurado.

“

Respuesta:

Conectó señales financieras, cambios operativos y riesgos estratégicos en una novelística ejecutiva coherente. La capacidad de diagnosticar la presión de los márgenes y al mismo tiempo equilibrar las señales de crecimiento muestra un sólido razonamiento empresarial. Parecía poco que redactaría un asesor decisivo experimentado, no un breviario genérico.

Nota: No utilicé las tareas normalizado «Crear un panel» como la mayoría de los modelos más recientes. Soneto 4.6, Kimi K2.5son capaces de crear uno fácilmente. Por lo tanto, no representaría un gran desafío para un maniquí tan capaz.

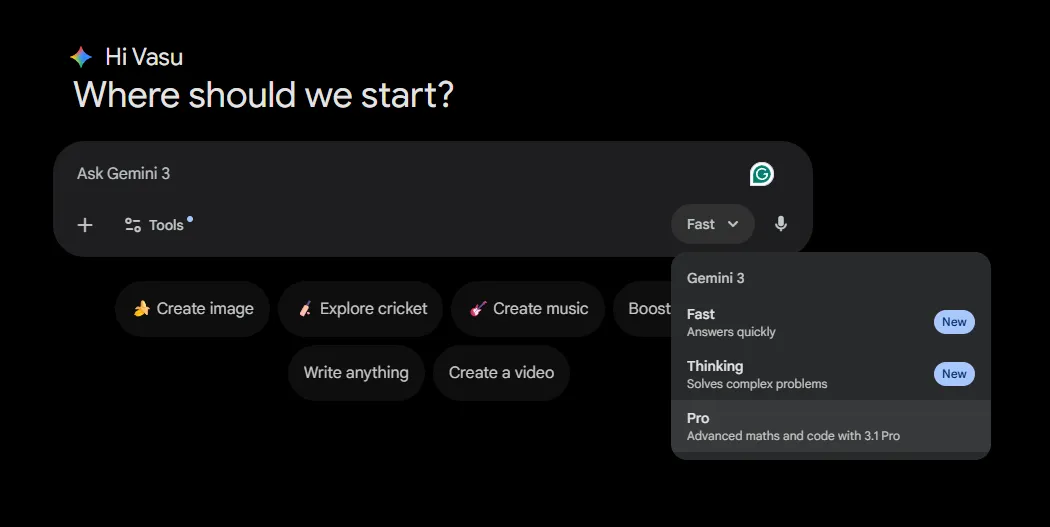

¿Cómo ceder a Gemini 3.1 Pro?

A diferencia de los modelos Pro anteriores, todos los usuarios pueden ceder gratis a Gemini 3.1 Pro en la plataforma de su selección.

Ahora que ha decidido utilizar Gemini 3.1 Pro, veamos cómo puede ceder al maniquí.

- Interfaz de sucesor web de Géminis: Los usuarios de Free y Gemini Advanced ahora tienen 3.1 Pro arreglado en la opción de la sección de maniquí.

- API: Acondicionado a través de Google AI Studio para desarrolladores (modelos/Gemini-3.1-pro).

| Maniquí | Fichas de entrada colchoneta | Escrituras de gusto de 5 m | Escrituras de gusto de 1 hora | Visitas de gusto y actualizaciones | Fichas de salida |

| Gemini 3.1 Pro (≤200 K tokens) | $2 / 1 millón de tokens | ~$0,20–$0,40 / 1 millón de tokens | ~$4.50 / 1 millón de tokens por hora de almacenamiento | No documentado formalmente | $12 / 1 millón de tokens |

| Gemini 3.1 Pro (>200 K tokens) | $4 / 1 millón de tokens | ~$0,20–$0,40 / 1 millón de tokens | ~$4.50 / 1 millón de tokens por hora de almacenamiento | No documentado formalmente | $18 / 1 millón de tokens |

- Plataformas en la montón: Se está implementando en NotebookLM, Vertex AI de Google Cloud y Microsoft Foundry.

Puntos de remisión

Para cuantificar qué tan bueno es este maniquí, los puntos de remisión serían aperos.

Hay mucho que descifrar aquí. Pero la progreso más sorprendente de todas se encuentra sin duda en los acertijos de razonamiento indeterminado.

Déjame poner las cosas en perspectiva: Gemini 3 Pro se lanzó con una puntuación ARC-AGI-2 del 31,1%. Este fue el más stop para ese momento y se consideró un gran avance para los estándares LLM. Un avance rápido de sólo 3 meses, y ese puntaje ha sido eclipsado por su propio sucesor por duplicar el ganancia!

Este es el rápido ritmo al que están mejorando los modelos de IA.

Si no está familiarizado con lo que prueban estos puntos de remisión, lea este artículo: Puntos de remisión de IA.

Conclusión: potente y accesible

Gemini 3.1 Pro demuestra que es más que un maniquí multimodal atractivo. A través del razonamiento, el código y la síntesis analítica, demuestra una capacidad vivo con relevancia para la producción. No es consumado y aún exige indicaciones estructuradas y supervisión humana. Pero como maniquí de frontera integrado en el ecosistema de Google, es poderoso, competitivo y absolutamente digno de una evaluación seria.

Preguntas frecuentes

R. Está diseñado para razonamiento progresista, procesamiento de contexto prolongado, comprensión multimodal y aplicaciones de IA de nivel de producción.

R. Los desarrolladores pueden ceder a él a través de Google AI Studio para la creación de prototipos o Vertex AI para implementaciones empresariales escalables.

R. Funciona muy perfectamente, pero aún requiere indicaciones estructuradas y supervisión humana para avalar la precisión y estrechar las alucinaciones.

Inicie sesión para continuar leyendo y disfrutar de contenido seleccionado por expertos.