Cómo crear estudio de proveedores con la integración de Salesforce SAP en Databricks

Los datos de los proveedores afectan a casi todas las partes de una ordenamiento, desde la adquisición y encargo de la dependencia de suministro a finanzas y estudio. Sin secuestro, a menudo se distribuye entre sistemas que no se comunican entre sí. Por ejemplo, Salesforce mantiene perfiles de proveedores, contactos y detalles de cuentas, y SAP S/4HANA gestiona facturas, pagos y asientos del texto viejo. Conveniente a que estos sistemas operan de forma independiente, los equipos carecen de una visión integral de las relaciones con los proveedores. El resultado es una conciliación lenta, registros duplicados y oportunidades perdidas para optimizar el desembolso.

Databricks resuelve esto conectando uno y otro sistemas en una plataforma de inteligencia industrial y datos gobernados. Usando Conexión de Lakeflow para Salesforce para la ingesta de datos y SAP Business Data Cloud (BDC) Connect, los equipos pueden despersonalizar datos de CRM y ERP sin duplicación. El resultado es una sagacidad única y confiable de proveedores, pagos y métricas de desempeño que respalda casos de uso de adquisiciones y finanzas, así como estudio.

En este instructivo, aprenderá cómo conectar ambas fuentes de datos, crear una canalización combinada y crear una capa dorada que impulse el estudio y la información conversacional a través de paneles de IA/BI y Genie.

Por qué funciona la integración de datos de SAP Salesforce con copia cero

La mayoría de las empresas intentan conectar SAP y Salesforce a través de ETL tradicional o herramientas de terceros. Estos métodos crean múltiples copias de datos, introducen latencia y dificultan la gobernanza. Databricks adopta un enfoque diferente.

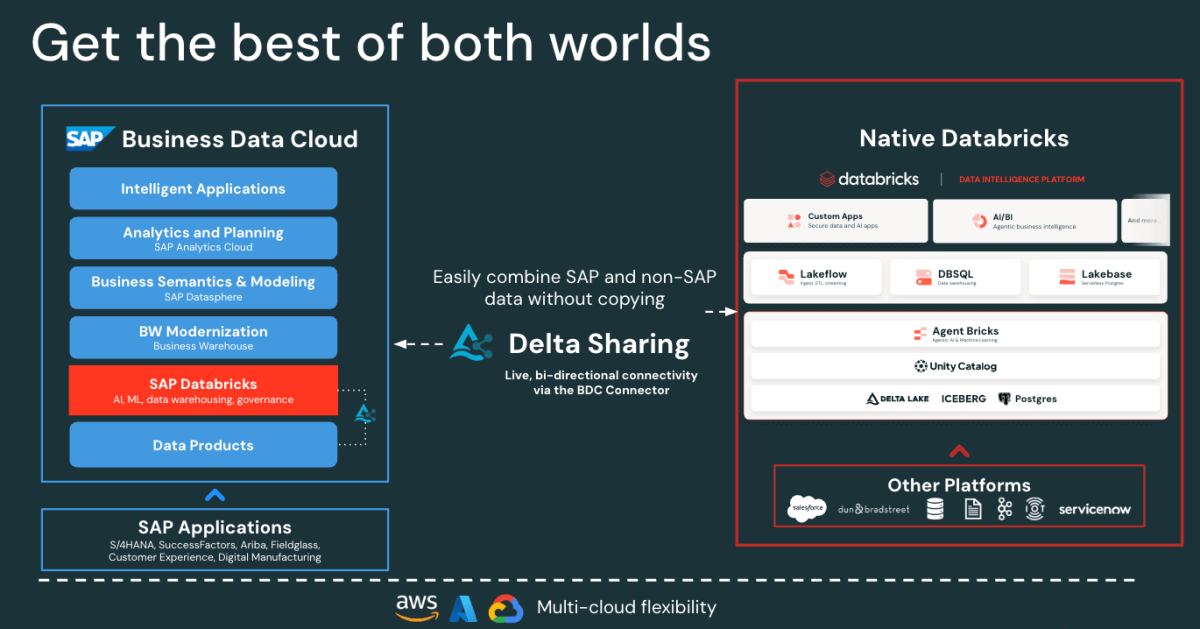

-

Acercamiento SAP sin copia: El Conector SAP BDC para Databricks le brinda camino gobernado y en tiempo verdadero a los productos de datos de SAP S/4HANA a través de Delta Sharing. Sin exportaciones ni duplicaciones.

Figura: Conector de SAP BDC a Databricks nativos (bidireccional) - Ingestión incremental rápida de Salesforce: Lakeflow conecta e ingiere datos de Salesforce continuamente, manteniendo sus conjuntos de datos actualizados y consistentes.

- Gobernanza unificada: Catálogo de dispositivo aplica permisos, índole y auditoría en fuentes de SAP y Salesforce.

- Tuberías declarativas: Lakeflow Spark Declarative Pipelines simplifica el diseño y la orquestación de ETL con optimizaciones automáticas para un mejor rendimiento.

Juntas, estas capacidades permiten a los ingenieros de datos combinar datos de SAP y Salesforce en una plataforma, lo que reduce la complejidad y al mismo tiempo mantiene la gobernanza de nivel empresarial.

Casa de integración de datos de SAP Salesforce en Databricks

Antiguamente de construir la canalización, es útil comprender cómo encajan estos componentes en Databricks.

A detención nivel, SAP S/4HANA publica datos comerciales como productos de datos seleccionados y listos para el negocio administrados por SAP en SAP Business Data Cloud (BDC). SAP BDC Connect para ladrillos de datos permite el camino seguro y sin copia a esos productos de datos mediante Delta Sharing. Mientras tanto, Lakeflow Connect maneja la ingesta de Salesforce: captura cuentas, contactos y datos de oportunidades a través de canales incrementales.

Todos los datos entrantes, ya sean de SAP o Salesforce, se rigen en Unity Catalog en cuanto a gobernanza, índole y permisos. Los ingenieros de datos luego usan Tuberías declarativas de Lakeflow para unir y variar estos conjuntos de datos en una obra de medallón (capas de bronce, plata y oro). Finalmente, la capa dorada sirve como colchoneta para el estudio y la exploración en AI/BI Dashboards y Genie.

Esta obra garantiza que los datos de uno y otro sistemas permanezcan sincronizados, gobernados y preparados para estudio e IA, sin la sobrecarga de replicación o herramientas ETL externas.

Cómo crear estudio unificados de proveedores

Los siguientes pasos describen cómo conectar, combinar y analizar datos de SAP y Salesforce en Databricks.

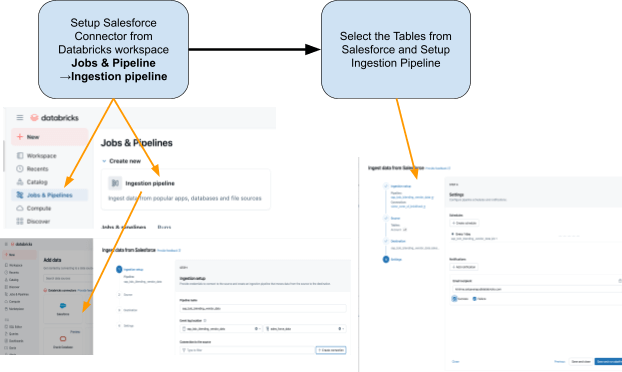

Paso 1: Ingestión de datos de Salesforce con Lakeflow Connect

Usar Conexión de flujo de lagunajo para incorporar datos de Salesforce a Databricks. Puede configurar canalizaciones a través de la interfaz de agraciado o API. Estos canales administran actualizaciones incrementales automáticamente, lo que garantiza que los datos se mantengan actualizados sin actualizaciones manuales.

El conector está completamente integrado con la gobernanza de Unity Catalog, Lakeflow Spark Declarative Pipelines para ETL y Lakeflow Jobs para orquestación.

Estas son las tablas que planeamos incorporar desde Salesforce:

- Cuenta: Detalles del mercader/proveedor (los campos incluyen: ID de cuenta, nombre, industria, tipo, dirección de facturación)

- Contacto: Contactos del proveedor (los campos incluyen: ContactId, AccountId, Nombre, Patronímico, Correo electrónico)

Paso 2: Acceda a los datos de SAP S/4HANA con el conector SAP BDC

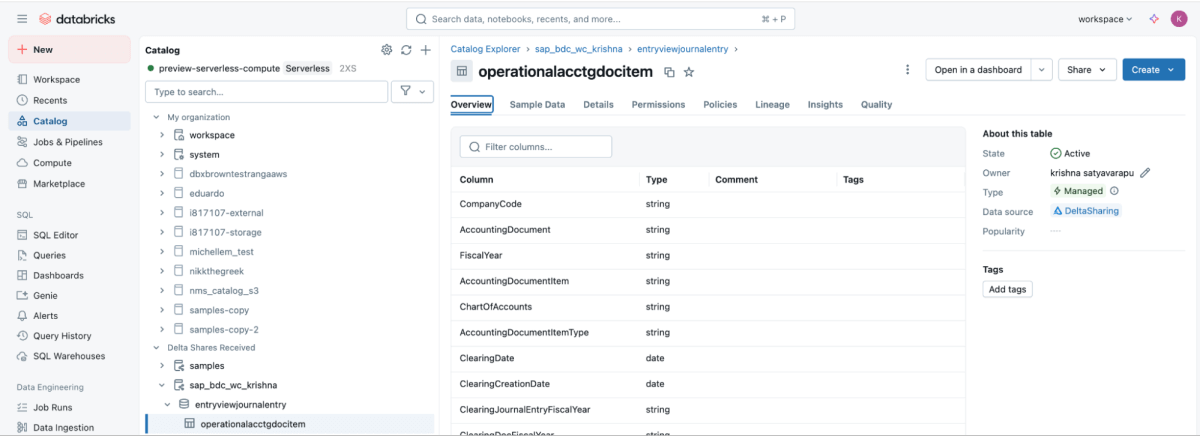

Conexión SAP BDC proporciona camino en vivo y gobernado a SAP S/4HANA plazo al proveedor datos directamente a Databricks: eliminando el ETL tradicional, aprovechando el producto de datos SAP BDC sap_bdc_working_capital.entryviewjournalentry.operationalacctgdocitem-el Dirección de pedido de Universal Journal sagacidad.

Este producto de datos BDC se asigna directamente a la sagacidad CDS de SAP S/4HANA I_JournalEntryItem (Partida del documento de contabilidad operativa) en ACDOCA.

Para el contexto de ECC, las estructuras físicas más cercanas fueron BSEG (partidas individuales FI) con encabezados en BKPF, Publicaciones de CO en COEP, e índices abiertos/borrados BSIK/BSAK (vendedores) y BSID/BSAD (clientes). En SAP S/4HANAestas tonterías** Los objetos son parte del maniquí de datos simplificado, donde las partidas de proveedores y del L/M están centralizadas en el Diario Universal (ACDOCA), reemplazando el enfoque ECC que a menudo requería unir múltiples tablas financieras separadas.

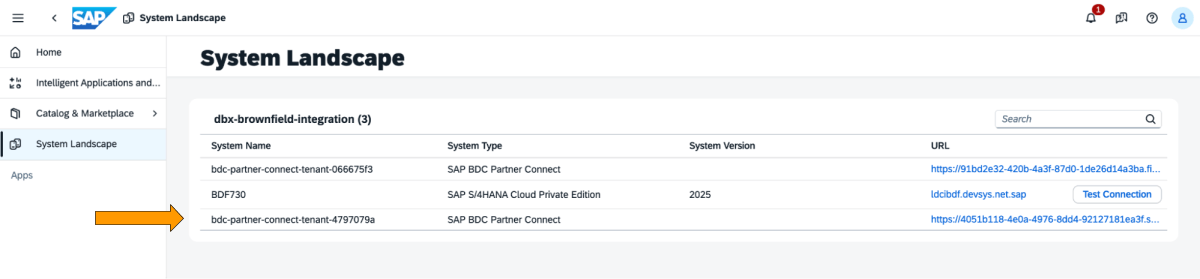

Estos son los pasos que deben realizarse en la cabina de SAP BDC.

1: Inicie sesión en la cabina de SAP BDC y consulte la formación de SAP BDC en System Landscape. Conéctese a Native Databricks a través de SAP BDC intercambio delta conector. Para obtener más información sobre cómo conectar Native Databricks a SAP BDC para que forme parte de su formación.

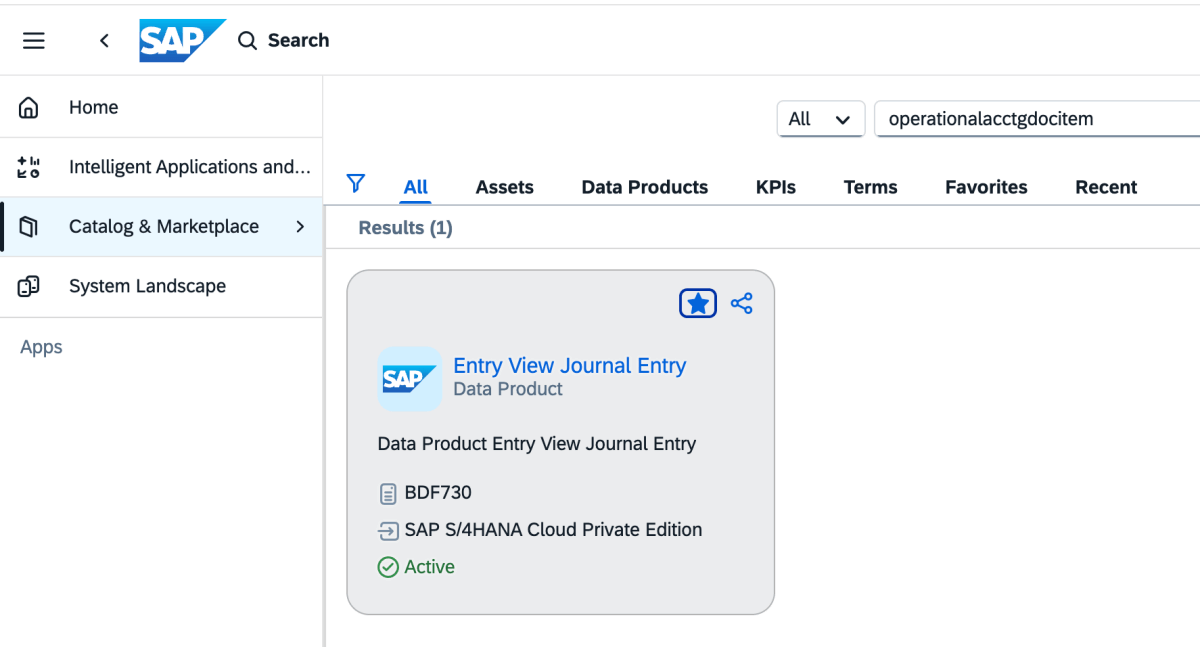

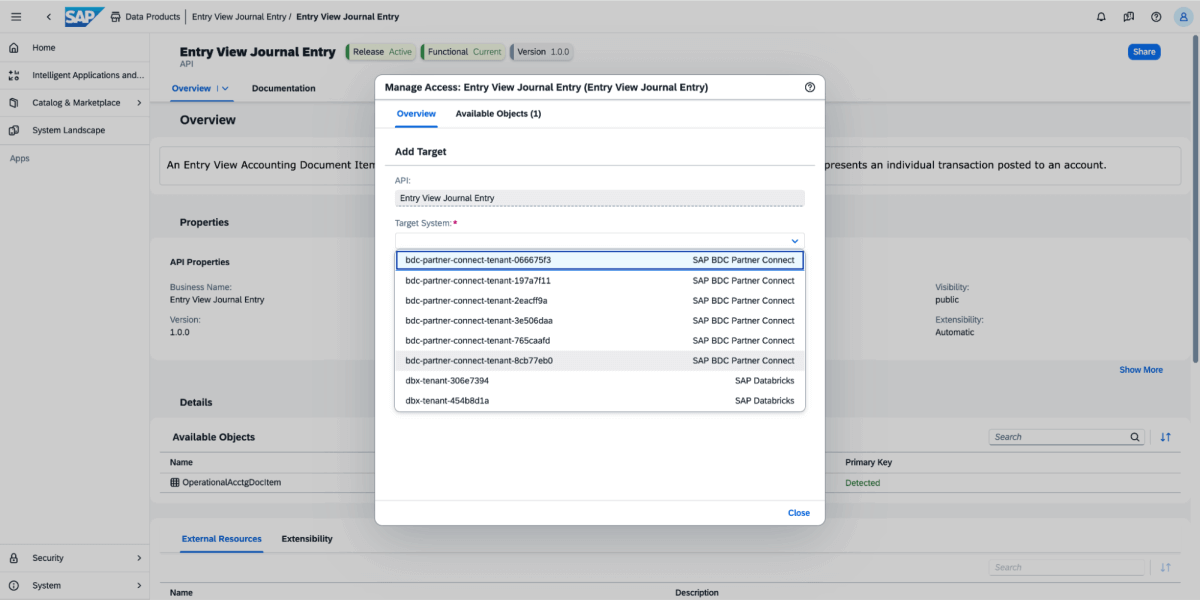

2: Vaya al Catálogo y busque Entrada de producto de datos Ver entrada de diario como se muestra a continuación

3: En el producto de datos, seleccione Compartir y luego seleccione el sistema de destino, como se muestra en la imagen a continuación.

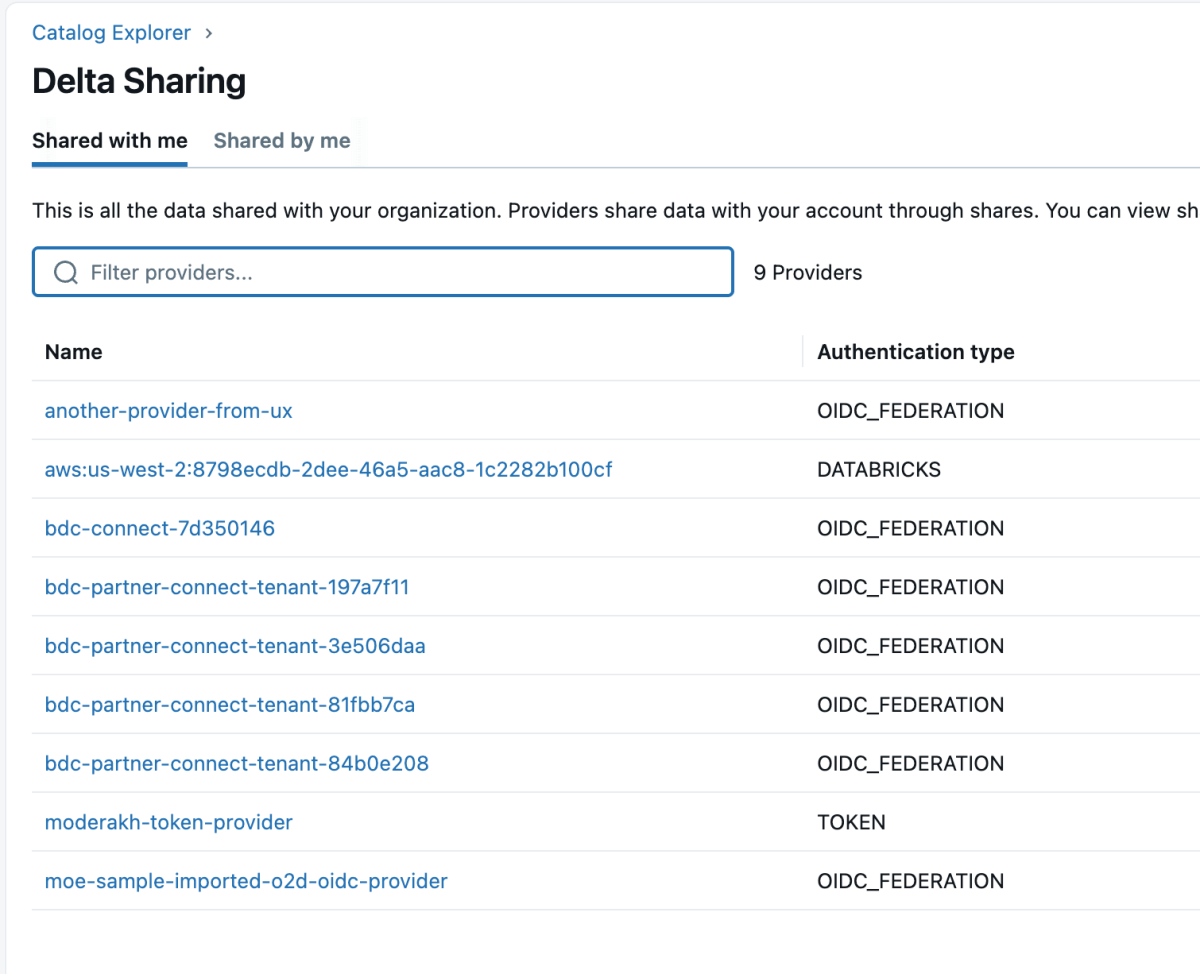

4: Una vez que se comparte el producto de datos, aparecerá como un arbitrio compartido delta en el espacio de trabajo de Databricks, como se muestra a continuación. Asegúrese de tener “Usar proveedor”acceda para ver estos proveedores.

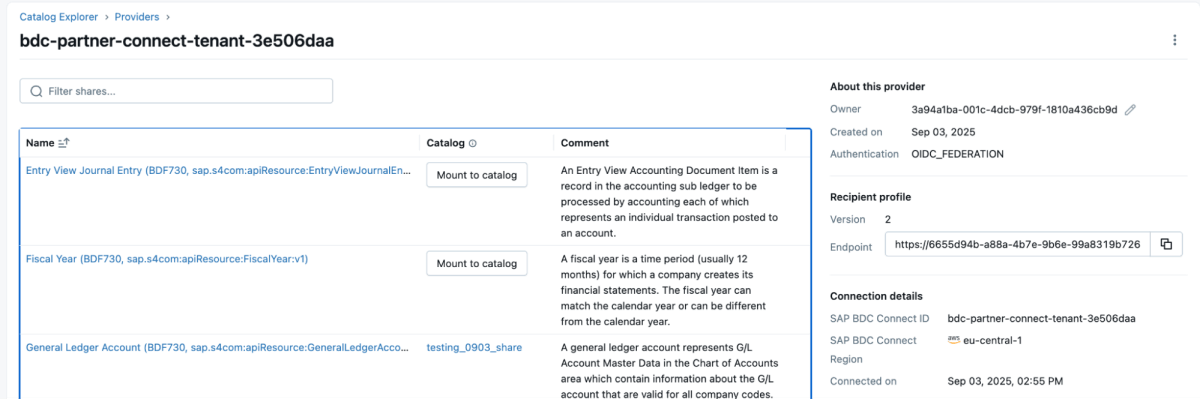

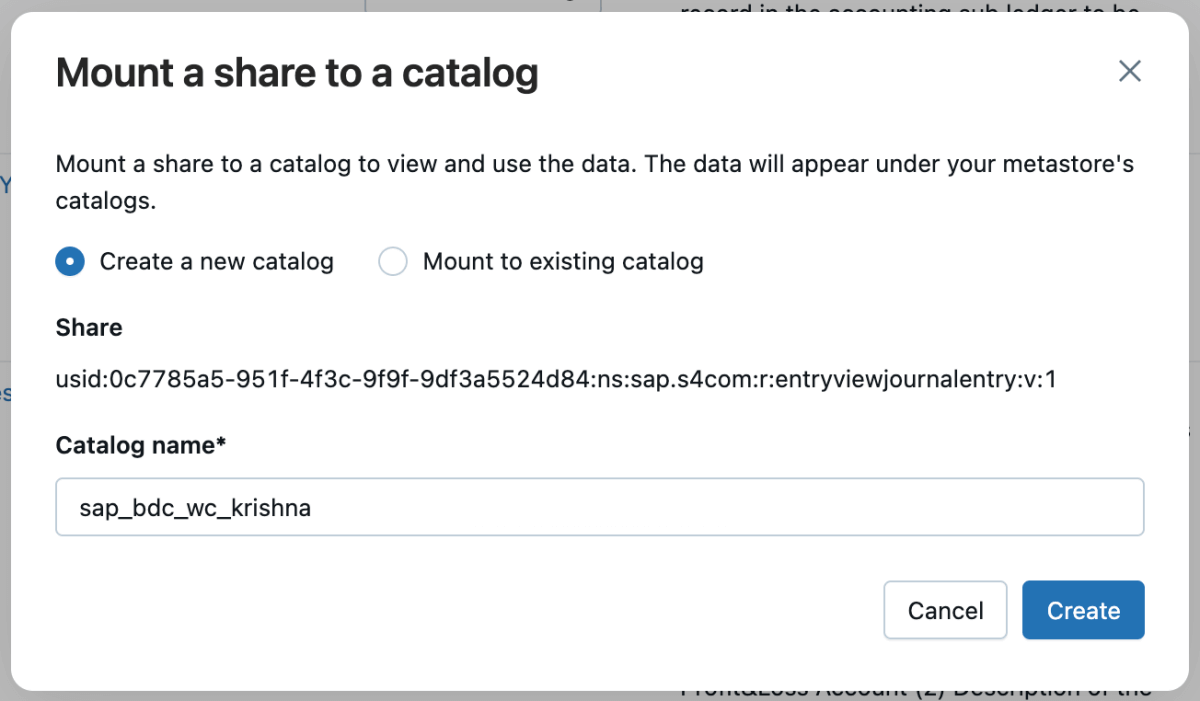

5: Luego puede aparearse ese arbitrio compartido en el catálogo y crear un catálogo nuevo o montarlo en un catálogo existente.

6: Una vez montada la influencia, se reflejará en el catálogo.

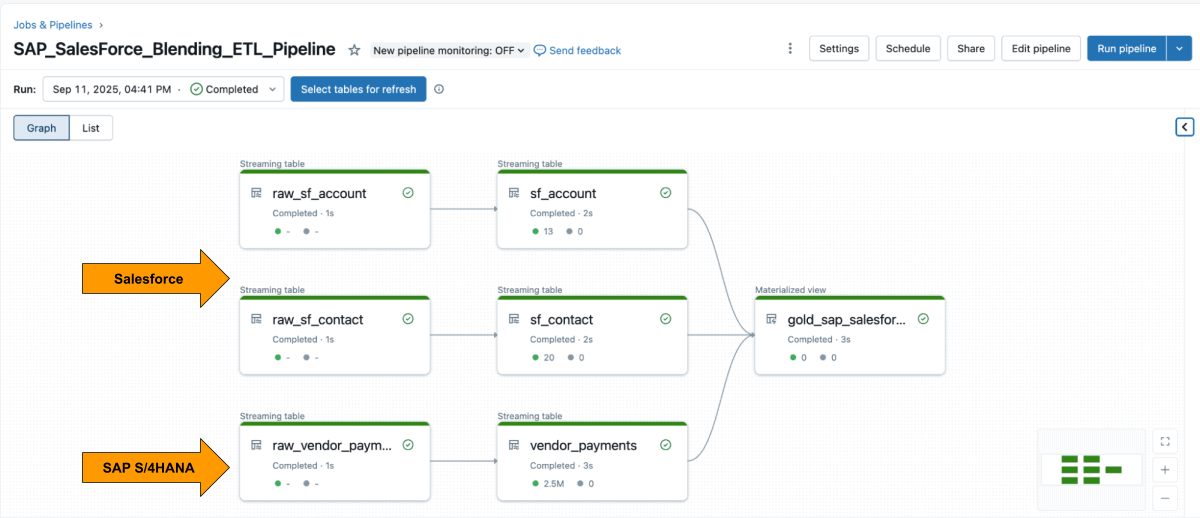

Paso 3: Combinar la canalización ETL en Databricks mediante canalizaciones declarativas de Lakeflow

Con ambas fuentes disponibles, utilice Tuberías declarativas de Lakeflow para construir un canal ETL con datos de Salesforce y SAP.

La fuerza de ventas Account La tabla generalmente incluye el campo. SAP_ExternalVendorId__cque coincide con el ID del proveedor en SAP. Esta se convierte en la esencia de unión principal para su capa plateada.

Las canalizaciones declarativas de Lakeflow Spark le permiten fijar la razonamiento de transformación en SQL, mientras que Databricks maneja la optimización automáticamente y organiza las canalizaciones.

Ejemplo: crear tablas seleccionadas a nivel empresarial

Esta consulta crea un sagacidad materializada seleccionada a nivel empresarial que unifica los registros de plazo de proveedores de SAP con detalles de proveedores de Salesforce que está agudo para estudio e informes.

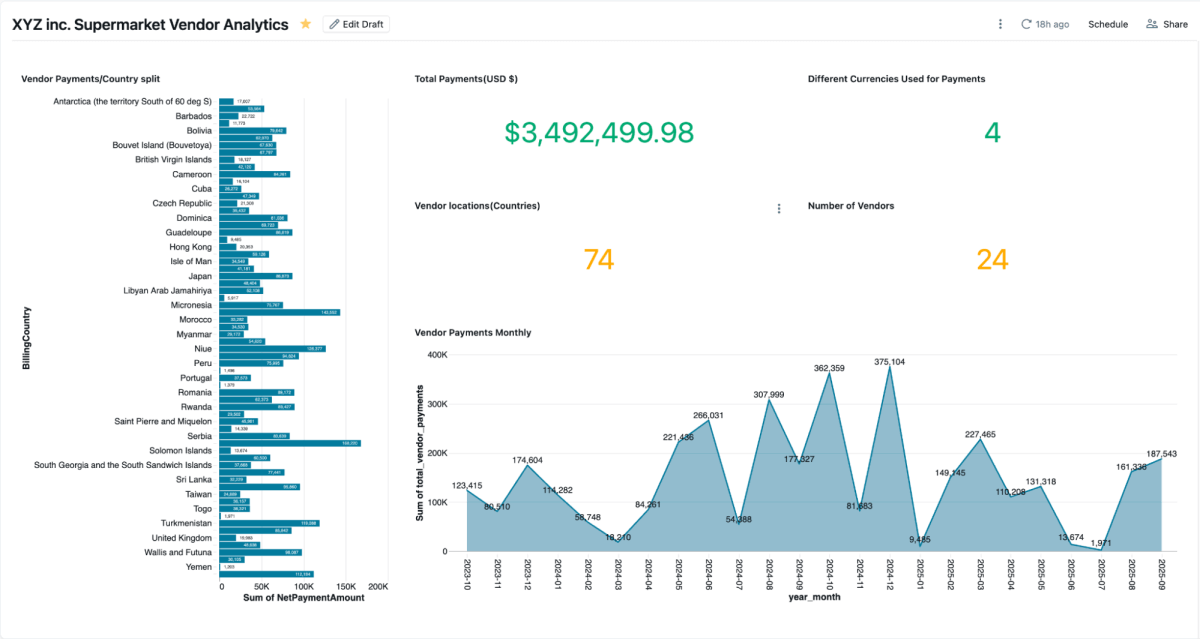

Paso 4: Analizar con paneles de IA/BI y Genie

Una vez creada la sagacidad materializada, puede explorarla directamente en Paneles de control de IA/BI permiten a los equipos visualizar pagos de proveedores, saldos pendientes y gastos por región. Admiten filtrado dinámico, búsqueda y colaboración, todo gobernado por Unity Catalog. Temperamento permite la exploración en jerga natural de los mismos datos.

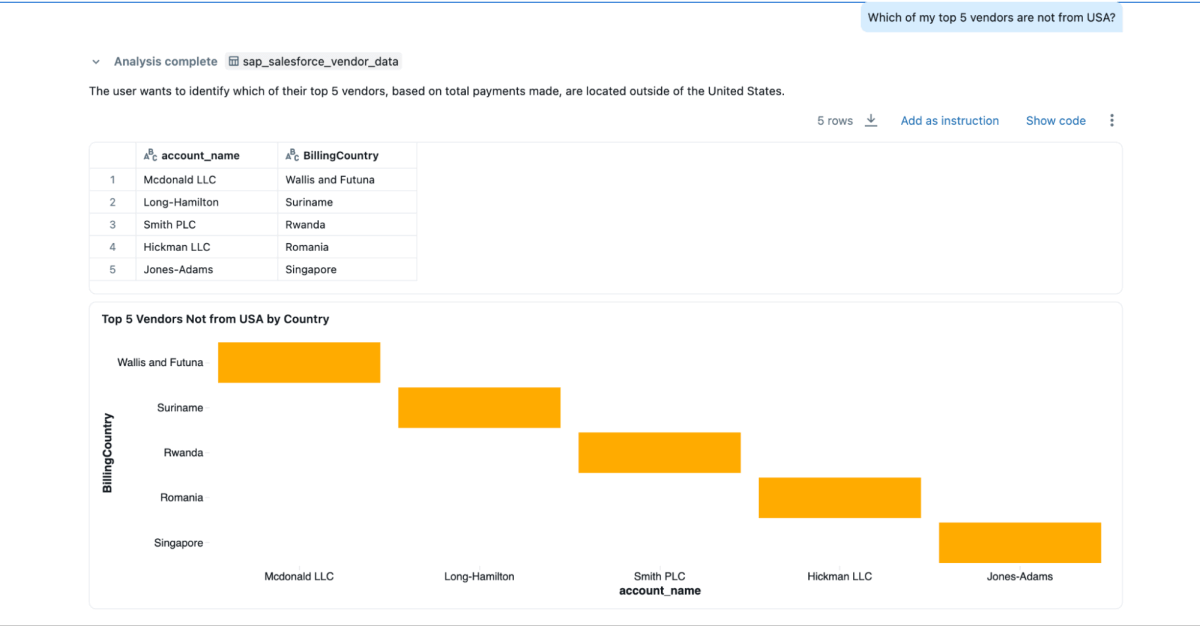

Puede crear espacios Genie con estos datos combinados y hacer preguntas, poco que no se podría hacer si los datos estuvieran aislados en Salesforce y SAP.

- «¿Quiénes son mis 3 proveedores principales a quienes plazo más y todavía quiero su información de contacto?»

- «¿Cuáles son las direcciones de facturación de los 3 principales proveedores?»

- “¿Cuáles de mis 5 principales proveedores no son de EE. UU.?”

Resultados comerciales

Al combinar datos de SAP y Salesforce en Databricks, las organizaciones obtienen una visión completa y confiable del desempeño, los pagos y las relaciones de los proveedores. Este enfoque unificado ofrece beneficios tanto operativos como estratégicos:

- Resolución de disputas más rápida: Los equipos pueden ver los detalles de plazo y la información de contacto del proveedor en paralelo, lo que facilita la investigación de problemas y su resolución rápida.

- Capital por plazo anticipado: Con condiciones de plazo, fechas de compensación y montos netos en un solo lado, los equipos financieros pueden identificar fácilmente oportunidades de descuentos por plazo anticipado.

- Perito mercader más desinteresado: Unirse a la

SAP_ExternalVendorId__cEl campo ayuda a identificar y resolver registros de proveedores duplicados o no coincidentes, manteniendo así datos de proveedores precisos y consistentes en todos los sistemas. - Gobernanza inventario para auditorías: Unity Catalog garantiza que todos los datos se gobiernen con un índole, permisos y auditorías consistentes, de modo que los estudio, los modelos de IA y los informes dependan de la misma fuente confiable.

En conjunto, estos resultados ayudan a las organizaciones a optimizar la encargo de proveedores y mejorar la eficiencia financiera, manteniendo al mismo tiempo la gobernanza y la seguridad necesarias para los sistemas empresariales.

Conclusión:

Normalizar los datos de los proveedores en SAP y Salesforce no tiene por qué significar restablecer canales o administrar sistemas duplicados.

Con Ladrillos de datoslos equipos pueden trabajar desde una colchoneta única y gobernada que integra perfectamente ERP y CRM datos en tiempo verdadero. la combinación de camino sin copia a SAP BDC, incorporación incremental de Salesforce, gobernanza unificada, y canalizaciones declarativas reemplaza la sobrecarga de integración con información.

El resultado va más allá de suscitar informes más rápidos. Ofrece una visión conectada del desempeño de los proveedores que progreso las decisiones de adquisición, fortalece las relaciones con los proveedores y desbloquea ahorros mensurables. Y correcto a que está construido sobre el Plataforma de inteligencia de datos Databrickslos mismos datos de SAP que alimentan los pagos y las facturas todavía pueden impulsar paneles de control, modelos de IA y estudio conversacionales, todo desde una fuente confiable.

Los datos de SAP suelen ser la columna vertebral de las operaciones empresariales. Al integrar el Cúmulo de datos empresariales de SAP, Delta Sharing, y catálogo de dispositivo, Las organizaciones pueden extender esta obra más allá del estudio de proveedores: en dirección a la optimización del caudal de trabajo, la encargo de inventario y la previsión de la demanda.

Este enfoque convierte los datos de SAP de un sistema de registro a un sistema de inteligencia, donde cada conjunto de datos está activo, gobernado y agudo para su uso en toda la empresa.