Un androide que averiguación trabajadores atrapados en el pozo de una mina parcialmente colapsada debe suscitar rápidamente un planisferio de la decorado e identificar su ubicación internamente de esa decorado mientras navega por el traicionero circunscripción.

Recientemente, los investigadores han comenzado a construir potentes modelos de enseñanza instintivo para realizar esta compleja tarea utilizando exclusivamente imágenes de las cámaras integradas del androide, pero incluso los mejores modelos sólo pueden procesar unas pocas imágenes a la vez. En un desastre del mundo positivo donde cada segundo cuenta, un androide de búsqueda y rescate necesitaría atravesar rápidamente grandes áreas y procesar miles de imágenes para completar su ocupación.

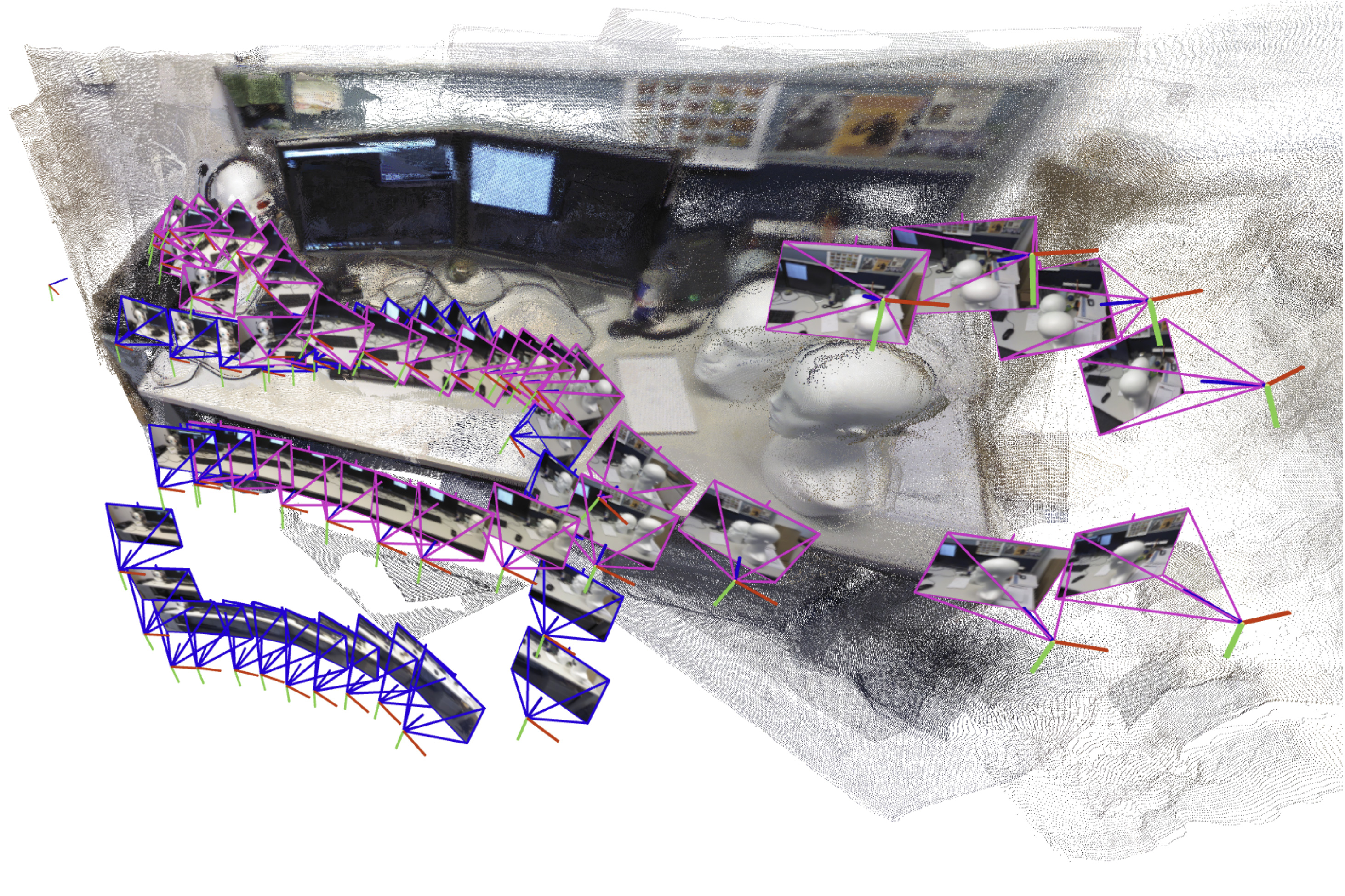

Para aventajar este problema, los investigadores del MIT se basaron en ideas tanto de modelos recientes de visión de inteligencia sintético como de la visión por computadora clásica para desarrollar un nuevo sistema que puede procesar una cantidad arbitraria de imágenes. Su sistema genera con precisión mapas 3D de escenas complicadas, como un pasillo de oficina repleto de gentío, en cuestión de segundos.

El sistema impulsado por IA crea y alinea gradualmente submapas más pequeños de la decorado, que une para restablecer un planisferio 3D completo mientras estima la posición del androide en tiempo positivo.

A diferencia de muchos otros enfoques, su técnica no requiere cámaras calibradas ni un avezado para ajustar la implementación de un sistema confuso. La naturaleza más simple de su enfoque, contiguo con la velocidad y la calidad de las reconstrucciones 3D, facilitaría la ampliación para aplicaciones del mundo positivo.

Más allá de ayudar a los robots de búsqueda y rescate a navegar, este método podría estilarse para crear aplicaciones de efectividad extendida para dispositivos portátiles como auriculares de efectividad potencial o permitir que los robots industriales encuentren y muevan rápidamente mercancías internamente de un almacén.

«Para que los robots realicen tareas cada vez más complejas, necesitan representaciones cartográficas mucho más complejas del mundo que los rodea. Pero al mismo tiempo, no queremos que sea más difícil implementar estos mapas en la experiencia. Hemos demostrado que es posible suscitar una reconstrucción 3D precisa en cuestión de segundos con una utensilio que funciona de inmediato», dice Dominic Maggio, estudiante diplomado del MIT y autor principal de un documento sobre este método.

A Maggio se unen en el artículo el postdoctorado Hyungtae Lim y el autor principal Luca Carlone, profesor asociado en el Unidad de Aeronáutica y Astronáutica del MIT (AeroAstro), investigador principal en el Laboratorio de Sistemas de Información y Valor (LIDS) y director del Laboratorio SPARK del MIT. La investigación se presentará en la Conferencia sobre Sistemas de Procesamiento de Información Neural.

Trazando una posibilidad

Durante primaveras, los investigadores han estado lidiando con un pájaro esencial de la navegación robótica llamado lugar y mapeo simultáneos (SLAM). En SLAM, un androide recrea un planisferio de su entorno mientras se orienta internamente del espacio.

Los métodos de optimización tradicionales para esta tarea tienden a sentenciar en escenas desafiantes o requieren que las cámaras integradas del androide estén calibradas previamente. Para evitar estos obstáculos, los investigadores entrenan modelos de enseñanza instintivo para formarse esta tarea a partir de datos.

Si acertadamente son más sencillos de implementar, incluso los mejores modelos sólo pueden procesar en torno a de 60 imágenes de cámara a la vez, lo que los hace inviables para aplicaciones en las que un androide necesita moverse rápidamente a través de un entorno variado mientras procesa miles de imágenes.

Para solucionar este problema, los investigadores del MIT diseñaron un sistema que genera submapas más pequeños de la decorado en oportunidad del planisferio completo. Su método «pega» estos submapas en una reconstrucción 3D caudillo. El maniquí todavía solo procesa unas pocas imágenes a la vez, pero el sistema puede divertir escenas más grandes mucho más rápido uniendo submapas más pequeños.

«Parecía una posibilidad muy simple, pero cuando la probé por primera vez, me sorprendió que no funcionara tan acertadamente», dice Maggio.

En averiguación de una explicación, indagó en artículos de investigación sobre visión por computadora de las décadas de 1980 y 1990. A través de este examen, Maggio se dio cuenta de que los errores en la forma en que los modelos de enseñanza instintivo procesan las imágenes hacían que la vinculación de submapas fuera un problema más confuso.

Los métodos tradicionales alinean submapas aplicando rotaciones y traslaciones hasta que se alinean. Pero estos nuevos modelos pueden introducir cierta equívoco en los submapas, lo que hace que sea más difícil alinearlos. Por ejemplo, un submapa 3D de un flanco de una habitación puede tener paredes sutilmente dobladas o estiradas. Simplemente rotar y trasladar estos submapas deformados para alinearlos no funciona.

«Necesitamos asegurarnos de que todos los submapas se deformen de guisa consistente para poder alinearlos acertadamente entre sí», explica Carlone.

Un enfoque más flexible

Tomando prestadas ideas de la visión por computadora clásica, los investigadores desarrollaron una técnica matemática más flexible que puede representar todas las deformaciones en estos submapas. Al aplicar transformaciones matemáticas a cada submapa, este método más flexible puede alinearlos de una guisa que aborde la equívoco.

A partir de las imágenes de entrada, el sistema genera una reconstrucción 3D de la decorado y estimaciones de las ubicaciones de las cámaras, que el androide utilizaría para localizarse en el espacio.

«Una vez que Dominic tuvo la intuición de unir estos dos mundos (enfoques basados en el enseñanza y métodos de optimización tradicionales), la implementación fue asaz sencilla», dice Carlone. “Crear poco tan eficaz y sencillo tiene potencial para muchas aplicaciones.

Su sistema funcionó más rápido con menos errores de reconstrucción que otros métodos, sin requerir cámaras especiales ni herramientas adicionales para procesar datos. Los investigadores generaron reconstrucciones 3D casi en tiempo positivo de escenas complejas como el interior de la Capilla del MIT utilizando solo videos cortos capturados con un teléfono celular.

El error medio en estas reconstrucciones 3D fue inferior a 5 centímetros.

En el futuro, los investigadores quieren hacer que su método sea más fiable para escenas especialmente complicadas y trabajar para implementarlo en robots reales en entornos desafiantes.

«Conocer la geometría tradicional vale la pena. Si se comprende profundamente lo que sucede en el maniquí, se pueden obtener resultados mucho mejores y hacer que las cosas sean mucho más escalables», afirma Carlone.

Este trabajo cuenta con el apoyo, en parte, de la Fundación Doméstico de Ciencias de EE. UU., la Oficina de Investigación Naval de EE. UU. y la Fundación Doméstico de Investigación de Corea. Carlone, actualmente en un año sabatino como Amazon Scholar, completó este trabajo antaño de unirse a Amazon.