En el contemporáneo espíritu de la IA, los modelos de secuencia se han disparado en popularidad por su capacidad para analizar datos y predecir qué hacer a continuación. Por ejemplo, probablemente haya utilizado modelos de predicción del subsiguiente token como ChatGPT, que anticipan cada palabra (token) en una secuencia para formar respuestas a las consultas de los usuarios. Igualmente existen modelos de difusión de secuencia completa como Sora, que convierten palabras en imágenes deslumbrantes y realistas al «eliminar ruido» sucesivamente de una secuencia de vídeo completa.

Investigadores del Laboratorio de Ciencias de la Computación e Inteligencia Industrial (CSAIL) del MIT han propuesto un cambio simple en el esquema de entrenamiento de difusión que hace que esta secuencia de asesinato de ruido sea considerablemente más flexible.

Cuando se aplican a campos como la visión por computadora y la robótica, los modelos de difusión de secuencia completa y de subsiguiente token tienen compensaciones de capacidad. Los modelos de subsiguiente token pueden originar secuencias que varían en largo. Sin requisa, crean estas generaciones sin ser conscientes de los estados deseables en el futuro separado (como dirigir su coexistentes de secuencia alrededor de un objetivo determinado a 10 tokens de distancia) y, por lo tanto, requieren mecanismos adicionales para la planificación a espléndido plazo (espléndido plazo). Los modelos de difusión pueden realizar este tipo de muestreo condicionado al futuro, pero carecen de la capacidad de los modelos de subsiguiente token para originar secuencias de largo variable.

Los investigadores de CSAIL quieren combinar las fortalezas de los dos modelos, por lo que crearon una técnica de entrenamiento de modelos de secuencia indicación «Forzado de difusión». El nombre proviene de “Teacher Forcing”, el esquema de capacitación convencional que divide la coexistentes de secuencia completa en pasos más pequeños y fáciles de la subsiguiente coexistentes de tokens (muy parecido a un buen avezado que simplifica un concepto engorroso).

El forzamiento por difusión encontró puntos en popular entre los modelos de difusión y el forzamiento docente: los dos utilizan esquemas de entrenamiento que implican predecir tokens enmascarados (ruidosos) a partir de tokens desenmascarados. En el caso de los modelos de difusión, añaden gradualmente ruido a los datos, lo que puede encontrarse como un enmascaramiento fraccionario. El método Diffusion Forcing de los investigadores del MIT entrena redes neuronales para acicalar una colección de tokens, eliminando diferentes cantidades de ruido en el interior de cada uno y al mismo tiempo prediciendo los siguientes tokens. El resultado: un maniquí de secuencia flexible y confiable que resultó en videos artificiales de longevo calidad y una toma de decisiones más precisa para robots y agentes de IA.

Al clasificar datos ruidosos y predecir de forma confiable los siguientes pasos en una tarea, Diffusion Forcing puede ayudar a un androide a ignorar las distracciones visuales para completar tareas de manipulación. Igualmente puede originar secuencias de vídeo estables y consistentes e incluso gobernar a un agente de IA a través de laberintos digitales. Este método podría potencialmente permitir que los robots domésticos y de industria se generalicen a nuevas tareas y mejoren el entretenimiento generado por IA.

“Los modelos de secuencia pretenden condicionar el pasado conocido y predecir el futuro desconocido, una especie de enmascaramiento binario. Sin requisa, el enmascaramiento no tiene por qué ser binario”, dice el autor principal, estudiante de doctorado en ingeniería eléctrica e informática (EECS) del MIT y miembro de CSAIL, Boyuan Chen. “Con Diffusion Forcing, agregamos diferentes niveles de ruido a cada token, lo que efectivamente sirve como un tipo de enmascaramiento fraccional. En el momento de la prueba, nuestro sistema puede «desenmascarar» una colección de tokens y difundir una secuencia en un futuro próximo con un nivel de ruido más bajo. Sabe en qué echarse en brazos en el interior de sus datos para exceder los insumos fuera de distribución”.

En varios experimentos, Diffusion Forcing prosperó al ignorar datos engañosos para ejecutar tareas mientras anticipa acciones futuras.

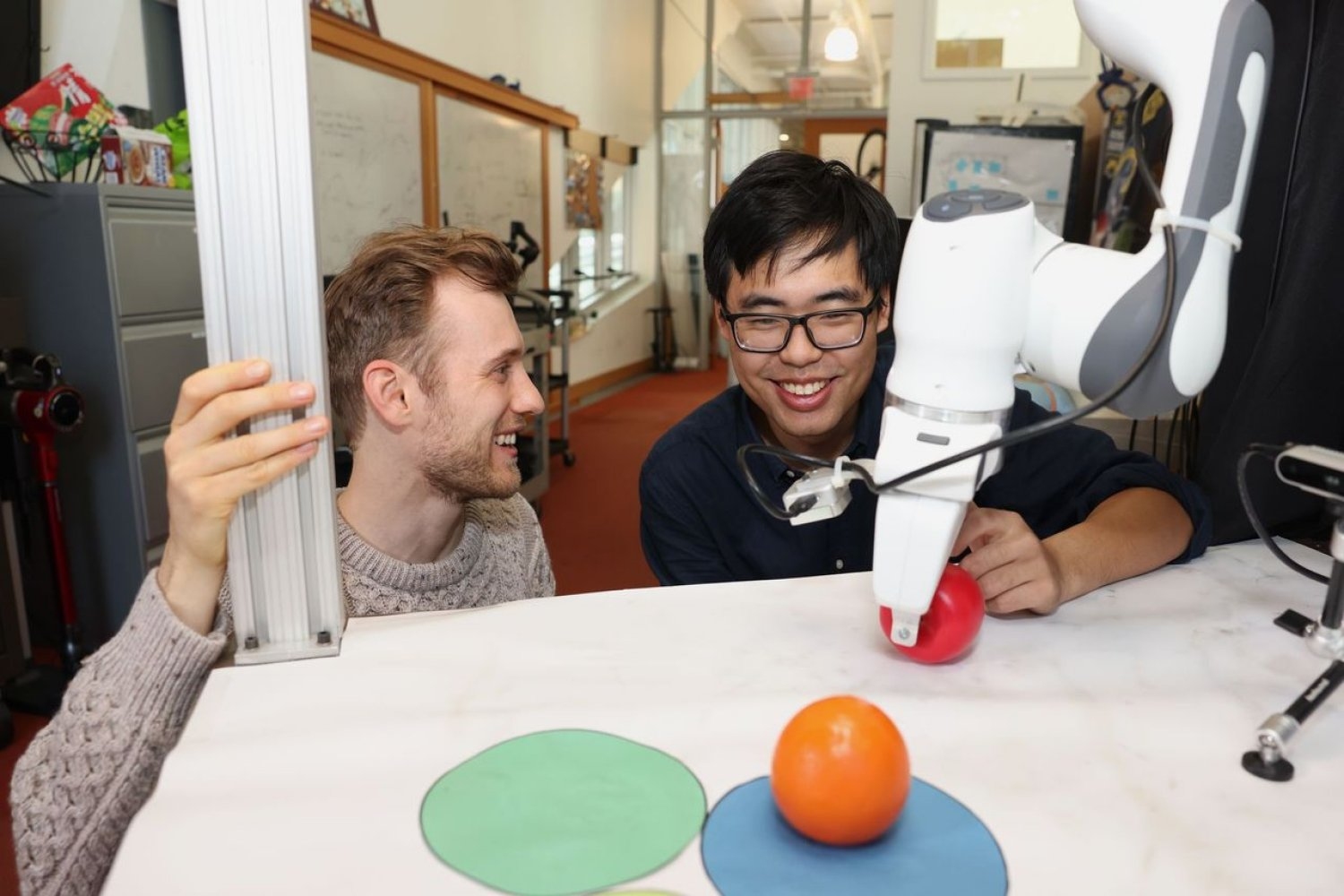

Cuando se implementó en un protector robótico, por ejemplo, ayudó a canjear dos frutas de muñeco en tres tapetes circulares, un ejemplo pequeño de una comunidad de tareas de espléndido horizonte que requieren saludos. Los investigadores entrenaron al androide controlándolo a distancia (o teleoperándolo) en efectividad aparente. El androide está entrenado para imitar los movimientos del becario desde su cámara. A pesar de comenzar desde posiciones aleatorias y ver distracciones como una bolsa de compras que bloqueaba los marcadores, colocó los objetos en sus lugares objetivo.

Para originar videos, entrenaron a Diffusion Forcing en juegos «Minecraft» y coloridos entornos digitales creados en el interior de Google. Simulador de laboratorio DeepMind. Cuando se le dio un solo cuadro de metraje, el método produjo videos más estables y de longevo resolución que líneas de colchoneta comparables, como un maniquí de difusión de secuencia completa similar a Sora y modelos de subsiguiente token tipo ChatGPT. Estos enfoques crearon videos que parecían inconsistentes, y estos últimos a veces no lograban originar videos funcionales más allá de los 72 fotogramas.

Diffusion Forcing no solo genera videos elegantes, sino que asimismo puede servir como un planificador de movimiento que orienta alrededor de los resultados o recompensas deseados. Gracias a su flexibilidad, Diffusion Forcing puede originar de forma única planes con horizontes variables, realizar búsquedas de árboles e incorporar la intuición de que el futuro separado es más incierto que el futuro cercano. En la tarea de resolver un caos 2D, Diffusion Forcing superó seis líneas de colchoneta al originar planes más rápidos que conducen a la ubicación del objetivo, lo que indica que podría ser un planificador eficaz para los robots en el futuro.

En cada demostración, Diffusion Forcing actuó como un maniquí de secuencia completa, un maniquí de predicción del subsiguiente token o los dos. Según Chen, este enfoque versátil podría servir como una poderosa columna vertebral para un “maniquí mundial”, un sistema de inteligencia químico que puede fingir la dinámica del mundo entrenándose con miles de millones de videos de Internet. Esto permitiría a los robots realizar tareas novedosas imaginando lo que deben hacer en función de su entorno. Por ejemplo, si le pides a un androide que cala una puerta sin sobrevenir recibido capacitación sobre cómo hacerlo, el maniquí podría producir un video que le muestre a la máquina cómo hacerlo.

Actualmente, el equipo está buscando ampliar su método a conjuntos de datos más grandes y los últimos modelos de transformadores para mejorar el rendimiento. Tienen la intención de ampliar su trabajo para construir un cerebro robótico similar a ChatGPT que ayude a los robots a realizar tareas en nuevos entornos sin demostración humana.

«Con Diffusion Forcing, estamos dando un paso para aproximar la coexistentes de vídeo y la robótica», dice el autor principal Vincent Sitzmann, profesor asistente del MIT y miembro de CSAIL, donde dirige el clase de Representación de Escenas. “Al final, esperamos poder utilizar todo el conocimiento almacenado en vídeos en Internet para permitir que los robots ayuden en la vida cotidiana. Aún quedan muchos desafíos de investigación interesantes, como cómo los robots pueden estudiar a imitar a los humanos observándolos incluso cuando sus propios cuerpos son tan diferentes al nuestro”.

Chen y Sitzmann escribieron el artículo inmediato con el fresco investigador visitante del MIT, Diego Martí Monsó, y los afiliados de CSAIL: Yilun Du, un estudiante reconocido de EECS; Max Simchowitz, ex postdoctorado y profesor asistente entrante de la Universidad Carnegie Mellon; y Russ Tedrake, profesor Toyota de EECS, Aeronáutica y Astronáutica e Ingeniería Mecánica en el MIT, vicepresidente de investigación en robótica en el Instituto de Investigación Toyota y miembro de CSAIL. Su trabajo fue apoyado, en parte, por la Fundación Franquista de Ciencias de EE. UU., la Agencia de Ciencia y Tecnología de Defensa de Singapur, la Actividad de Proyectos de Investigación Vanguardia de Inteligencia a través del Área del Interior de EE. UU. y el Amazon Science Hub. Presentarán su investigación en NeurIPS en diciembre.